SegmentFault 马蜂窝技术最新的文章

2020-02-18T11:47:23+08:00

https://segmentfault.com/feeds/blogs

https://creativecommons.org/licenses/by-nc-nd/4.0/

基于 Google-S2 的地理相册服务实现及应用

https://segmentfault.com/a/1190000021774912

2020-02-18T11:47:23+08:00

2020-02-18T11:47:23+08:00

马蜂窝技术

https://segmentfault.com/u/mafengwojishu

2

<blockquote><em>马蜂窝技术原创内容,更多干货请关注公众号:mfwtech</em></blockquote>

<p>随着智能手机存储容量的增大,以及相册备份技术的普及,我们可以随时随地用手机影像记录生活,在手机中存储几千张甚至上万张照片已经是很常见的事情。但另一方面,当我们想从这么多张照片中去找到一张,也是一件麻烦事。</p>

<p>马蜂窝作为旅行玩乐平台,希望实现「会玩的人」与「好玩的事」之间的连接。众多旅行爱好者在这里记录和分享他们的旅行记忆,使马蜂窝在旅游 UGC 领域累积了大量内容。因此,不断优化用户在发布内容时的体验是我们一直努力的主向。</p>

<p>用照片、视频记录旅行是最直接的方式。本文将介绍马蜂窝如何通过 App 地理相册空间索引的应用,为用户提供直观、好用的图片分享服务。</p>

<h2>Part.1 应用场景和需求</h2>

<p>要想让用户快速地找到想要分享的照片/视频,我们需要一个有效且合理的筛选手段,对用户的相册进行聚合、排序,提升用户依托相册去分享和记录生活时易用性和便捷性。</p>

<p>首先要确定聚合排序的筛选维度。照片的地理位置就是最直观的分类维度;同时,记录最近发生的事情符合用户的发布行为习惯。因此我们方案要满足的需求是:</p>

<ol>

<li>根据目的地和时间,对用户相册进行聚合、排序;</li>

<li>基于某个地理位置信息和给定范围,在用户相册中搜索给定范围的照片/视频。</li>

</ol>

<p>本文提及的地理相册服务在马蜂窝 App 内主要有两个落地场景。</p>

<h3>1.1 笔记</h3>

<p>「笔记」是以图片、视频为主要呈现形式的旅行短内容分享。用户发布笔记的第一个环节就是从相册中选择需要发布的照片/视频,在新版 App 中,基于地理相册服务结合马蜂窝自有目的地数据,对用户相册进行按照地点维度的聚合分类,并且按照片/视频的创建时间由近及远的排序,提升用户选择发布效率。</p>

<p><img src="/img/remote/1460000021774915" alt="" title=""></p>

<h3>1.2 足迹</h3>

<p>「足迹」这一产品的功能,旨在帮助马蜂窝用户以自动同步或手动点选去过的国家和地区这种更简易的方式记录旅行。在「我的足迹」中有一个场景,会鼓励用户对去过的但还没有发布笔记的地点发布笔记。此时地理相册服务可以帮助用户发布相册中以指定地点为圆心,给定半径范围内的所有照片。</p>

<p><img src="/img/remote/1460000021774916" alt="" title=""></p>

<h2>Part.2 方案设计与算法选型</h2>

<h3>2.1 初期方案</h3>

<p>初期我们想到的方案比较直观,也比较粗暴,就是对相册进行遍历后由服务端计算结果。具体来说,首先取出用户所有携带地理信息的照片/视频,然后将地理信息(经纬度)上传服务端,由服务端进行聚合和筛选,返回给客户端结果,但是这个方案有很多缺点。</p>

<p>文章开始我们已经描述了目前用户手机设备中的照片数量是成千上万的,如果遍历所有图片,这上传的数据体量是巨大的;同时,一般用户照片的地理位置会有很多呈现出成簇聚集的状态,因为一般我们会在一个地点范围内拍摄许多照片,这就导致了大量的重复聚类的计算。</p>

<p>如果要优化这个方案,针对第一个需求我们可以采用缓存+增量请求的方式,因为用户分类数据是稳定的。但是针对给定范围查询的需求,我们无法做缓存,这就需要每次都请求服务端做大量的计算,对于时间的消耗是不能容忍的。</p>

<p>可以看到,上述方案的挑战主要在于用户相册中地理信息的数据量和重复度、依赖服务端计算搜索结果导致的性能问题和用户体验。经过调研我们发现,基于地理空间点(经纬度)索引算法可以很好地解决这些问题。</p>

<h3>2.2 基于地理空间点索引算法的实践</h3>

<p>结合我们的实际需求来理解地理空间点索引算法,即找到合适的方法来对地理空间中海量的坐标点添加索引,从而对空间点进行快速查询和排序的一种算法。</p>

<p>我们对一些比较通用的地理空间点索引算法进行了选型比较,下面主要介绍 GeoHash 算法和 Google-S2 算法。</p>

<h4><strong>2.2.1 算法选型</strong></h4>

<h5><strong>(1)GeoHash</strong></h5>

<p>GeoHash 算法即地理位置距离排序算法。Geohash 是一种地理编码,由 Gustavo Niemeyer 发明。它利用一种分级的数据结构,把空间划分为网格。</p>

<p>GeoHash 属于空间填充曲线中的 Z 阶曲线的实际应用。GeoHash 有一个和 Z 阶曲线相关的性质,那就是一个点附近的地方 Hash 字符串总是有公共前缀,并且公共前缀的长度越长,这两个点距离越近。由于这个特性,GeoHash 就常常被用来作为唯一标识符,比如在数据库里面可用 GeoHash 来唯一表示一个点。</p>

<p><img src="/img/remote/1460000021774917" alt="" title=""></p>

<p>GeoHash 这个公共前缀的特性就可以用来快速的进行邻近点的搜索。越接近的点通常和目标点的 GeoHash 字符串公共前缀越长。但是 Z 阶曲线有一个比较严重的问题,就是它的突变性。在每个 Z 字母的拐角,都有可能出现顺序的突变,导致搜索临近点的精确度较差,不能满足我们的业务场景对精确度的要求。</p>

<h5><strong>(2)S2 算法</strong></h5>

<p>S2 其实是来自几何数学中的一个数学符号 S²,它表示的是单位球。</p>

<p>S2 算法采用正方体投影的方式将地球展开,然后利用希尔伯特分形曲线将展开后的二维地球进行填充,完成了对三位地球的降维和分形,从而得到空间坐标点与希尔伯特分形曲线的函数关系,即将球面经纬度坐标转换成球面 xyz 坐标,再转换成正方体投影面上的坐标,最后变换成修正后的坐标在坐标系变换,映射到 [0,2^30^-1] 区间,最后一步就是把坐标系上的点都映射到希尔伯特曲线上。最终,映射到希尔伯特曲线上的点成为 Cell ID,即是空间坐标点的索引。</p>

<p><img src="/img/remote/1460000021774919" alt="" title=""></p>

<p>S2 的最大的优势在于精度高。Geohash 有 12 级,从 5000km 到 3.7cm,中间每一级的变化比较大。有时候可能选择上一级会大很多,选择下一级又会小一些。而 S2 有 30 级,从 0.7cm² 到 85,000,000km²,中间每一级的变化都比较平缓,接近于 4 次方的曲线。所以选择精度时不会出现 Geohash 选择困难的问题。</p>

<p>综上,S2 算法能够满足我们对于功能和精度上的要求,因此最终选择 S2 算法作为空间点索引算法的实现方案。</p>

<h2>Part.3 功能实现与性能优化</h2>

<h3>3.1 模块设计</h3>

<p>本文中的 App 地理相册服务主要基于<strong>相册索引数据操作、用户相册扫描、相册索引服务和相册地点分类计算</strong>四大模块实现:</p>

<p><img src="/img/remote/1460000021774920" alt="" title=""></p>

<p>以下分别介绍。</p>

<h4><strong>3.1.1 相册索引数据操作模块</strong></h4>

<p>相册位置信息的索引采用数据库作为存储介质,将用户照片信息以及通过 S2 算法计算出来的 Cell ID 存储到数据库当中。其中,考量存储的数量和对搜索和聚合经度的要求,存储了从 Level4~Level16 经度级别的 Cell ID。</p>

<p>相册索引数据操作模块,由数据库(DB)和数据库操作层(DAO)组成。数据表的设计见下图:</p>

<p><img src="/img/remote/1460000021774918" alt="" title=""></p>

<p>数据库操作层(DAO)封装了数据插入、删除、查询等基本操作的 API。</p>

<h4><strong>3.1.2 用户相册扫描模块</strong></h4>

<p>用户相册扫描模块基于 iOS 原生提供的相册查询的 API,将用户相册的数据与本地数据库中存储的照片数据进行对比,提取出新增照片数据和用户已经删除的照片。</p>

<h4><strong>3.1.3 相册索引服务模块</strong></h4>

<p>相册索引服务模块,是基于 S2 算法的相册服务的核心模块。模块功能如下:</p>

<ul>

<li>直接与数据模块交互,向使用者屏蔽数据层的数据操作细节,提供满足查询、搜索等需求的 API</li>

<li>查询指定 Cell ID 下的照片资源</li>

<li>查询指定 Level 下,相册照片索引后的 Cell ID</li>

<li>查询以指定坐标点为圆心、指定半径范围内的照片</li>

<li>与用户相册扫描模块交互,获取新增照片和已经删除照片的数据,更新数据库内容,同时支持查询和通知更新状态</li>

</ul>

<h4><strong>3.1.4 相册地点分类计算模块</strong></h4>

<p>相册地点分类计算模块是计算用户相册的地点分类结果的核心模块。该模块的主体功能如下:</p>

<ul>

<li>获取 S2 相册索引服务中的照片 Cell ID,作为参数上传至服务端,服务端根据地图服务提供的聚合接口,将 Cell ID 的聚合结果返回给服务端</li>

<li>综合考量精确度和 Cell ID 的数据量,选取 Level12 的 Cell ID 作为请求服务端的 Cell ID 等级</li>

<li>调用相册索引服务模块根据指定 Level 获取 Cell ID 的方法得到去重后的 Cell ID</li>

<li>服务端返回的数据结构是 mdd_id(目的地 ID) 与 Cell ID 的一对多的映射关系</li>

<li>利用本地 S2 相册索引服务中的照片 Cell ID,根据上一步服务端返回的分类数据进行分类</li>

<li>缓存每次地点分类的计算结果</li>

</ul>

<h3>3.2 整体流程</h3>

<p><img src="/img/remote/1460000021774922" alt="" title=""></p>

<p>相册索引服务模块会在 App 启动时更新服务,将本地数据与相册数据同步。当用户触发地点相册功能时,相册地点分类计算模块会先取出缓存在本地相册地点分类计算结果展现给用户,同时驱动相册索引服务更新。</p>

<p>在收到更新服务更新完毕的通知后,首先向相册请求 12Level 的全量去重的 Cell ID,然后将 Cell ID 上传服务端由服务端计算分类,最后结合相册索引服务的全量照片数据,计算照片的地点分类结果,缓存结果并渲染展现给用户。</p>

<h3>3.3 性能优化</h3>

<h4><strong>3.3.1 获取相册增量照片</strong></h4>

<p>相册索引服务模块需要同步服务和用户相册的照片资源数据,找到新增数据,加入到服务数据库中。最初设计的获取新增数据方案如下:</p>

<p><strong>Step.1</strong> 获取全量的用户相册的数据</p>

<p><strong>Step.2</strong> 遍历用户照片,查询是否存在本地服务数据库中</p>

<p>但是这个方案应用到照片量较大的手机上时,获取新增照片的时延很高。排查后我们发现原因在于全量遍历用户相册时延很高,同时在遍历中频繁查询数据库也比较耗时。经过调研发现,iOS 的用户相册有「最近项目」的相册分类,该相册分类下的资源只按照添加顺序的倒序排列,即越新的照片越靠前。故将方案优化如下:</p>

<p><strong>Step.1</strong>:从列表头部截取 100 条</p>

<p><strong>Step.2</strong>:将该 100 条追加为新增照片</p>

<p><strong>Step.3</strong>:判断该 100 条中的最后一条,即新增时间最晚的一条,查询是否存在于服务数据库中</p>

<ul>

<li>若不存在,继续 Step.1</li>

<li>若存在,停止截取,从而得到新增照片</li>

</ul>

<h4><strong>3.3.2 渐进计算相册照片的地点分类</strong></h4>

<p>相册地点分类计算模块在获得服务端返回的分类结果(mdd_id 与 Cell ID 列表的映射关系)后,根据结果对本地服务数据库中的照片进行分类。最初的方案如下:</p>

<p><strong>Step.1</strong>:遍历结果列表,获得每个 mdd_id 映射的 Cell ID 列表</p>

<ul>

<li>A. 遍历 Cell ID 列表,通过 Cell ID 向相册索引服务模块查询属于该 Cell ID 索引下的照片资源,从而获得该 mdd_id 对应的照片资源</li>

<li>B. 对该目的地下的照片按照创建时间倒序排序</li>

</ul>

<p><strong>Step.2</strong>:将所有目的地维度照片分类结果,按照每个结果集中照片最晚创建时间,即第一个照片的创建时间,进行倒序排序,获得按照地点维度和创建时间维度排序的地点相册的最终计算结果。</p>

<p>这样的方案导致在地点相册首次计算的时候,用户需要等待所有目的地下的结果计算完毕后才能展现给用户,同时需要多次按照创建时间排序,导致时延很高,冷启动下用户体验很差。</p>

<p>为此,我们做出了方案优化,减少排序次数,同时通过渐进加载的方式优化用户体验。主要思路是相册索引服务模块的数据库中,存储照片的创建时间可以通过 SQL 查询,按照创建时间倒序排列的所有照片资源,获取倒序排列的照片资源集合:</p>

<p><strong>Step.1</strong>:每次从照片资源集合头部取 1000 条照片</p>

<ul>

<li>遍历每一张照片,根据照片的 Cell ID,从 mdd_id-Cell ID 映射表中查询所属的目的地, 判断照片目的地分类结果集中是否存在该目的地的照片资源分类集合</li>

<li>存在,追加该照片</li>

<li>创建该目的地的结果集,追加到照片目的地分类结果集中,并追加该照片</li>

</ul>

<p><strong>Step.2</strong>:将该 1000 张照片的分类结果渲染展现给用户</p>

<p><strong>Step.3</strong>:计算完所有照片的分类,通知结束渲染,计算完毕。</p>

<p>以上方案,将全量的本地照片资源以 1000 张为一批次,进行渐进计算,同时渐进渲染,缩短了用户的等待时间;同时,依托关系型数据库的排序能力,减少排序次数,优化了性能。</p>

<h2>Part.4 未来规划和总结</h2>

<p>目前,本文介绍的基于 Google-S2 算法实现的地点相册在马蜂窝 APP iOS 客户端已经上线一段时间,并且为笔记发布量带来了正向增长。但是这套方案在数据库数据处理中已经对于 Google-S2 算法的使用上仍然有很大的优化和探索空间,后续我们团队也会对其不断优化和深挖。</p>

<p>Google-S2 算法服务在马蜂窝 App iOS 客户端中的实现和落地,成果不仅仅是满足了笔记发布场景的探索,更使得客户端具备了对于用户相册照片百米级精确度的索引和搜索的能力,可以为后续更多、更复杂的业务场景服务,相信在不远的未来能为用户提供更便捷、更有趣的旅行记录产品。</p>

<p><strong>本文作者</strong>:王岩、王明友,马蜂窝内容业务研发工程师。</p>

<p><img src="/img/remote/1460000021774921" alt="" title=""></p>

机器学习在马蜂窝酒店聚合中的应用初探

https://segmentfault.com/a/1190000021610126

2020-01-17T15:52:42+08:00

2020-01-17T15:52:42+08:00

马蜂窝技术

https://segmentfault.com/u/mafengwojishu

17

<p>出门旅行,订酒店是必不可少的一个环节。住得干净、舒心对于每个出门在外的人来说都非常重要。</p>

<p>在线预订酒店让这件事更加方便。当用户在马蜂窝打开一家选中的酒店时,不同供应商提供的预订信息会形成一个聚合列表准确地展示给用户。这样做首先避免同样的信息多次展示给用户影响体验,更重要的是帮助用户进行全网酒店实时比价,快速找到性价比最高的供应商,完成消费决策。</p>

<p>酒店聚合能力的强弱,决定着用户预订酒店时可选价格的「厚度」,进而影响用户个性化、多元化的预订体验。为了使酒店聚合更加实时、准确、高效,现在马蜂窝酒店业务中近 80% 的聚合任务都是由机器自动完成。本文将详细阐述酒店聚合是什么,以及时下热门的机器学习技术在酒店聚合中是如何应用的。</p>

<h2>Part.1 应用场景和挑战</h2>

<h3>1.酒店聚合的应用场景</h3>

<p>马蜂窝酒旅平台接入了大量的供应商,不同供应商会提供很多相同的酒店,但对同一酒店的描述可能会存在差异,比如:</p>

<p><img src="/img/remote/1460000021610137" alt="" title=""></p>

<p>酒店聚合要做的,就是将这些来自不同供应商的酒店信息聚合在一起集中展示给用户,为用户提供一站式实时比价预订服务:</p>

<p><img src="/img/remote/1460000021610129" alt="" title=""></p>

<p>下图为马蜂窝对不同供应商的酒店进行聚合后的展示,不同供应商的报价一目了然,用户进行消费决策更加高效、便捷。</p>

<p><img src="/img/remote/1460000021610135" alt="" title=""></p>

<p>2.挑战</p>

<p><strong>(1) 准确性</strong></p>

<p>上文说过,不同供应商对于同一酒店的描述可能存在偏差。如果聚合出现错误,就会导致用户在 App 中看到的酒店不是实际想要预订的:</p>

<p><img src="/img/remote/1460000021610130" alt="" title=""><img src="/img/remote/1460000021610133" alt="" title=""></p>

<p>在上图中,用户在 App 中希望打开的是「精途酒店」,但系统可能为用户订到了供应商 E 提供的「精品酒店」,对于这类聚合错误的酒店我们称之为 「AB 店」。可以想象,当到店后却发现没有订单,这无疑会给用户体验造成灾难性的影响。</p>

<p><strong>(2) 实时性</strong></p>

<p>解决上述问题,最直接的方式就是全部采取人工聚合。人工聚合可以保证高准确率,在供应商和酒店数据量还不是那么大的时候是可行的。</p>

<p>但马蜂窝对接的是全网供应商的酒店资源。采用人工的方式聚合处理得会非常慢,一来会造成一些酒店资源没有聚合,无法为用户展示丰富的预订信息;二是如果价格出现波动,无法为用户及时提供当前报价。而且还会耗费大量的人力资源。</p>

<p>酒店聚合的重要性显而易见。但随着业务的发展,接入的酒店数据快速增长,越来越多的技术难点和挑战接踵而来。</p>

<h2>Part.2 初期方案:余弦相似度算法</h2>

<p>初期我们基于余弦相似度算法进行酒店聚合处理,以期降低人工成本,提高聚合效率。</p>

<p>通常情况下,有了名称、地址、坐标这些信息,我们就能对一家酒店进行唯一确定。当然,最容易想到的技术方案就是通过比对两家酒店的名称、地址、距离来判断是否相同。</p>

<p>基于以上分析,我们初版技术方案的聚合流程为:</p>

<ol>

<li>输入待聚合酒店 A;</li>

<li>ES 搜索与 A 酒店相距 5km 范围内相似度最高的 N 家线上酒店;</li>

<li>N 家酒店与 A 酒店分别开始进行两两比对;</li>

<li>酒店两两计算整体名称余弦相似度、整体地址余弦相似度、距离;</li>

<li>通过人工制定相似度、距离的阈值来得出酒店是否相同的结论。</li>

</ol>

<p>整体流程示意图如下:</p>

<p><img src="/img/remote/1460000021610132" alt="" title=""></p>

<p>「酒店聚合流程 V1」上线后,我们验证了这个方案是可行的。它最大的优点就是简单,技术实现、维护成本很低,同时机器也能自动处理部分酒店聚合任务,相比完全人工处理更加高效及时。</p>

<p>但也正是因为这个方案太简单了,问题也同样明显,我们来看下面的例子 (图中数据虚构,仅为方便举例):</p>

<p><img src="/img/remote/1460000021610134" alt="" title=""><img src="/img/remote/1460000021610131" alt="" title=""></p>

<p>相信我们每个人都可以很快判断出这是两家不同的酒店。但是当机器进行整体的相似度计算时,得到的数值并不低:<img src="/img/remote/1460000021610139" alt="" title=""></p>

<p><img src="/img/remote/1460000021610138" alt="" title=""></p>

<p>为了降低误差率,我们需要将相似度比对的阈值提升至一个较高的指标范围内,因此大量的相似酒店都不会自动聚合,仍需要人工处理。</p>

<p>最后,此版方案机器能自动处理的部分只占到约 30%,剩余 70% 仍需要人工处理;且机器自动聚合准确率约为 95%,也就是有 5% 的概率会产生 AB 店,用户到店无单,入住体验非常不好。</p>

<p>于是,伴随着机器学习的兴起,我们开始了将机器学习技术应用于酒店聚合中的探索之旅,来解决实时性和准确性这对矛盾。</p>

<h2>Part.3 机器学习在酒店聚合中的应用</h2>

<p>下面我将结合酒店聚合业务场景,分别从机器学习中的分词处理、特征构建、算法选择、模型训练迭代、模型效果来一一介绍。</p>

<h3>3.1 分词处理</h3>

<p>之前的方案通过比对「整体名称、地址」获取相似度,粒度太粗。</p>

<p>分词是指对酒店名称、地址等进行文本切割,将整体的字符串分为结构化的数据,目的是解决名称、地址整体比对粒度太粗的问题,同时也为后面构建特征向量做准备。</p>

<h4><strong>3.1.1 分词词典</strong></h4>

<p>在聊具体的名称、地址分词之前,我们先来聊一下分词词典的构建。现有分词技术一般都基于词典进行分词,词典是否丰富、准确,往往决定了分词结果的好坏。</p>

<p>在对酒店的名称分词时,我们需要使用到酒店品牌、酒店类型词典,如果纯靠人工维护的话,需要耗费大量的人力,且效率较低,很难维护出一套丰富的词典。</p>

<p>在这里我们使用统计的思想,采用机器+人工的方式来快速维护分词词典:</p>

<ol>

<li>随机选取 100000+酒店,获取其名称数据;</li>

<li>对名称从后往前、从前往后依次逐级切割;</li>

<li>每一次切割获取切割词且切割词的出现频率+1;</li>

<li>出现频率较高的词,往往就是酒店品牌词或类型词。</li>

</ol>

<p><img src="/img/remote/1460000021610141" alt="" title=""></p>

<p>上表中示意的是出现频率较高的词,得到这些词后再经过人工简单筛查,很快就能构建出酒店品牌、酒店类型的分词词典。</p>

<h4><strong>3.1.2 名称分词</strong></h4>

<p>想象一下人是如何比对两家酒店名称的?比如:</p>

<ul>

<li>A:7 天酒店 (酒仙桥店)</li>

<li>B:如家酒店 (望京店)</li>

</ul>

<p>首先,因为经验知识的存在,人会不自觉地进行「先分词后对比」的判断过程,即:</p>

<ul>

<li>7 天--->如家 </li>

<li>酒店--->酒店 </li>

<li>酒仙桥店--->望京店</li>

</ul>

<p>所以要想对比准确,我们得按照人的思维进行分词。经过对大量酒店名称进行人工模拟分词,我们对酒店名称分为如下结构化字段:</p>

<p><img src="/img/remote/1460000021610140" alt="" title=""></p>

<p>着重说下「<strong>类型前 2 字</strong>」这个字段。假如我们需要对如下 2 家酒店名称进行分词:</p>

<ul>

<li>酒店 1:龙门南昆山碧桂园紫来龙庭温泉度假别墅</li>

<li>酒店 2:龙门南昆山碧桂园瀚名居温泉度假别墅</li>

</ul>

<p>分词效果如下:<img src="/img/remote/1460000021610146" alt="" title=""></p>

<p><img src="/img/remote/1460000021610136" alt="" title=""></p>

<p>我们看到分词后各个字段相似度都很高。但类型前 2 字分别为:</p>

<ul>

<li>酒店 1 类型前 2 字:龙庭 </li>

<li>酒店 2 类型前 2 字:名居 </li>

</ul>

<p>这种情况下此字段 (类型前 2 字) 具有极高的区分度,因此可以作为一个很高效的对比特征。</p>

<h4><strong>3.1.3 地址分词</strong></h4>

<p>同样,模拟人的思维进行地址分词,使之地址的比对粒度更细更具体。具体分词方式见下图:</p>

<p><img src="/img/remote/1460000021610147" alt="" title=""></p>

<p>下面是具体的分词效果展示如下: </p>

<p><img src="/img/remote/1460000021610148" alt="" title=""></p>

<h4><strong>小结</strong></h4>

<p>分词解决了对比粒度太粗的缺点,现在我们大约有了 20 个对比维度。但对比规则、阈值怎么确定呢?</p>

<p>人工制定规则、阈值存在很多缺点,比如:</p>

<ol>

<li>规则多变。20 个对比维度进行组合会出现 N 个规则,人工不可能全部覆盖这些规则;</li>

<li>人工制定阈值容易受「经验主义」先导,容易出现误判。</li>

</ol>

<p>所以,对比维度虽然丰富了,但规则制定的难度相对来说提升了 N 个数量级。机器学习的出现,正好可以弥补这个缺点。机器学习通过大量训练数据,从而学习到多变的规则,有效解决人基本无法完成的任务。</p>

<p>下面我们来详细看下特征构建以及机器学习的过程。</p>

<h3>3.2 特征构建</h3>

<p>我们花了很大的力气来模拟人的思维进行分词,其实也是为构建特征向量做准备。</p>

<p>特征构建的过程其实也是模拟人思维的一个过程,目的是针对分词的结构化数据进行两两比对,将比对结果数字化以构造特征向量,为机器学习做准备。</p>

<p>对于不同供应商,我们确定能拿到的数据主要包括酒店名称、地址、坐标经纬度,可能获得的数据还包括电话和邮箱。</p>

<p>经过一系列数据调研,最终确定可用的数据为名称、地址、电话,主要是:因为</p>

<ol>

<li>部分供应商经纬度坐标系有问题,精准度不高,因此我们暂不使用,但待聚合酒店距离限制在 5km 范围内;</li>

<li>邮箱覆盖率较低,暂不使用。</li>

</ol>

<p>要注意的是,名称、地址拓展对比维度主要基于其分词结果,但电话数据加入对比的话首先要进行电话数据格式的清洗。</p>

<p>最终确定的特征向量大致如下,因为相似度算法比较简单,这里不再赘述:</p>

<p><img src="/img/remote/1460000021610142" alt="" title=""></p>

<h3>3.3 算法选择:决策树</h3>

<p>判断酒店是否相同,很明显这是有监督的二分类问题,判断标准为:</p>

<ul>

<li>有人工标注的训练集、验证集、测试集; </li>

<li>输入两家酒店,模型返回的结果只分为「相同」或「不同」两类情况。</li>

</ul>

<p>经过对多个现有成熟算法的对比,我们最终选择了决策树,核心思想是根据在不同 Feature 上的划分,最终得到决策树。每一次划分都向减小信息熵的方向进行,从而做到每一次划分都减少一次不确定性。这里摘录一张图片,方便大家理解:</p>

<p><img src="/img/remote/1460000021610149" alt="" title=""></p>

<p><em>(图源:__《机器学习西瓜书》)</em></p>

<h4><strong>3.3.1 Ada Boosting OR Gradient Boosting</strong></h4>

<p>具体的算法我们选择的是 Boosting。「三个臭皮匠,顶过诸葛亮」这句话是对 Boosting 很好的描述。Boosting 类似于专家会诊,一个人决策可能会有不确定性,可能会失误,但一群人最终决策产生的误差通常就会非常小。</p>

<p>Boosting 一般以树模型作为基础,其分类目前主要为 Ada Boosting、Gradient Boosting。Ada Boosting初次得出来一个模型,存在无法拟合的点,然后对无法拟合的点提高权重,依次得到多个模型。得出来的多个模型,在预测的时候进行投票选择。如下图所示:</p>

<p><img src="/img/remote/1460000021610143" alt="" title=""></p>

<p>Gradient Boosting 则是通过对前一个模型产生的错误由后一个模型去拟合,对于后一个模型产生的错误再由后面一个模型去拟合…然后依次叠加这些模型:</p>

<p><img src="/img/remote/1460000021610144" alt="" title=""></p>

<p>一般来说,Gradient Boosting 在工业界使用的更广泛,我们也以 Gradient Boosting 作为基础。</p>

<h4><strong>3.3.2 XGBoost OR LightGBM</strong></h4>

<p>XGBoost、LightGBM 都是 Gradient Boosting 的一种高效系统实现。</p>

<p>我们分别从内存占用、准确率、训练耗时方面进行了对比,LightGBM 内存占用降低了很多,准确率方面两者基本一致,但训练耗时却也降低了很多。</p>

<p>内存占用对比:</p>

<p><img src="/img/remote/1460000021610145" alt="" title=""></p>

<p>准确率对比:</p>

<p><img src="/img/remote/1460000021610153" alt="" title=""></p>

<p>训练耗时对比:</p>

<p><img src="/img/remote/1460000021610154" alt="" title=""></p>

<p><em>(图源:微软亚洲研究院)</em></p>

<p>基于以上对比数据参考,为了模型快速迭代训练,我们最终选择了 LightGBM。</p>

<h3>3.4 模型训练迭代</h3>

<p>由于使用 LightGBM,训练耗时大大缩小,所以我们可以进行快速的迭代。</p>

<p>模型训练主要关注两方面内容: </p>

<ul>

<li>训练结果分析</li>

<li>模型超参调节</li>

</ul>

<h4><strong>3.4.1 训练结果分析</strong></h4>

<p>训练结果可能一开始差强人意,没有达到理想的效果,这时需要我们仔细分析什么原因导致的这个结果,是特征向量的问题?还是相似度计算的问题?还是算法的问题?具体原因具体分析,但总归会慢慢达到理想的结果。</p>

<h4><strong>3.4.2 模型超参调节</strong></h4>

<p>这里主要介绍一些超参数调节的经验。首先大致说一下比较重要的参数:</p>

<p>(1) maxdepth 与 numleaves</p>

<p>maxdepth 与 numleaves是提高精度以及防止过拟合的重要参数:</p>

<ul>

<li>maxdepth: 顾名思义为「树的深度」,过大可能导致过拟合</li>

<li>numleaves 一棵树的叶子数。LightGBM 使用的是 leaf-wise 算法,此参数是控制树模型复杂度的主要参数</li>

</ul>

<p>(2) feature_fraction 与 bagging_fraction</p>

<p> feature_fraction与 bagging_fraction可以防止过拟合以及提高训练速度:</p>

<ul>

<li>feature_fraction:随机选择部分特征 (0<feature_fraction<1)</li>

<li>bagging_fraction随机选择部分数据 (0<bagging_fraction<1)</li>

</ul>

<p>(3) lambda_l1 与 lambda_l2 </p>

<p> lambda_l1与 lambda_l2 都是正则化项,可以有效防止过拟合。</p>

<ul>

<li>lambda_l1:L1 正则化项</li>

<li>lambda_l2 :L2 正则化项</li>

</ul>

<h3>3.5 模型效果</h3>

<p>经过多轮迭代、优化、验证,目前我们的酒店聚合模型已趋于稳定。</p>

<p>对方案效果的评估通常是凭借「准确率」与「召回率」两个指标。但酒店聚合业务场景下,需要首先保证绝对高的准确率(聚合错误产生 AB 店影响用户入住),然后才是较高的召回率。</p>

<p>经过多轮验证,目前模型的准确率可以达到 99.92% 以上,召回率也达到了 85.62% 以上:</p>

<p><img src="/img/remote/1460000021610150" alt="" title=""></p>

<p>可以看到准确率已经达到一个比较高的水准。但为保险起见,聚合完成后我们还会根据酒店名称、地址、坐标、设施、类型等不同维度建立一套二次校验的规则;同时对于部分当天预订当天入住的订单,我们还会介入人工进行实时的校验,来进一步控制 AB 店出现的风险。</p>

<p>3.6 方案总结</p>

<p>整体方案介绍完后,我们将基于机器学习的酒店聚合流程大致示意为下图:</p>

<p><img src="/img/remote/1460000021610151" alt="" title=""></p>

<p>经过上面的探索,我们大致理解了:</p>

<ol>

<li>解决方案都是一个慢慢演进的过程,当发现满足不了需求的时候就会进行迭代;</li>

<li>分词解决了对比粒度太粗的缺点,模拟人的思维进行断句分词;</li>

<li>机器学习可以得到复杂的规则,通过大量训练数据解决人无法完成的任务。</li>

</ol>

<h2>Part 4 写在最后</h2>

<p>新技术的探索充满挑战也很有意义。未来我们会进一步迭代优化,高效完成酒店的聚合,保证信息的准确性和及时性,提升用户的预订体验,比如:</p>

<ol>

<li>进行不同供应商国内酒店资源的坐标系统一。坐标对于酒店聚合是很重要的 Feature,相信坐标系统一后,酒店聚合的准确率、召回率会进一步提高。</li>

<li>打通风控与聚合的闭环。风控与聚合建立实时双向数据通道,从而进一步提高两个服务的基础能力。</li>

</ol>

<p>上述主要讲的是国内酒店聚合的演进方案,对于「国外酒店」数据的机器聚合,方法其实又很不同,比如国外酒店名称、地址如何分词,词形还原与词干提取怎么做等,我们在这方面有相应的探索和实战,总体效果甚至优于国内酒店的聚合,后续我们也会通过文章和大家分享,希望感兴趣的同学持续关注。</p>

<p><strong>本文作者:</strong>刘书超,交易中心-酒店搜索研发工程师;贺夏龙、康文云,智能中台-内容挖掘工程师。</p>

<p><img src="/img/remote/1460000021610152" alt="" title=""></p>

多环境多需求并行下的代码测试覆盖率统计工具实现

https://segmentfault.com/a/1190000021568729

2020-01-13T15:39:07+08:00

2020-01-13T15:39:07+08:00

马蜂窝技术

https://segmentfault.com/u/mafengwojishu

2

<blockquote><em>马蜂窝技术原创内容,更多干货请关注公众号:mfwtech</em></blockquote>

<p>测试覆盖率常被用来衡量测试的充分性和完整性,也是测试有效性的一个度量。「敏捷开发」的大潮之下,如何在快速迭代的同时保证对被测代码的覆盖度和产品质量,是一个非常有挑战性的话题。</p>

<p>在马蜂窝大交通、酒店等交易相关业务中,项目的开发和测试实践同样遵循敏捷的原则,迭代周期短、速度快。因此,如何依据测试覆盖率数据帮助我们有效判断项目质量、了解测试状态、提升迭代效率,是我们一直很重视的工作。</p>

<h2>Part.1 测试覆盖率统计中的挑战</h2>

<p>对于功能测试而言,通常可以通过充分了解需求、完善的测试用例、接口测试、Review 技术方案等来保证测试充分性。但随着业务规模快速发展,业务逻辑越来越复杂,系统级别交互越来越多,这些方法都不能保证所有的代码一定被全部测试过,也给测试人员带来极大挑战。</p>

<p>说到这儿和大家分享一个因为测试覆盖不充分,影响到线上业务的真实案例。事件起因是项目提测阶段一个微服务 Sonar 扫描没通过,开发同学为了修复 Sonar 发现的问题而重构了一部分历史代码,却导致一个原有发券需求的错误。当天下午运营触发发券后 Bug 出现直接导致生单不可用,并且持续了将近一个小时。这里的问题就是发券功能与此次需求无关,开发人员修改代码后测试人员不知道,也没有经过测试,但跟随本次需求一起上线了,测试用例无法覆盖到。</p>

<p>通过这个例子可以明显地看到正确统计被测代码覆盖率的重要性。当前市面上统计覆盖率的工具很多,但应用到我们的实际场景中通常存在以下问题:</p>

<ol>

<li>大部分第三方工具都是以支持提测前单元测试的覆盖率统计为主,而<strong>支持提测后测试覆盖率的工具则比较缺乏</strong>;</li>

<li>第三方工具提供的覆盖率基本都是展示全量的,但大部分情况下,<strong>测试人员重点关注的应该是本次新增和修改的部分</strong>,而不是耗费过多精力在未修改的部分上;</li>

<li>为了支持多需求并行测试,大交通后端服务采用 QA 隔离环境,而<strong>市面上还没有支持多需求隔离环境并行测试的测试覆盖率统计工具</strong>。</li>

</ol>

<p>因此,大交通测试组决定自研工具进行被测代码的覆盖率统计,用代码覆盖结果反向地检查测试人员测试用例的覆盖度和开发人员代码的冗余度,更精准地定位和分析问题,保证产品质量。</p>

<h2>Part.2 覆盖率统计工具设计</h2>

<p>结合我们的实际场景,覆盖率统计工具的实现目标如下:</p>

<ol>

<li>大交通业务后端代码使用 Java 语言开发,主要的业务处理逻辑都在后端,所以工具要优先支持 Java 代码覆盖率统计</li>

<li>可以统计提测后测试过程中不同类型测试的覆盖率,包括:手工测试、回归测试、接口测试、UI 自动化测试等等</li>

<li>支持全量、增量覆盖率统计</li>

<li>支持多需求多环境并行测试,同时统计覆盖率</li>

<li>用户不局限于测试人员,而是所有有测试需求的人员,包括开发和测试等</li>

<li>支持自动化统计,简化操作步骤,无需学习成本,报告简单易懂</li>

</ol>

<p>我们将覆盖率统计工具命名为 jCover,并将其引入 CI/CD 体系,与内部 Java 平台项目管理及持续集成系统 MONE 打通。工具设计如下图所示:</p>

<p><img src="/img/remote/1460000021568733" alt="" title=""></p>

<p>图 1:覆盖率工具整体架构图</p>

<p>覆盖率统计的大致流程为首先通过获取多环境服务的配置信息,生成指定环境服务的测试覆盖率文件,然后根据需要生成全量覆盖率报告和增量覆盖率报告,最后,存储测试覆盖率报告到指定环境目录下。</p>

<h2>Part.3 主要功能及实现方式</h2>

<p>jCover 的主要功能包括:</p>

<ul>

<li>支持多需求多环境并行测试下,同时统计覆盖率</li>

<li>支持全量覆盖率统计</li>

<li>支持增量覆盖率统计</li>

<li>支持自动/手动统计覆盖率</li>

<li>覆盖率报告统一管理</li>

</ul>

<p>下面围绕以上功能点,为大家介绍 jCover 的作用、特点和具体实现方式。</p>

<h4>1. 覆盖率工具平台化</h4>

<p>为了简化操作步骤降低学习成本、报告简单易懂,jCover 支持界面化操作,可以手动生成测试覆盖率报告和查询测试覆盖率报告;查询测试覆盖率报告入口统一,代码测试覆盖率数据清晰,方便数据统计和量化。</p>

<p><img src="/img/remote/1460000021568739" alt="" title=""></p>

<p>图 2:覆盖率报告查询页面</p>

<h4>2. 支持多需求多环境下的并行测试</h4>

<p>由于使用敏捷迭代,项目多、并行率高,大交通所有微服务均引入测试环境隔离插件,同时支持多项目并行测试。因此,jCover 需要支持多环境并行的测试覆盖率统计。</p>

<p>具体来说,每个测试项目都会有一个单独的环境标识,以隔离环境标识+环境类型+服务名称唯一确定一个覆盖率统计单元;每一个覆盖率统计单元都会生成对应的测试覆盖率统计报告,测试覆盖率统计报告被存储到 jCover 部署的服务器中,存储位置是环境标识对应的服务目录下;同一个服务的不同提测分支同时在多项目中测试时相互间的覆盖率报告不会被覆盖。</p>

<p>多环境并行流程图见下图(目前只支持 QA 环境覆盖率统计):</p>

<p><img src="/img/remote/1460000021568734" alt="" title=""></p>

<p>图 3:多环境并行流程图</p>

<p>例如:隔离环境 gjssqz 和隔离环境 supplyrefund 可以同时进行测试覆盖率统计,隔离环境标识+环境类型+服务名称指定了每个环境下的单个服务测试覆盖率统计结果。</p>

<p>覆盖率工具 UI 展示如下图:</p>

<p><img src="/img/remote/1460000021568732" alt="" title=""></p>

<p>图 4:用「隔离环境标识+环境类型+服务名称」来标识和统计覆盖率</p>

<h4>3. 全量覆盖率统计</h4>

<p>在测试时有时候需要关注全量代码的测试覆盖率,代码全量覆盖率统计过程如下:</p>

<p><strong>(1)查询服务信息</strong></p>

<p>jCover 通过内部 Java 平台项目管理及持续集成系统 MONE 来查询被测微服务的信息:</p>

<ul>

<li>为了减轻对 MONE 系统的压力,设定每日一次定时拉取全量服务信息,将隔离环境标识、服务名称、容器 IP、监听端口、环境类型和状态存储到数据库。</li>

<li>生成覆盖率报告时根据隔离环境标识和服务名称从 MONE 单服务信息拉取接口查询最新的容器 IP。如果数据库没有就新增服务信息,如果数据库有就更新服务对应 IP。</li>

</ul>

<p><strong>(2)收集覆盖率数据</strong></p>

<p>为了做覆盖率统计,需要从微服务部署的容器中下载测试覆盖率 Dump 文件。我们采用的解决方案是使用 JavaAgent 代理,首先对微服务部署的容器进行了改造,使得容器支持 JavaAgent 功能;其次为了动态插桩记录被测代码的运行结果,在被测微服务的 JVM 启动脚本中增加 JavaAgent 参数。</p>

<p>覆盖率工具根据 IP 和监听端口通过 JavaAgent 代理从容器中下载 Dump 文件,以环境和服务标识唯一 Dump 文件,并存储到 jCover 所在的服务器。在下载覆盖率数据时采用追加方式,如果该 Dump 覆盖率文件已存在,那么该轮的覆盖率数据会直接在文本末尾进行追加,便于统计整个测试过程的代码覆盖结果。</p>

<p><strong>(3)根据全量覆盖率文件生成全量覆盖率报告</strong></p>

<ol>

<li>MONE 从微服务容器中拷贝 Class 文件到 jCover 所在服务器指定目录</li>

<li>jCover 通过 Class 文件和 Dump 文件生成全量覆盖率文件</li>

<li>根据全量覆盖率文件生成全量的测试覆盖率报告,把全量的测试覆盖率报告以「隔离环境标识+服务名称+顺序 ID」的维度存储到 jCover 所在服务器的指定目录</li>

<li>最后配置静态资源映射规则生成测试覆盖率报告 URL 并把测试覆盖率报告 URL 存储到数据库中</li>

</ol>

<p>用户打开测试覆盖率工具前端界面就可以在浏览器中查看步骤 D 生成的覆盖率报告了,绿色表示被覆盖,红色表示未被覆盖,黄色表示部分覆盖:</p>

<p><img src="/img/remote/1460000021568735" alt="" title=""></p>

<p>图 5:全量测试覆盖率报告展示</p>

<h4>4. 增量覆盖率统计</h4>

<p>业务发展到一定阶段后,代码量级很大。主干代码我们默认是正确的代码。当一个新需求提测后,测试人员更关注的其实是针对本次需求更改的代码的覆盖率而不是全部代码的覆盖率,想从全量覆盖率报告中找出本次更改的增量代码的覆盖率是非常困难的。基于此问题我们开发了增量覆盖率统计功能。</p>

<p>增量覆盖率统计和全量覆盖率统计有三个相同的步骤:查询服务信息、收集覆盖率数据、生成全量覆盖率文件。生成全量覆盖率文件后,增量覆盖率统计的不同点是增加了以下处理:增量代码获取、生成增量覆盖率报告,具体实现如下:</p>

<p><strong>(1)Diff 增量代码</strong></p>

<ol>

<li>分别获取每个微服务的 master 主干和测试分支内容,Diff 测试分支对象和 Master 分支对象,得到增量代码</li>

<li>滤除增量代码中的非.java 文件</li>

<li>循环遍历增量代码得到变化行,标识行变化类型包括:新增、更新</li>

</ol>

<p><strong>(2)生成增量覆盖率报告</strong></p>

<ul>

<li>根据增量代码变化行标识无变化的方法</li>

<li>在改变的代码行(改变包括增加和更新)行首加上对应的标识:「增加」的代码以「+++」标识,「更新」的代码以「U」标识,同时删除无变化的方法,生成增量代码覆盖率报告</li>

</ul>

<p><img src="/img/remote/1460000021568740" alt="" title=""></p>

<p>图 6:增量覆盖率流程</p>

<p>下图是交易服务增量覆盖率报告的截图示例,从图中清晰看出增量行和更新行的测试覆盖率情况。</p>

<p><img src="/img/remote/1460000021568737" alt="" title=""></p>

<p>图 7:增量覆盖率报告展示</p>

<h4>5. 支持手动/自动统计覆盖率</h4>

<p>当测试人员需要查看最新的测试覆盖率时,可以通过「jCover - 生成测试覆盖率报告」的入口手动触发生成测试覆盖率报告。</p>

<p><img src="/img/remote/1460000021568736" alt="" title=""></p>

<p>图 8:手动统计覆盖率图形化界面</p>

<p>在一个需求的实际测试中被测的微服务通常有多个。因为修改 Bug 等原因,被测微服务经常需要重启,重启后容器销毁,JavaAgent 插桩后的文件也会被删除导致重启前覆盖的代码无法被统计。</p>

<p>如果每次重启每个被测微服务前都需要测试人员手动生成覆盖率报告的话,是个很大的工作量也会经常被遗忘。因此 jCover 通过和发布系统结合实现了覆盖率自动统计功能。具体实现方法为 jCover 提供了自动生成覆盖率文件接口,在服务重启部署时后端发布系统调用此接口,实现自动统计覆盖率,不管服务重启多少次都可以把每次测试时覆盖的代码全部统计到。</p>

<p>之前大交通的后端服务发布系统为 Jenkins,后续升级为了 MONE,两种发布系统下均支持服务部署时自动统计覆盖率。</p>

<h2>Part.4 工具效果</h2>

<p>经过一段时间推广使用和优化,现在大交通所有的需求提测后均使用 jCover,主要体现出以下几点优势:</p>

<ul>

<li>

<strong>可以支撑不同类型的覆盖率测试</strong>。jCover 可以统计手工测试、接口测试、回归测试、UI 自动化测试等各种类型测试的全部覆盖率,展示为一份覆盖率报告。</li>

<li>

<strong>及时发现漏测代码</strong>。通过使用测试覆盖率工具可以发现测试用例未覆盖的代码,反推测试用例缺失。例如在「虚舱管理」项目中国际交易支付前校验失败发送 MQ 消息没有覆盖,测试人员补充了支付前校验失败发消息的测试用例;在「国际搜索坑位供应商及价格优先级设置」项目中发现由于 Mock 数据的局限性, 带有辅营的加价代码未覆盖,补充了机票+辅营的测试用例,提高测试覆盖度。</li>

<li>

<strong>发现开发的冗余代码</strong>。例如:在「国际机票重复预订优化项目」中发现冗余代码,getBaseOrderDetail 方法无调用方,开发进行了删除。</li>

<li>

<strong>及时发现测试中的问题并改进,提高测试效率</strong>。在「国内供应商资源统一化」项目中测试人员执行了很多测试用例后,使用 jCover 查看覆盖率报告发现应该覆盖的代码未被覆盖,与开发沟通后发现控制这部分代码逻辑的开关是「关闭」状态,此开关应该是在「打开」状态进行测试</li>

<li>

<strong>为上线代码审批提供数据参考</strong>。当团队成员申请代码上线时,开发 TL 可以重点关注未覆盖部分代码,减少线上问题发生。</li>

<li><strong>辅助提升测试人员对被测代码的熟悉度。</strong></li>

</ul>

<h2>Part.5 近期规划</h2>

<p>目前 jCover 只支持查看每一个类覆盖行和未覆盖行是什么,但是对于一个微服务整体行覆盖率是多少没有统计,我们正在开发<strong>增量覆盖率百分比</strong>,帮助开发和测试做出准确的判断。目前也在调研前端的覆盖率统计,下一步将实现前端的覆盖率统计工具 jCover。</p>

<p>在日常需求测试中可以采用测试(手工测试、接口测试、回归测试等)+jCover 覆盖分析的测试方法来完善测试场景,减少测试遗漏,确保测试的充分性,但需要注意的是 jCover 统计只能展示哪些代码被覆盖了,代码的正确性还是需要用例的执行结果正确来保障;还有时候开发会漏开发某部分需求,此时依靠 jCover 是无法发现这部分遗漏代码的,因此除了 jCover 之外可以通过参与技术评审、编写用例时参考产品功能矩阵图等多种手段发现问题,全方位保障被测代码的质量。</p>

<p>以上就是对马蜂窝大交通测试覆盖率统计工具 jCover 的分享。当然,统计代码覆盖率仅仅是一种手段,覆盖率高不一定代表质量好,但覆盖率不高的代码质量风险肯定很高。只有清楚在覆盖率统计数据背后反映出的问题,才能从根本上保证软件整体的质量。</p>

<p><strong>本文作者</strong>:代春美,马蜂窝测试部-交易测试工程师;孙海燕,马蜂窝测试部-交易测试团队负责人。</p>

<p><img src="/img/remote/1460000021568738" alt="" title=""></p>

Kafka 集群在马蜂窝大数据平台的优化与应用扩展

https://segmentfault.com/a/1190000021478249

2020-01-03T14:26:40+08:00

2020-01-03T14:26:40+08:00

马蜂窝技术

https://segmentfault.com/u/mafengwojishu

4

<blockquote><em>马蜂窝技术原创文章,更多干货请订阅公众号:mfwtech</em></blockquote>

<p>Kafka 是当下热门的消息队列中间件,它可以实时地处理海量数据,具备高吞吐、低延时等特性及可靠的消息异步传递机制,可以很好地解决不同系统间数据的交流和传递问题。</p>

<p>Kafka 在马蜂窝也有非常广泛的应用,为很多核心的业务提供支撑。本文将围绕 Kafka 在马蜂窝大数据平台的应用实践,介绍相关业务场景、在 Kafka 应用的不同阶段我们遇到了哪些问题以及如何解决、之后还有哪些计划等。</p>

<h2>Part.1 应用场景</h2>

<p>从 Kafka 在大数据平台的应用场景来看,主要分为以下三类:</p>

<p><strong>第一类是将 Kafka 作为数据库</strong>,提供大数据平台对实时数据的存储服务。从来源和用途两个维度来说,可以将实时数据分为业务端 DB 数据、监控类型日志、基于埋点的客户端日志 (H5、WEB、APP、小程序) 和服务端日志。</p>

<p><strong>第二类是为数据分析提供数据源</strong>,各埋点日志会作为数据源,支持并对接公司离线数据、实时数据仓库及分析系统,包括多维查询、实时 Druid OLAP、日志明细等。</p>

<p><strong>第三类是为业务方提供数据订阅</strong>。除了在大数据平台内部的应用之外,我们还使用 Kafka 为推荐搜索、大交通、酒店、内容中心等核心业务提供数据订阅服务,如用户实时特征计算、用户实时画像训练及实时推荐、反作弊、业务监控报警等。</p>

<p>主要应用如下图所示:</p>

<p><img src="/img/remote/1460000021478254" alt="" title=""></p>

<h2>Part.2 演进之路</h2>

<h3>四个阶段</h3>

<p>早期大数据平台之所以引入 Kafka 作为业务日志的收集处理系统,主要是考虑到它高吞吐低延迟、多重订阅、数据回溯等特点,可以更好地满足大数据场景的需求。但随着业务量的迅速增加,以及在业务使用和系统维护中遇到的问题,例如注册机制、监控机制等的不完善,导致出现问题无法快速定位,以及一些线上实时任务发生故障后没有快速恢复导致消息积压等, 使 Kafka 集群的稳定性和可用性得受到挑战,经历了几次严重的故障。</p>

<p>解决以上问题对我们来说迫切而棘手。针对大数据平台在使用 Kafka 上存在的一些痛点,我们从集群使用到应用层扩展做了一系列的实践,整体来说包括四个阶段:</p>

<p><strong>第一阶段:版本升级</strong>。围绕平台数据生产和消费方面存在的一些瓶颈和问题,我们针对目前的 Kafka 版本进行技术选型,最终确定使用 1.1.1 版本。</p>

<p><strong>第二阶段:资源隔离</strong>。为了支持业务的快速发展,我们完善了多集群建设以及集群内 Topic 间的资源隔离。</p>

<p><strong>第三阶段:</strong><strong>权限控制和监控告警。</strong></p>

<p>首先在安全方面,早期的 Kafka 集群处于裸跑状态。由于多产品线共用 Kafka,很容易由于误读其他业务的 Topic 导致数据安全问题。因此我们基于 SASL/ SCRAM + ACL 增加了鉴权的功能。</p>

<p>在监控告警方面,Kafka 目前已然成为实时计算中输入数据源的标配,那么其中 Lag 积压情况、吞吐情况就成为实时任务是否健康的重要指标。因此,大数据平台构建了统一的 Kafka 监控告警平台并命名「雷达」,多维度监控 Kafka 集群及使用方情况。</p>

<p><strong>第四阶段:应用扩展</strong>。早期 Kafka 在对公司各业务线开放的过程中,由于缺乏统一的使用规范,导致了一些业务方的不正确使用。为解决该痛点,我们构建了实时订阅平台,通过应用服务的形式赋能给业务方,实现数据生产和消费申请、平台的用户授权、使用方监控告警等众多环节流程化自动化,打造从需求方使用到资源全方位管控的整体闭环。</p>

<p>下面围绕几个关键点为大家展开介绍。</p>

<h3>核心实践</h3>

<h4>1. 版本升级</h4>

<p>之前大数据平台一直使用的是 0.8.3 这一 Kafka 早期版本,而截止到当前,Kafka 官方最新的 Release 版本已经到了 2.3,于是长期使用 0.8 版本过程中渐渐遇到的很多瓶颈和问题,我们是能够通过版本升级来解决的。</p>

<p>举例来说,以下是一些之前使用旧版时常见的问题:</p>

<ul>

<li>缺少对 Security 的支持:存在数据安全性问题及无法通过认证授权对资源使用细粒度管理</li>

<li>broker under replicated:发现 broker 处于 under replicated 状态,但不确定问题的产生原因,难以解决。</li>

<li>新的 feature 无法使用:如事务消息、幂等消息、消息时间戳、消息查询等。</li>

<li>客户端的对 offset 的管理依赖 zookeeper, 对 zookeeper 的使用过重, 增加运维的复杂度</li>

<li>监控指标不完善:如 topic、partition、broker 的数据 size 指标, 同时 kafka manager 等监控工具对低版本 kafka 支持不好</li>

</ul>

<p>同时对一些目标版本的特性进行了选型调研,如:</p>

<ul>

<li>0.9 版本, 增加了配额和安全性, 其中安全认证和授权是我们最关注的功能</li>

<li>0.10 版本,更细粒度的时间戳. 可以基于偏移量进行快速的数据查找,找到所要的时间戳。这在实时数据处理中基于 Kafka 数据源的数据重播是极其重要的</li>

<li>0.11 版本, 幂等性和 Transactions 的支持及副本数据丢失/数据不一致的解决。</li>

<li>1.1 版本,运维性的提升。比如当 Controller Shut Down,想要关闭一个 Broker 的时候,之前需要一个很长很复杂的过程在 1.0 版本得到很大的改善。</li>

</ul>

<p>最终选择 1.1 版本, 则是因为出于 Camus 与 Kafka 版本的兼容性及 1.1 版本已经满足了使用场景中重要新特性的支持的综合考量。这里再简单说一下 Camus 组件,同样是由 Linkedin 开源,在我们的大数据平台中主要作为 Kafka 数据 Dump 到 HDFS 的重要方式。</p>

<h4>2. 资源隔离</h4>

<p>之前由于业务的复杂性和规模不大,大数据平台对于 Kafka 集群的划分比较简单。于是,一段时间以后导致公司业务数据混杂在一起,某一个业务主题存在的不合理使用都有可能导致某些 Broker 负载过重,影响到其他正常的业务,甚至某些 Broker 的故障会出现影响整个集群,导致全公司业务不可用的风险。</p>

<p>针对以上的问题,在集群改造上做了两方面实践:</p>

<ul>

<li>按功能属性拆分独立的集群</li>

<li>集群内部 Topic 粒度的资源隔离</li>

</ul>

<p><strong>(1) 集群拆分</strong></p>

<p>按照功能维度拆分多个 Kafka 物理集群,进行业务隔离,降低运维复杂度。</p>

<p>以目前最重要的埋点数据使用来说, 目前拆分为三类集群,各类集群的功能定义如下:</p>

<ul>

<li>

<strong>Log 集群</strong>:各端的埋点数据采集后会优先落地到该集群, 所以这个过程不能出现由于 Kafka 问题导致采集中断,这对 Kafka 可用性要求很高。因此该集群不会对外提供订阅,保证消费方可控;同时该集群业务也作为离线采集的源头,数据会通过 Camus 组件按小时时间粒度 dump 到 HDFS 中,这部分数据参与后续的离线计算。</li>

<li>全量订阅集群:该集群 Topic 中的绝大部分数据是从 Log 集群实时同步过来的。上面我们提到了 Log 集群的数据是不对外的,因此全量集群就承担了消费订阅的职责。目前主要是用于平台内部的实时任务中,来对多个业务线的数据分析并提供分析服务。</li>

<li>

<strong>个性定制集群</strong>:之前提到过,我们可以根据业务方需求来拆分、合并数据日志源,同时我们还支持定制化 Topic,该集群只需要提供分流后 Topic 的落地存储。</li>

</ul>

<p>集群整体架构划分如下图:</p>

<p><img src="/img/remote/1460000021478253" alt="" title=""></p>

<p><strong>(2) 资源隔离</strong></p>

<p>Topic 的流量大小是集群内部进行资源隔离的重要依据。例如,我们在业务中埋点日志量较大的两个数据源分别是后端埋点数据源 server-event 和端上的埋点 mobile-event 数据源,我们要避免存储两个数据的主题分区分配到集群中同一个 Broker 上的节点。通过在不同 Topic 进行物理隔离,就可以避免 Broker 上的流量发生倾斜。</p>

<h4>3. 权限控制和监控告警</h4>

<p><strong>(1) 权限控制</strong></p>

<p>开始介绍时我们说过,早期 Kafka 集群没有设置安全验证处于裸跑状态,因此只要知道 Broker 的连接地址即可生产消费,存在严重的数据安全性问题。</p>

<p>一般来说, 使用 SASL 的用户多会选择 Kerberos,但就平台 Kafka 集群的使用场景来说,用户系统并不复杂,使用 Kerberos 就有些大材小用, 同时 Kerberos 相对复杂,存在引发其他问题的风险。另外,在 Encryption 方面, 由于都是运行在内网环境,所以并没有使用 SSL 加密。</p>

<p>最终平台 Kafka 集群使用 SASL 作为鉴权方式, 基于 SASL/ SCRAM + ACL 的轻量级组合方式,实现动态创建用户,保障数据安全。</p>

<p><strong>(2) 监控告警</strong></p>

<p>之前在集群的使用中我们经常发现,消费应用的性能无缘无故变差了。分析问题的原因, 通常是滞后 Consumer 读取的数据大概率没有命中 Page- cache,导致 Broker 端机器的内核要首先从磁盘读取数据加载到 Page- cache 中后,才能将结果返还给 Consumer,相当于本来可以服务于写操作的磁盘现在要读取数据了, 影响了使用方读写同时降低的集群的性能。</p>

<p>这时就需要找出滞后 Consumer 的应用进行事前的干预从而减少问题发生,因此监控告警无论对平台还是用户都有着重大的意义。下面介绍一下我们的实践思路。</p>

<p><strong>整体方案:</strong></p>

<p>整体方案主要是基于开源组件 Kafka JMX Metrics+OpenFalcon+Grafana:</p>

<ul>

<li>Kafka JMX Metrics:Kafka broker 的内部指标都以 JMX Metrics 的形式暴露给外部。1.1.1 版本 提供了丰富的监控指标,满足监控需要</li>

<li>OpenFalcon:小米开源的一款企业级、高可用、可扩展的开源监控系统</li>

<li>Grafana:Metrics 可视化系统,大家比较熟悉,可对接多种 Metrics 数据源。</li>

</ul>

<p><strong>关于监控:</strong></p>

<ul>

<li>Falcon-agent:部署到每台 Broker 上, 解析 Kafka JMX 指标上报数据</li>

<li>Grafana:用来可视化 Falcon Kafka Metrics 数据,对 Cluster、Broker、Topic、Consumer 4 个角色制作监控大盘。</li>

<li>Eagle:获取消费组 Active 状态、消费组 Lag 积压情况,同时提供 API,为监控告警系统「雷达」提供监控数据。</li>

</ul>

<p><strong>关于告警:</strong></p>

<p><strong>雷达系统</strong>: 自研监控系统,通过 Falcon 及 Eagle 获取 Kafka 指标,结合设定阈值进行告警。以消费方式举例,Lag 是衡量消费情况是否正常的一个重要指标,如果 Lag 一直增加,必须要对它进行处理。</p>

<p>发生问题的时候,不仅 Consumer 管理员要知道,它的用户也要知道,所以报警系统也需要通知到用户。具体方式是通过企业微信告警机器人自动提醒对应消费组的负责人或使用者及 Kafka 集群的管理者。</p>

<p><strong>监控示例:</strong></p>

<p><img src="/img/remote/1460000021478252" alt="" title=""></p>

<p><img src="/img/remote/1460000021478256" alt="" title=""></p>

<p><img src="/img/remote/1460000021478255" alt="" title=""></p>

<p><img src="/img/remote/1460000021478257" alt="" title=""></p>

<p><img src="/img/remote/1460000021478260" alt="" title=""></p>

<p><img src="/img/remote/1460000021478258" alt="" title=""></p>

<p><img src="/img/remote/1460000021478259" alt="" title=""></p>

<p><img src="/img/remote/1460000021478261" alt="" title=""></p>

<h4>4. 应用扩展</h4>

<p><strong>(1) 实时数据订阅平台 </strong></p>

<p>实时数据订阅平台是一个提供 Kafka 使用全流程管理的系统应用,以工单审批的方式将数据生产和消费申请、平台用户授权、使用方监控告警等众多环节流程化自动化, 并提供统一管控。</p>

<p>核心思想是基于 Kafka 数据源的身份认证和权限控制,增加数据安全性的同时对 Kafka 下游应用进行管理。</p>

<p><strong>(2) 标准化的申请流程</strong></p>

<p>无论生产者还是消费者的需求,使用方首先会以工单的方式提出订阅申请。申请信息包括业务线、Topic、订阅方式等信息;工单最终会流转到平台等待审批;如果审批通过,使用方会分配到授权账号及 Broker 地址。至此,使用方就可以进行正常的生产消费了。</p>

<p><img src="/img/remote/1460000021478265" alt="" title=""></p>

<p><img src="/img/remote/1460000021478267" alt="" title=""></p>

<p><strong>(3) 监控告警</strong></p>

<p>对于平台来说,权限与资源是绑定的,资源可以是用于生产的 Topic 或消费使用的 GroupTopic。一旦权限分配后,对于该部分资源的使用就会自动在我们的雷达监控系统进行注册,用于资源整个生命的周期的监控。 </p>

<p><strong>(4) 数据重播</strong></p>

<p>出于对数据完整性和准确性的考量,目前 Lamda 架构已经是大数据的一种常用架构方式。但从另一方面来说,Lamda 架构也存在资源的过多使用和开发难度高等问题。</p>

<p>实时订阅平台可以为消费组提供任意位点的重置,支持对实时数据按时间、位点等多种方式的数据重播, 并提供对 Kappa 架构场景的支持,来解决以上痛点。</p>

<p><img src="/img/remote/1460000021478263" alt="" title=""></p>

<p><strong>(5) 主题管理</strong></p>

<p>为什么提供主题管理?举一些很简单的例子,比如当我们想让一个用户在集群上创建他自己的 Kafka Topic,这时显然是不希望让他直接到一个节点上操作的。因此刚才所讲的服务,不管是对用户来讲,还是管理员来讲,我们都需要有一个界面操作它,因为不可能所有人都通过 SSH 去连服务器。</p>

<p>因此需要一个提供管理功能的服务,创建统一的入口并引入主题管理的服务,包括主题的创建、资源隔离指定、主题元数据管理等。</p>

<p><img src="/img/remote/1460000021478266" alt="" title=""></p>

<p><strong>(6) 数据分流</strong></p>

<p>在之前的架构中, 使用方消费 Kafka 数据的粒度都是每个 Kafka Topic 保存 LogSource 的全量数据,但在使用中很多消费方只需要消费各 LogSource 的部分数据,可能也就是某一个应用下几个埋点事件的数据。如果需要下游应用自己写过滤规则,肯定存在资源的浪费及使用便捷性的问题;另外还有一部分场景是需要多个数据源 Merge 在一起来使用的。</p>

<p>基于上面的两种情况, 我人实现了按业务方需求拆分、合并并定制化 Topic 支持跨数据源的数据合并及 appcode 和 event code 的任意组个条件的过滤规则。</p>

<p><img src="/img/remote/1460000021478262" alt="" title=""></p>

<h2>Part.3 后续计划</h2>

<ul>

<li>

<strong>解决数据重复问题</strong>。为了解决目前平台实时流处理中因故障恢复等因素导致数据重复的问题,我们正在尝试用 Kafka 的事务机制结合 Flink 的两段提交协议实现端到端的仅一次语义。目前已经在平台上小范围试用, 如果通过测试,将会在生产环境下推广。</li>

<li>

<strong>Consumer 限流</strong>。在一写多读场景中, 如果某一个 Consumer 操作大量读磁盘, 会影响 Produce 级其他消费者操作的延迟。l 因此,通过 Kafka Quota 机制对 Consume 限流及支持动态调整阈值也是我们后续的方向</li>

<li>

<strong>场景扩展</strong>。基于 Kafka 扩展 SDK、HTTP 等多种消息订阅及生产方式,满足不同语言环境及场景的使用需求。</li>

</ul>

<p>以上就是关于 Kafka 在马蜂窝大数据平台应用实践的分享,如果大家有什么建议或者问题,欢迎在马蜂窝技术公众号后台留言。</p>

<p><strong>本文作者:毕博,马蜂窝大数据平台研发工程师。</strong></p>

<p><img src="/img/remote/1460000021478264" alt="" title=""></p>

OpenResty 在马蜂窝广告监测中的应用

https://segmentfault.com/a/1190000021417557

2019-12-27T10:58:27+08:00

2019-12-27T10:58:27+08:00

马蜂窝技术

https://segmentfault.com/u/mafengwojishu

10

<blockquote><em>马蜂窝技术原创内容,更多干货请订阅公众号:mfwtech</em></blockquote>

<p>广告是互联网变现的重要手段之一。</p>

<p>以马蜂窝旅游 App 为例,当用户打开我们的应用时,有可能会在首屏或是信息流、商品列表中看到推送的广告。如果刚好对广告内容感兴趣,用户就可能会点击广告了解更多信息,进而完成这条广告希望完成的后续操作,如下载广告推荐的 App 等。</p>

<p>广告监测平台的任务就是持续、准确地收集用户在浏览和点击广告这些事件中携带的信息,包括来源、时间、设备、位置信息等,并进行处理和分析,来为广告主提供付费结算以及评估广告投放效果的依据。</p>

<p>因此,一个可靠、准确的监测服务非常重要。为了更好地保障平台和广告主双方的权益,以及为提升马蜂窝旅游网的广告服务效果提供支撑,我们也在不断地探索适合的解决方案,加强广告监测服务的能力。</p>

<h2>Part.1 初期形态</h2>

<p>初期我们的广告监测并没有形成完整的服务对外开放,因此实现方式及提供的能力也比较简单,主要分为两部分:一是基于客户端打点,针对事件进行上报;另一部分是针对曝光、点击链接做转码存档,当请求到来后解析跳转。</p>

<p>但是很快,这种方式的弊端就暴露出来,主要体现在以下几个方面:</p>

<ul>

<li>

<strong>收数的准确性</strong>:数据转发需要访问中间件才能完成,增加了多段丢包的机率。在和第三方监测服务进行对比验证时,Gap 差异较大;</li>

<li>

<strong>数据的处理能力</strong>:收集的数据来自于各个业务系统,缺乏统一的数据标准,数据的多种属性导致解析起来很复杂,增加了综合数据二次利用的难度;</li>

<li>

<strong>突发流量:</strong>当流量瞬时升高,就会遇到 Redis 内存消耗高、服务掉线频繁的问题;</li>

<li>

<strong>部署复杂</strong>:随着不同设备、不同广告位的变更,打点趋于复杂,甚至可能会覆盖不到;</li>

<li>

<strong>开发效率</strong>:初期的广告监测功能单一,例如对实时性条件的计算查询等都需要额外开发,非常影响效率。</li>

</ul>

<h2>Part.2 基于 OpenResty 的架构实现</h2>

<p>在这样的背景下,我们打造了马蜂窝广告数据监测平台 ADMonitor,希望逐步将其实现成一个稳定、可靠、高可用的广告监测服务。</p>

<h3>2.1 设计思路</h3>

<p>为了解决老系统中的各种问题,我们引入了新的监测流程。主体流程设计为:</p>

<ol>

<li>在新的监测服务 (ADMonitor) 上生成关于每种广告独有的监测链接,同时附在原有的客户链接上;</li>

<li>所有从服务端下发的曝光链接和点击链接并行依赖 ADMonitor 提供的服务;</li>

<li>客户端针对曝光行为进行并行请求,点击行为会优先跳转到 ADMonitor,由 ADMonitor 来做二段跳转。</li>

</ol>

<p><img src="/img/bVbB1N1" alt="流程.png" title="流程.png"></p>

<p>通过以上方式,使监测服务完全依赖 ADMonitor,极大地增加了监测部署的灵活性及整体服务的性能;同时为了进一步验证数据的准确性,我们保留了打点的方式进行对比。</p>

<h3>2.2 技术选型</h3>

<p>为了使上述流程落地,广告监测的流量入口必须要具备高可用、高并发的能力,尽量减少非必要的网络请求。考虑到内部多个系统都需要流量,为了降低系统对接的人力成本,以及避免由于系统迭代对线上服务造成干扰,我们首先要做的就是把流量网关独立出来。</p>

<p>关于 C10K 编程相关的技术业内有很多解决方案,比如 OpenResty、JavaNetty、Golang、NodeJS 等。它们共同的特点是使用一个进程或线程可以同时处理多个请求,基于线程池、基于多协程、基于事件驱动+回调、实现 I/O 非阻塞。</p>

<p>我们最终选择基于 OpenResty 构建广告监测平台,主要是对以下方面的考虑:</p>

<p><strong>第一</strong>,OpenResty 工作在网络的 7 层之上,依托于比 HAProxy 更为强大和灵活的正则规则,可以针对 HTTP 应用的域名、目录结构做一些分流、转发的策略,既能做负载又能做反向代理;</p>

<p><strong>第二</strong>,OpenResty 具有 Lua协程+Nginx 事件驱动的「事件循环回调机制」,也就是 Openresty 的核心 Cosoket,对远程后端诸如 MySQL、Memcached、Redis 等都可以实现同步写代码的方式实现非阻塞 I/O;</p>

<p><strong>第三</strong>,依托于 LuaJit,即时编译器会将频繁执行的代码编译成机器码缓存起来,当下次调用时将直接执行机器码,相比原生逐条执行虚拟机指令效率更高,而对于那些只执行一次的代码仍然可以逐条执行。</p>

<h3>2.3 架构实现</h3>

<p>整体方案依托于 OpenResty 的处理机制,在服务器内部进行定制开发,主要划分为<strong>数据收集、数据处理与数据归档</strong>三大部分,实现异步拆分请求与 I/O 通信。整体结构示意图如下:</p>

<p><img src="/img/bVbB1O5" alt="架构.png" title="架构.png"></p>

<p>我们将多 Woker 日志信息以双端队列的方式存入 Master 共享内存,开启 Worker 的 Timer 毫秒级定时器,离线解析流量。</p>

<h4><strong>2.3.1 数据收集</strong></h4>

<p>收集部分也是主体承受流量压力最大的部分。我们使用 Lua 来做整体检参、过滤与推送。由于在我们的场景中,数据收集部分不需要考虑时序或对数据进行聚合处理,因此核心的推送介质选择 Lua 共享内存即可,以 I/O 请求来代替访问其他中间件所需要的网络服务,从而减少网络请求,满足即时性的要求,如下所示:</p>

<p><img src="/img/bVbB1O7" alt="企业微信截图_1ad8c6b4-39b2-4107-957b-5d0e1a6ed2b1.png" title="企业微信截图_1ad8c6b4-39b2-4107-957b-5d0e1a6ed2b1.png"></p>

<p>下面结合 OpenResty 配置,介绍一些我们对服务器节点进行的优化:</p>

<ol>

<li>设置 lua 缓存-lua_code_cache:<p>(1)开启后会将 Lua 文件缓存到内存中,加速访问,但修改 Lua 代码需要 reload</p>

<p>(2)尽量避免全局变量的产生</p>

<p>(3)关闭后会依赖 Woker 进程中生成自己新的 LVM</p>

</li>

<li>设置 Resolver 对于网络请求、好的 DNS 节点或者自建的 DNS 节点在网络请求很高的情况下会很有帮助:<p>(1)增加公司的 DNS 服务节点与补偿的公网节点</p>

<p>(2)使用 shared 来减少 Worker 查询次数</p>

</li>

<li>设置 epoll (multi_accept/accept_mutex/worker_connections):<p>(1)设置 I/O 模型、防止惊群</p>

<p>(2)避免服务节点浪费资源做无用处理而影响整体流转等</p>

</li>

<li>设置 keepalive:<p>(1)包含链接时长与请求上限等</p>

</li>

</ol>

<p>配置优化一方面是要符合当前请求场景,另一方面要配合 Lua 发挥更好的性能。设置 Nginx 服务器参数基础是根据不同操作系统环境进行调优,比如 Linux 中一切皆文件、调整文件打开数、设置 TCP Buckets、设置 TIME_WAIT 等。</p>

<h4><strong>2.3.2 数据处理</strong></h4>

<p>这部分流程是将收集到的数据先通过 ETL,之后创建内部的日志 location,结合 Lua 自定义 log_format,利用 Nginx 子请求特性离线完成数据落盘,同时保证数据延迟时长在毫秒级。</p>

<p>对被解析的数据处理要进行两部分工作,一部分是 ETL,另一部分是 Count。</p>

<p><strong>(1)ETL</strong></p>

<p><img src="/img/bVbB1Pf" alt="WX20191226-170748.png" title="WX20191226-170748.png"></p>

<p>主要流程:</p>

<ol>

<li>日志经过统一格式化之后,抽取包含实际意义参数部分进行数据解析</li>

<li>将抽取后的数据进行过滤,针对整体字符集、IP、设备、UA、相关标签信息等进行处理</li>

<li>将转化后的数据进行重加载与日志重定向</li>

</ol>

<p>【例】Lua 利用 FFI 通过 IP 库解析 "ip!"用 C 把 IP 库拷贝到内存中,Lua 进行毫秒级查询:</p>

<p><img src="/img/bVbB1Pg" alt="举个例子.png" title="举个例子.png"></p>

<p><strong>(2)Count</strong></p>

<p>对于广告数据来说,绝大部分业务需求都来自于数据统计,这里直接使用 Redis+FluxDB 存储数据,以有下几个关键的技术点:</p>

<ul>

<li>RDS 结合 Lua 设置链接时间,配置链接池来增加链接复用</li>

<li>RDS 集群服务实现去中心化,分散节点压力,增加 AOF与延时入库保证可靠</li>

<li>FluxDB 保证数据日志时序性可查,聚合统计与实时报表表现较优</li>

</ul>

<h4><strong>2.3.3 数据归档</strong></h4>

<p>数据归档需要对全量数据入表,这个过程中会涉及到对一些无效数据进行过滤处理。这里整体接入了公司的大数据体系,流程上分为在线处理和离线处理两部分,能够对数据回溯。使用的解决方案是在线 Flink、离线 Hive,其中需要关注: </p>

<ul>

<li>ES 的索引与数据定期维护</li>

<li>Kafka 的消费情况</li>

<li>对于发生故障的机器使用自动脚本重启与报警等</li>

</ul>

<p><img src="/img/bVbB1Pj" alt="企业微信截图_421b3443-7c1f-4b9b-9948-49ee29a8e734(1).png" title="企业微信截图_421b3443-7c1f-4b9b-9948-49ee29a8e734(1).png"></p>

<p>实时数据源:数据采集服务→ Filebeat → Kafka → Flink → ES</p>

<p>离线数据源:HDFS → Spark → Hive → ES</p>

<p><strong>数据解析后的再利用:</strong></p>

<p>解析后的数据已经拥有了重复利用的价值。我们的主要应用场景有两大块。</p>

<p>一是 <strong>OLAP</strong>,针对业务场景与数据表现分析访问广告的人群属性标签变化情况,包含地域,设备,人群分布占比与增长情况等;同时,针对未来人群库存占比进行预测,最后影响到实际投放上。</p>

<p>另一部分是在 <strong>OLTP</strong>,主要场景为:</p>

<ul>

<li>判定用户是否属于广告受众区域</li>

<li>解析 UA 信息,获取终端信息,判断是否属于为低级爬虫流量</li>

<li>设备号打标,从 Redis 获取实时用户画像,进行实时标记等</li>

</ul>

<h3>2.4 OpenResty 其他应用场景</h3>

<p>OpenResty 在我们的广告数据监测服务全流程中均发挥着重要作用:</p>

<ul>

<li>init_worker_by_lua阶段:负责服务配置业务</li>

<li>access_by_lua阶段:负责CC防护、权限准入、流量时序监控等业务</li>

<li>content_by_lua阶段:负责实现限速器、分流器、WebAPI、流量采集等业务</li>

<li>log_by_lua阶段:负责日志落盘等业务</li>

</ul>

<p>重点解读以下两个应用的实现方式。</p>

<h4><strong>2.4.1 分流器业务</strong></h4>

<p>NodeJS 服务向 OpenResty 网关上报当前服务器 CPU 和内存使用情况;Lua 脚本调用 RedisCluster 获取时间窗口内 NodeJS 集群使用情况后,计算出负载较高的 NodeJS 机器;OpenResty 对 NodeJS 集群流量进行熔断、降级、限流等逻辑处理;将监控数据同步 InfluxDB,进行时序监测。</p>

<h4><strong>2.4.2 小型 WEB 防火墙</strong></h4>

<p>使用第三方开源 lua_resty_waf 类库实现,支持 IP 白名单和黑名单、URL 白名单、UA 过滤、CC 攻击防护功能。我们在此基础上增加了 WAF 对 InfluxDB 的支持,进行时序监控和服务预警。</p>

<h3>2.5 小结</h3>

<p>总结来看,基于 OpenResty 实现的广告监测服务 ADMonitor 具备以下特点:</p>

<ul>

<li>

<strong>高可用</strong>:依赖 OpenResty 做 Gateway,多节点做 HA</li>

<li>

<strong>立即返回</strong>:解析数据后利用 I/O 请求做数据异步处理,避免非必要的网络通信</li>

<li>

<strong>解耦功能模块</strong>:对请求、数据处理和转发实现解耦,缩减单请求串行处理耗时</li>

<li>

<strong>服务保障</strong>:针对重要的数据结果利用第三方组件单独存储</li>

</ul>

<p>完整的技术方案示意如下:</p>

<p><img src="/img/bVbB1Po" alt="WX20191226-174735.png" title="WX20191226-174735.png"></p>

<h2>Part.3 总结</h2>

<p>目前,ADMonitor 已经接入公司的广告服务体系,总体运行情况比较理想:</p>

<h4><strong>1. 性能效果</strong></h4>

<ul>

<li>达到了高吞吐、低延迟的标准</li>

<li>转发成功率高,曝光计数成功率>99.9%,点击成功率>99.8%</li>

</ul>

<h4><strong>2. 业务效果</strong></h4>

<ul>

<li>与主流第三方监测机构进行数据对比:曝光数据 GAP < 1%,点击数据GAP < 3%</li>

<li>可提供实时检索与聚合服务</li>

</ul>

<p>未来我们将结合业务发展和服务场景不断完善,期待和大家多多交流。</p>

<p><strong>本文作者:江明辉,马蜂窝旅游网品牌广告数据服务端组研发工程师。</strong></p>

<p><img src="/img/bVbvnxq" alt="微信公众号引导关注图.png" title="微信公众号引导关注图.png"></p>

Golang 在电商即时通讯服务建设中的实践

https://segmentfault.com/a/1190000021297135

2019-12-16T11:27:32+08:00

2019-12-16T11:27:32+08:00

马蜂窝技术

https://segmentfault.com/u/mafengwojishu

45

<blockquote><em>马蜂窝技术原创文章,更多干货请搜索公众号:mfwtech</em></blockquote>

<p>即时通讯(IM)功能对于电商平台来说非常重要,特别是旅游电商。</p>

<p>从商品复杂性来看,一个旅游商品可能会包括用户在未来一段时间的衣、食、住、行等方方面面;从消费金额来看,往往单次消费额度较大;对目的地的陌生、在行程中可能的问题,这些因素使用户在购买前、中、后都存在和商家沟通的强烈需求。可以说,一个好用的 IM 可以在一定程度上对企业电商业务的 GMV 起到促进作用。</p>

<p>本文我们将结合马蜂窝旅游电商 IM 服务的发展历程,重点介绍基于 Go 的 IM 重构,希望可以给有相似问题的朋友一些借鉴。</p>

<h2>Part.1 技术背景和问题</h2>

<p>与广义上的即时通讯不同,电商各业务线有其特有业务逻辑,如客服聊天系统的客人分配逻辑、敏感词检测逻辑等,这些往往要耦合进通信流程中。随着接入业务线越来越多,即时通讯服务冗余度会越来越高。同时整个消息链路追溯复杂,服务稳定性很受业务逻辑的影响。</p>

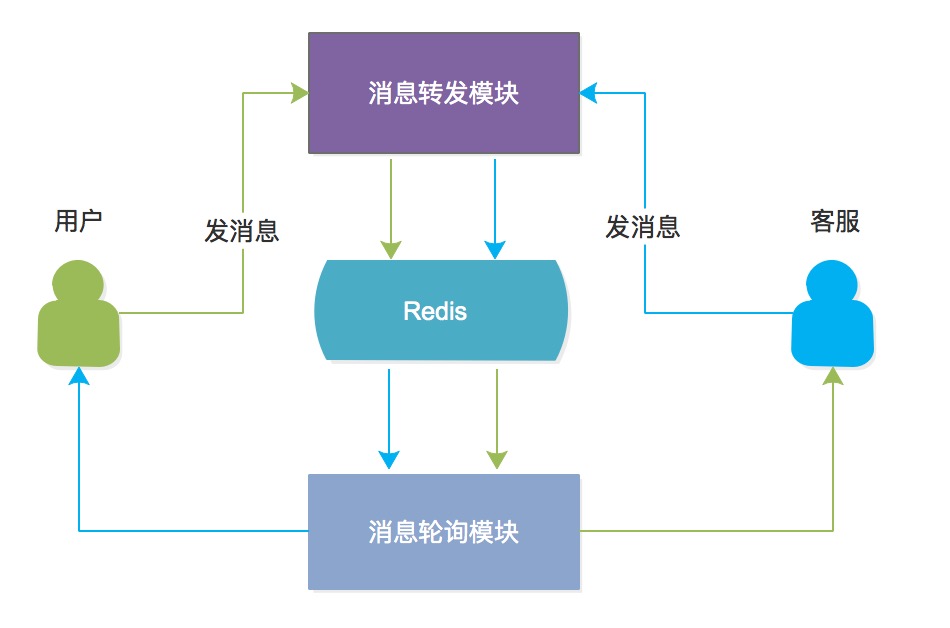

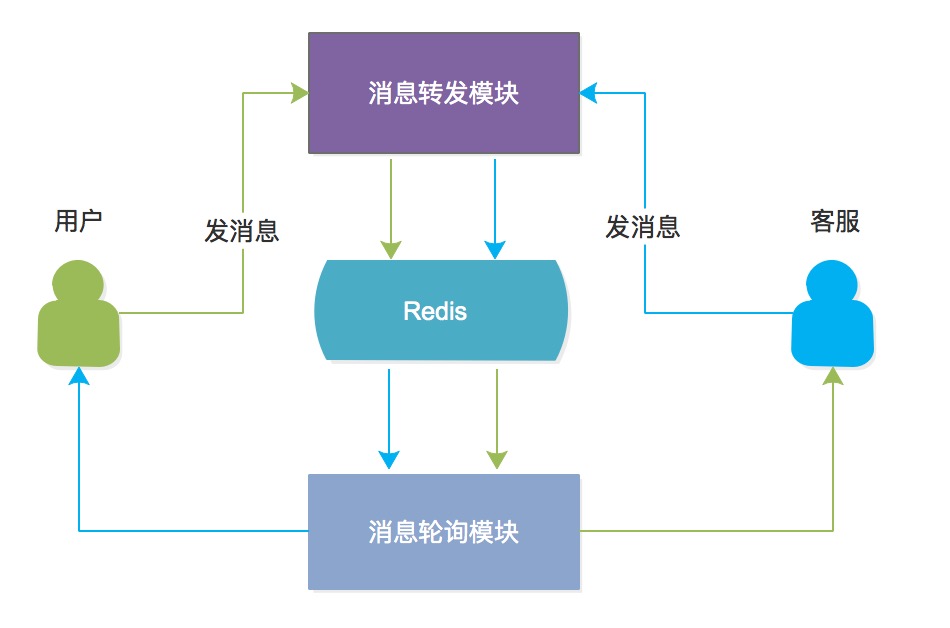

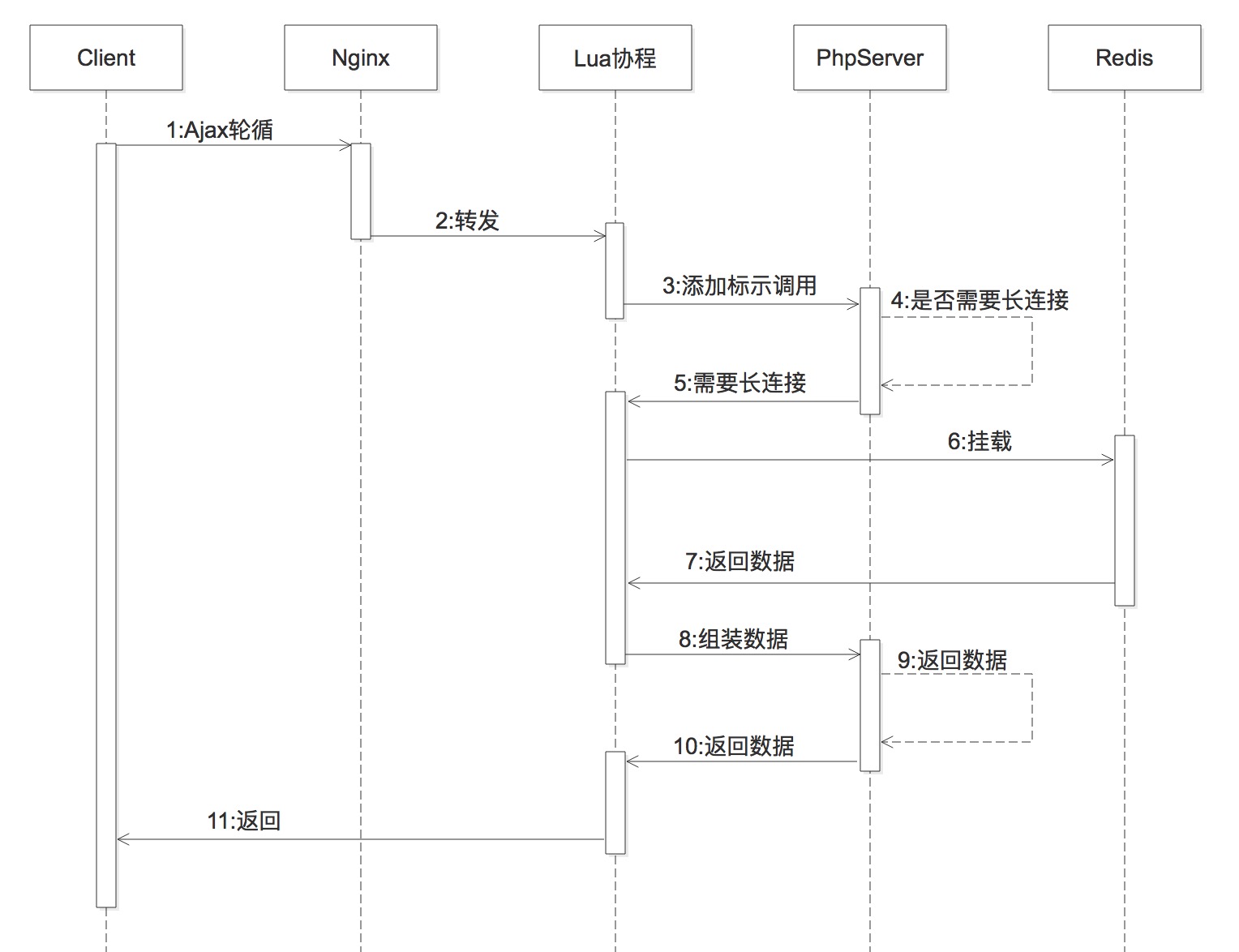

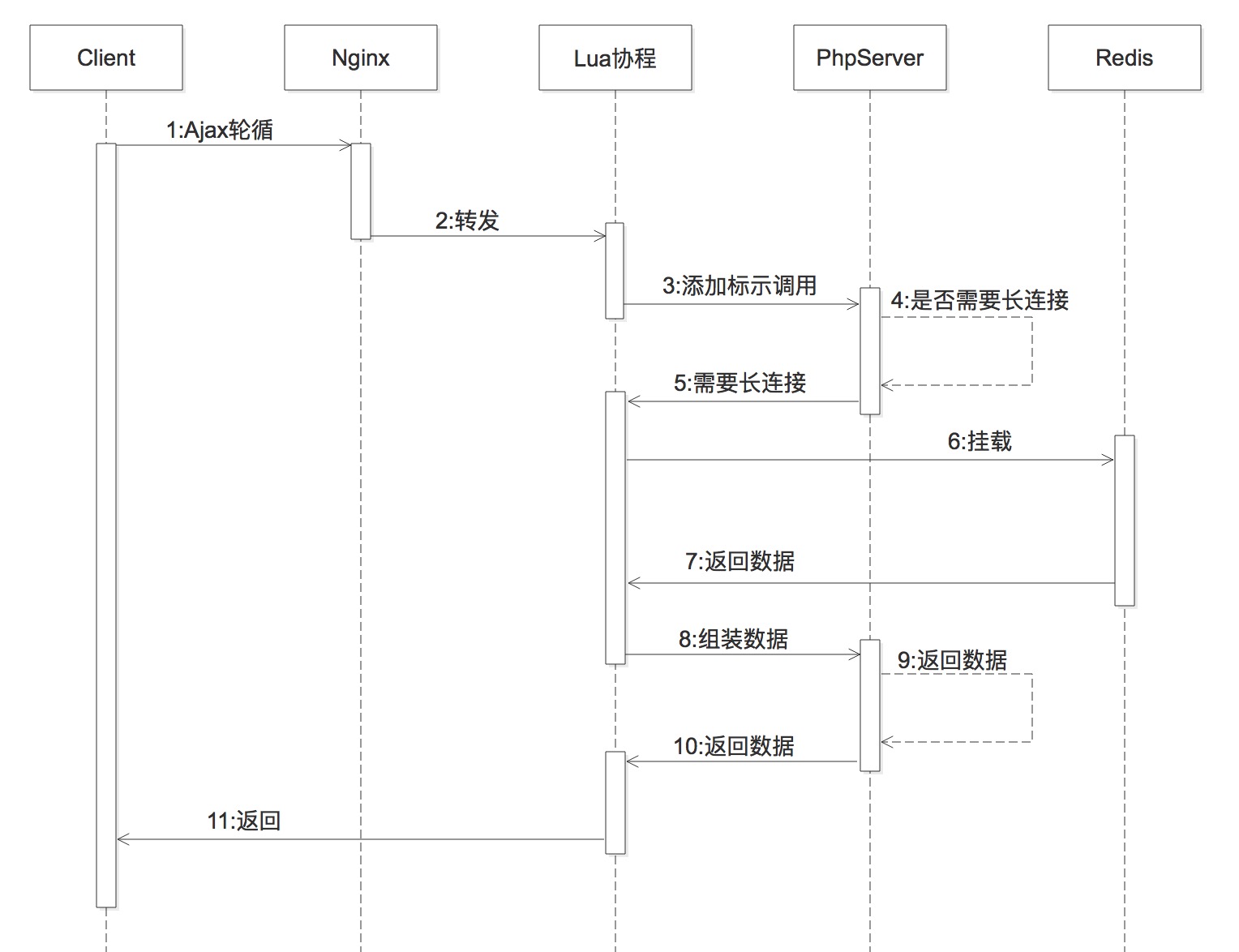

<p>之前我们 IM 应用中的消息推送主要基于轮询技术,消息轮询模块的长连接请求是通过 php-fpm 挂载在阻塞队列上实现。当请求量较大时,如果不能及时释放 php-fpm 进程,对服务器的性能消耗很大。</p>

<p>为了解决这个问题,我们曾用 OpenResty+Lua 的方式进行改造,利用 Lua 协程的方式将整体的 polling 的能力从 PHP 转交到 Lua 处理,释放一部 PHP 的压力。这种方式虽然能提升一部分性能,但 PHP-Lua 的混合异构模式,使系统在使用、升级、调试和维护上都很麻烦,通用性也较差,很多业务场景下还是要依赖 PHP 接口,优化效果并不明显。</p>

<p>为了解决以上问题,我们决定结合电商 IM 的特定背景对 IM 服务进行重构,核心是实现业务逻辑和即时通讯服务的分离。</p>

<h2>Part.2 基于Go的双层分布式IM架构</h2>

<h3>2.1 实现目标</h3>

<h5><strong>1. 业务解耦</strong></h5>

<p>将业务逻辑与通信流程剥离,使 IM 服务架构更加清晰,实现与电商 IM 业务逻辑的完全分离,保证服务稳定性。</p>

<h5><strong>2. 接入方式灵活</strong></h5>

<p>之前新业务接入时,需要在业务服务器上配置 OpenResty 环境及 Lua 协程代码,非常不便,IM 服务的通用性也很差。考虑到现有业务的实际情况,我们希望 IM 系统可以提供 HTTP 和 WebSocket 两种接入方式,供业务方根据不同的场景来灵活使用。</p>

<p>比如已经接入且运行良好的电商定制化团队的待办系统、定制游抢单系统、投诉系统等下行相关的系统等,这些业务没有明显的高并发需求,可以通过 HTTP 方式迅速接入,不需要熟悉稍显复杂的 WebSocket 协议,进而降低不必要的研发成本。</p>

<h5><strong>3. 架可扩展</strong></h5>

<p>为了应对业务的持续增长给系统性能带来的挑战,我们考虑用分布式架构来设计即时通讯服务,使系统具有持续扩展及提升的能力。</p>

<h3>2.2 语言选择</h3>

<p>目前,马蜂窝技术体系主要包括 PHP,Java,Golang,技术栈比较丰富,使业务做选型时可以根据问题场景选择更合适的工具和语言。</p>

<p>结合 IM 具体应用场景,我们选择 Go 的原因包括:</p>

<h5><strong>1. 性能</strong></h5>

<p>在性能上,尤其是针对网络通信等 IO 密集型应用场景。Go 系统的性能更接近 C/C++。</p>

<h5><strong>2. 开发效率</strong></h5>

<p>Go 使用起来简单,代码编写效率高,上手也很快,尤其是对于有一定 C++ 基础的开发者,一周就能上手写代码了。</p>

<h3>2.3 架构设计</h3>

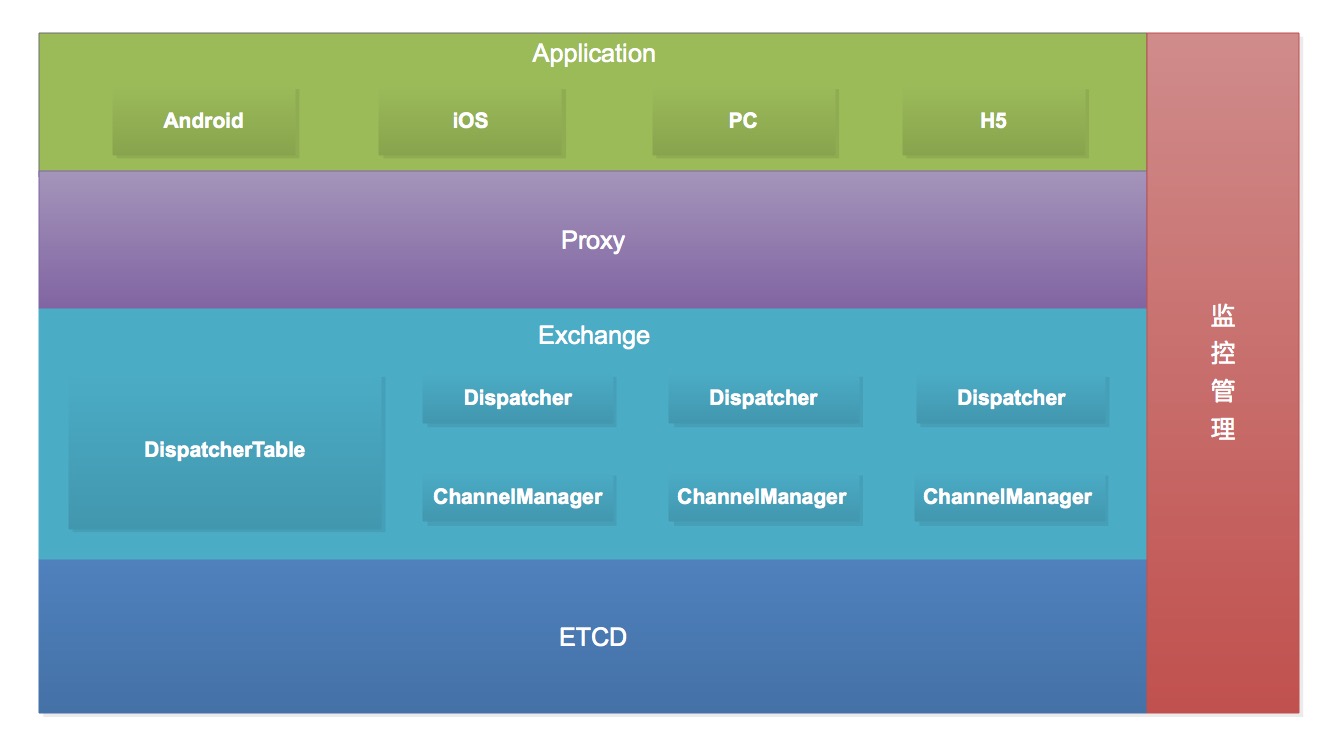

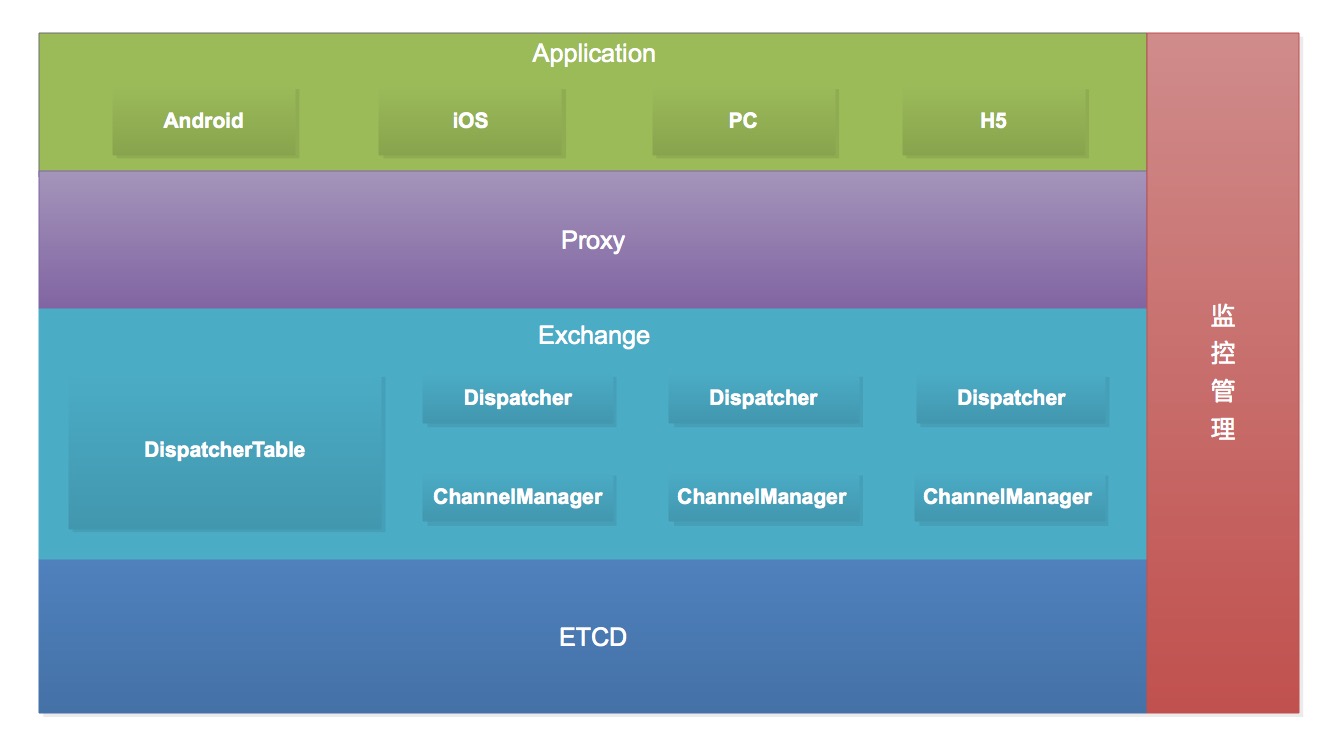

<p>整体架构图如下:</p>

<p><img src="/img/bVbBwu6" alt="架构.png" title="架构.png"></p>

<blockquote>

<p><em>名词解释:</em></p>

<ul>

<li>客户:一般指购买商品的用户</li>

<li>商家:提供服务的供应商,商家会有客服人员,提供给客户一个在线咨询的作用</li>

<li>分发模块:即 Dispatcher,提供消息分发的给指定的工作模块的桥接作用</li>

<li>工作模块:即 Worker 服务器,用来提供 WebSocket 服务,是真正工作的一个模块。</li>

</ul>

</blockquote>

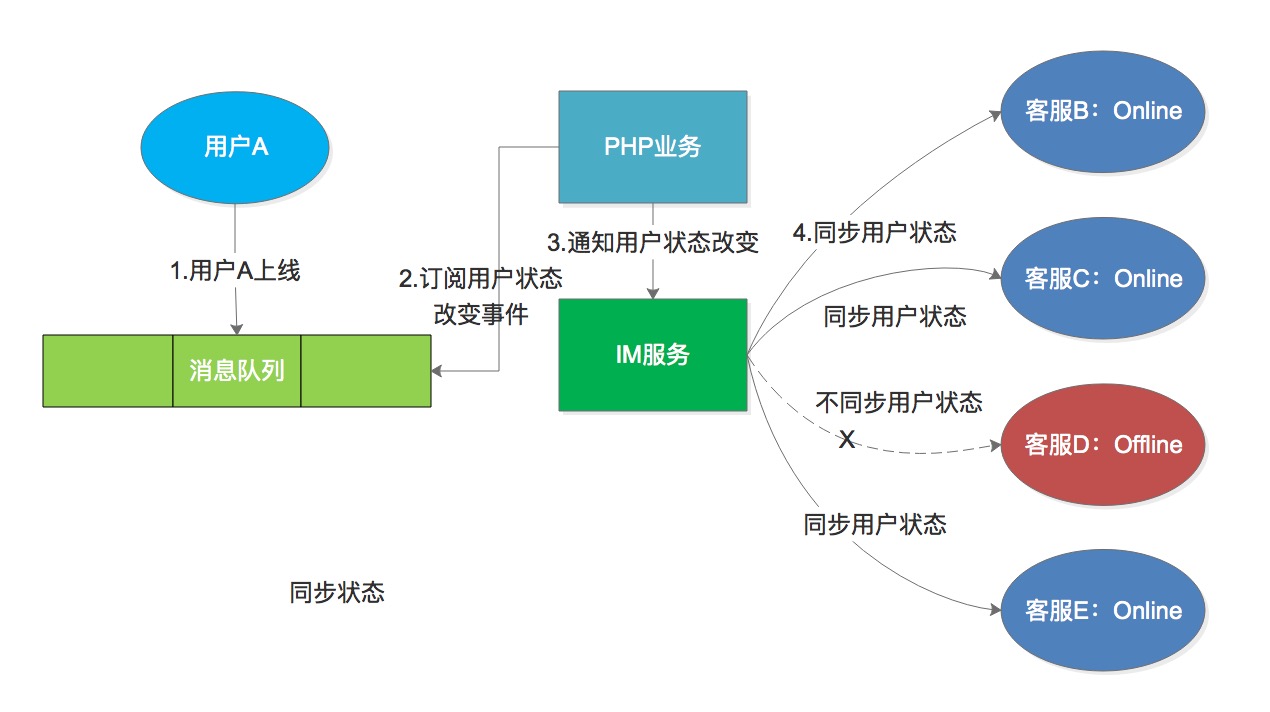

<p><strong>架构分层:</strong></p>

<ul>

<li>

<strong>展示层</strong>:提供 HTTP 和 WebSocket 两种接入方式。</li>

<li>

<strong>业务层</strong>:负责初始化消息线和业务逻辑处理。如果客户端以 HTTP 方式接入,会以 JSON 格式把消息发送给业务服务器进行消息解码、客服分配、敏感词过滤,然后下发到消息分发模块准备下一步的转换;通过 WebSocket 接入的业务则不需要消息分发,直接以 WebSocket 方式发送至消息处理模块中。</li>

<li>

<strong>服务层</strong>:由消息分发和消息处理这两层组成,分别以分布式的方式部署多个 Dispatcher 和 Worker 节点。Dispatcher 负责检索出接收者所在的服务器位置,将消息以 RPC 的方式发送到合适的 Worker 上,再由消息处理模块通过 WebSocket 把消息推送给客户端。</li>

<li>

<strong>数据层</strong>:Redis 集群,记录用户身份、连接信息、客户端平台(移动端、网页端、桌面端)等组成的唯一 Key。</li>

</ul>

<h3>2.4 服务流程</h3>

<h5><strong>步骤一</strong></h5>

<p>如上图右侧所示,用户客户端与消息处理模块建立 WebSocket 长连接。通过负载均衡算法,使客户端连接到合适的服务器(消息处理模块的某个 Worker)。连接成功后,记录用户连接信息,包括用户角色(客人或商家)、客户端平台(移动端、网页端、桌面端)等组成唯一 Key,记录到 Redis 集群。</p>

<h5><strong>步骤二</strong></h5>

<p>如图左侧所示,当购买商品的用户要给管家发消息的时候,先通过 HTTP 请求把消息发给业务服务器,业务服务端对消息进行业务逻辑处理。</p>

<p>(1) 该步骤本身是一个 HTTP 请求,所以可以接入各种不同开发语言的客户端。通过 JSON 格式把消息发送给业务服务器,业务服务器先把消息解码,然后拿到这个用户要发送给哪个商家的客服的。</p>

<p>(2) 如果这个购买者之前没有聊过天,则在业务服务器逻辑里需要有一个分配客服的过程,即建立购买者和商家的客服之间的连接关系。拿到这个客服的 ID,用来做业务消息下发;如果之前已经聊过天,则略过此环节。</p>

<p>(3) 在业务服务器,消息会异步入数据库。保证消息不会丢失。</p>

<h5><strong>步骤三</strong></h5>

<p>业务服务端以 HTTP 请求把消息发送到消息分发模块。这里分发模块的作用是进行中转,最终使服务端的消息下发给指定的商家。</p>

<h5><strong>步骤四</strong></h5>

<p>基于 Redis 集群中的用户连接信息,消息分发模块将消息转发到目标用户连接的 WebSocket 服务器(消息处理模块中的某一个 Worker)</p>

<p>(1) 分发模块通过 RPC 方式把消息转发到目标用户连接的 Worker,RPC 的方式性能更快,而且传输的数据也少,从而节约了服务器的成本。</p>

<p>(2) 消息透传 Worker 的时候,多种策略保障消息一定会下发到 Worker。</p>

<h5><strong>步骤五</strong></h5>

<p>消息处理模块将消息通过 WebSocket 协议推送到客户端:</p>

<p>(1) 在投递的时候,接收者要有一个 ACK(应答) 信息来回馈给 Worker 服务器,告诉 Worker 服务器,下发的消息接收者已经收到了。</p>

<p>(2) 如果接收者没有发送这个 ACK 来告诉 Worker 服务器,Worker 服务器会在一定的时间内来重新把这个信息发送给消息接收者。</p>

<p>(3) 如果投递的信息已经发送给客户端,客户端也收到了,但是因为网络抖动,没有把 ACK 信息发送给服务器,那服务器会重复投递给客户端,这时候客户端就通过投递过来的消息 ID 来去重展示。</p>

<p>以上步骤的数据流转大致如图所示:</p>

<p><img src="/img/bVbBwvb" alt="流程" title="流程"></p>

<h3>2.5 系统完整性设计</h3>

<h4><strong>2.5.1 可靠性</strong></h4>

<h5><strong>(1)消息不丢失</strong></h5>

<p>为了避免消息丢失,我们设置了超时重传机制。服务端会在推送给客户端消息后,等待客户端的 ACK,如果客户端没有返回 ACK,服务端会尝试多次推送。</p>

<p>目前默认 18s 为超时时间,重传 3 次不成功,断开连接,重新连接服务器。重新连接后,采用拉取历史消息的机制来保证消息完整。</p>

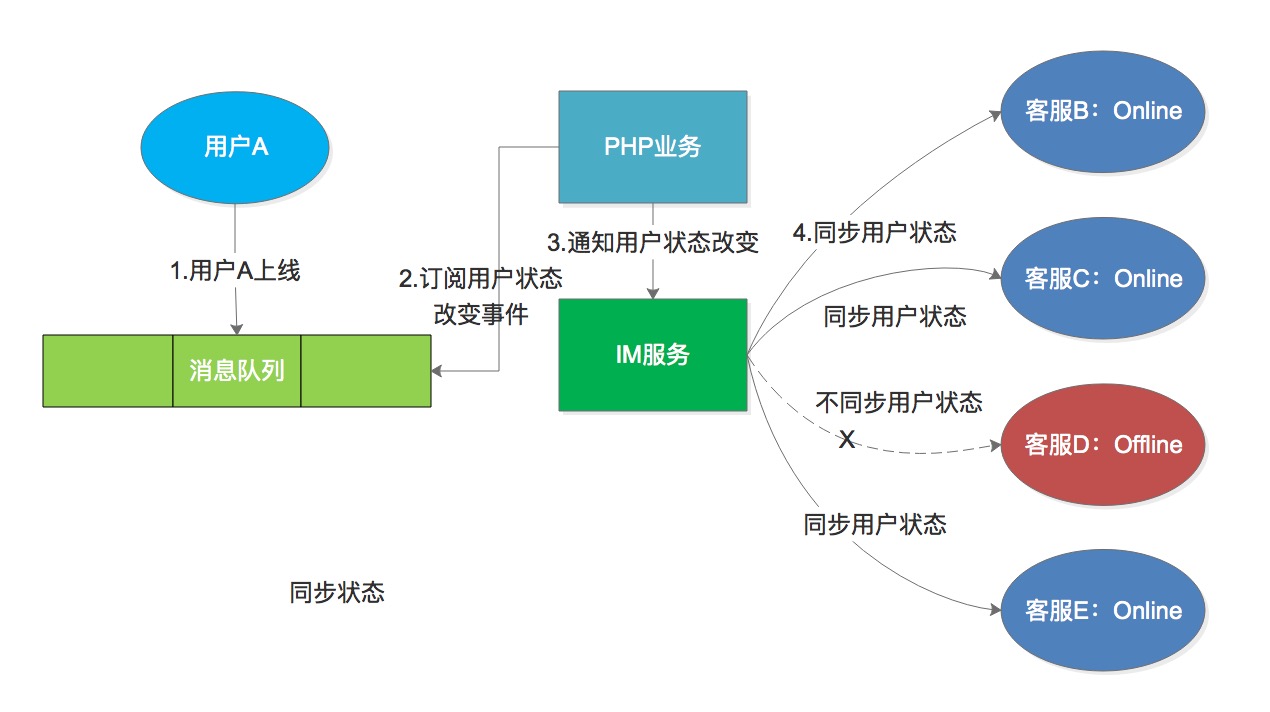

<h5><strong>(2)多端消息同步</strong></h5>

<p>客户端现有 PC 浏览器、Windows 客户端、H5、iOS/Android,系统允许用户多端同时在线,且同一端可以多个状态,这就需要保证多端、多用户、多状态的消息是同步的。</p>

<p>我们用到了 Redis 的 Hash 存储,将用户信息、唯一连接对应值 、连接标识、客户端 IP、服务器标识、角色、渠道等记录下来,这样通过 key(uid) 就能找到一个用户在多个端的连接,通过 key+field 能定位到一条连接。</p>

<h4><strong>2.5.2 可用性</strong></h4>

<p>上文我们已经说过,因为是双层设计,就涉及到两个 Server 间的通信,同进程内通信用 Channel,非同进程用消息队列或者 RPC。综合性能和对服务器资源利用,我们最终选择 RPC 的方式进行 Server 间通信。在对基于 Go 的 RPC 进行选行时,我们比较了以下比较主流的技术方案:</p>

<ul>

<li>Go STDRPC:Go 标准库的 RPC,性能最优,但是没有治理</li>

<li>RPCX:性能优势 2*GRPC + 服务治理</li>

<li>GRPC:跨语言,但性能没有 RPCX 好</li>

<li>TarsGo:跨语言,性能 5*GRPC,缺点是框架较大,整合起来费劲</li>

<li>Dubbo-Go:性能稍逊一筹, 比较适合 Go 和 Java 间通信场景使用</li>

</ul>

<p>最后我们选择了 RPCX,因为性能也很好,也有服务的治理。</p>

<p>两个进程之间同样需要通信,这里用到的是 ETCD 实现服务注册发现机制。</p>

<p>当我们新增一个 Worker,如果没有注册中心,就要用到配置文件来管理这些配置信息,这挺麻烦的。而且你新增一个后,需要分发模块立刻发现,不能有延迟。</p>

<p>如果有新的服务,分发模块希望能快速感知到新的服务。利用 Key 的续租机制,如果在一定时间内,没有监听到 Key 有续租动作,则认为这个服务已经挂掉,就会把该服务摘除。</p>

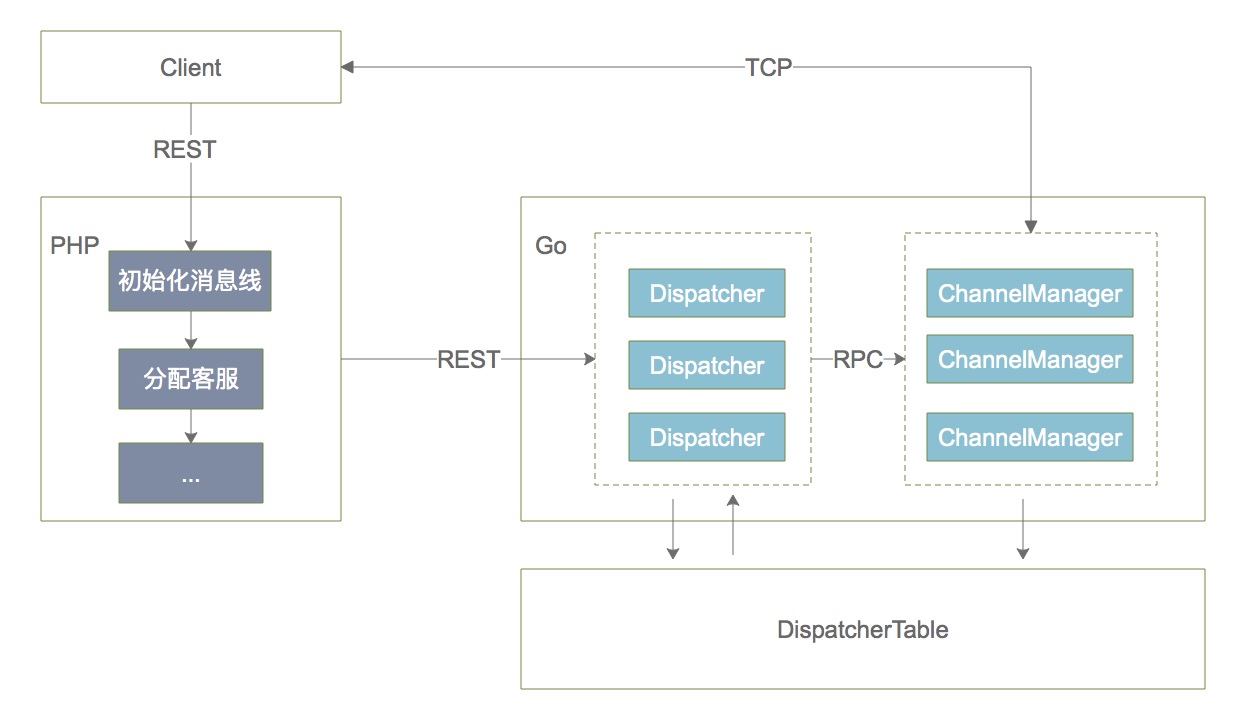

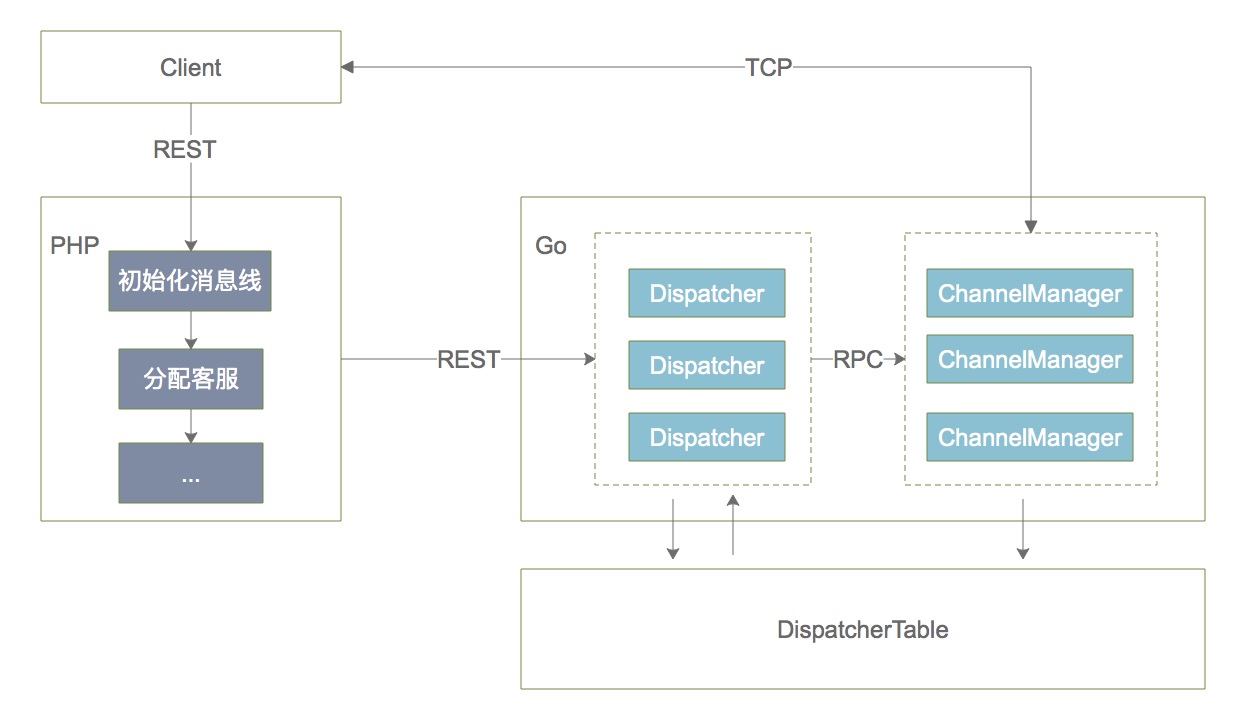

<p>在进行注册中心的选型时,我们主要调研了 ETCD,ZK,Consul,三者的压测结果参考如下:</p>

<p><img src="/img/bVbBwvh" alt="etcd" title="etcd"></p>

<p><img src="/img/bVbBwvn" alt="etcd" title="etcd"></p>

<p>结果显示,ETCD 的性能是最好的。另外,ETCD 背靠阿里巴巴,而且属于 Go 生态,我们公司内部的 K8S 集群也在使用。</p>

<p>综合考量后,我们选择使用 ETCD 作为服务注册和发现组件。并且我们使用的是 ETCD 的集群模式,如果一台服务器出现故障,集群其他的服务器仍能正常提供服务。</p>

<p>通过保证服务和进程间的正常通讯,及 ETCD 集群模式的设计,保证了 IM 服务整体具有极高的可用性。</p>

<h4><strong>2.5.3 扩展性</strong></h4>

<p>消息分发模块和消息处理模块都能进行水平扩展。当整体服务负载高时,可以通过增加节点来分担压力,保证消息即时性和服务稳定性。</p>

<h4><strong>2.5.4 安全性</strong></h4>

<p>处于安全性考虑,我们设置了黑名单机制,可以对单一 uid 或者 ip 进行限制。比如在同一个 uid 下,如果一段时间内建立的连接次数超过设定的阈值,则认为这个 uid 可能存在风险,暂停服务。如果暂停服务期间该 uid 继续发送请求,则限制服务的时间相应延长。</p>

<h3>2.6 性能优化和踩过的坑</h3>

<h4><strong>2.6.1 性能优化</strong></h4>

<h5><strong>(1) JSON 编解码</strong></h5>

<p>开始我们使用官方的 JSON 编解码工具,但由于对性能方面的追求,改为使用滴滴开源的 Json-iterator,使在兼容原生 Golang 的 JSON 编解码工具的同时,效率上有比较明显的提升。以下是压测对比的参考图:</p>

<p><img src="/img/bVbBwvp" alt="DD.png" title="DD.png"></p>

<h5><strong>(2) time.After</strong></h5>

<p>在压测的时候,我们发现内存占用很高,于是使用 Go Tool PProf 分析 Golang 函数内存申请情况,发现有不断创建 time.After 定时器的问题,定位到是心跳协程里面。</p>

<p>原来代码如下:</p>

<p><img src="/img/bVbBwvE" alt="代码0.png" title="代码0.png"></p>

<p>优化后的代码为:</p>

<p><img src="/img/bVbBwvH" alt="代码1.png" title="代码1.png"></p>

<p>优化点在于 for 循环里不要使用 select + time.After 的组合。</p>

<h5><strong>(3) Map 的使用</strong></h5>

<p>在保存连接信息的时候会用到 Map。因为之前做 TCP Socket 的项目的时候就遇到过一个坑,即 Map 在协程下是不安全的。当多个协程同时对一个 Map 进行读写时,会抛出致命错误:fetal error:concurrent map read and map write,有了这个经验后,我们这里用的是 sync.Map</p>

<h4>2.6.2 踩坑经验</h4>

<h5><strong>(1) 协程异常</strong></h5>

<p>基于对开发成本和服务稳定性等问题的考虑,我们的 WebSocket 服务基于 Gorilla/WebSocket 框架开发。其中遇到一个问题,就是当读协程发生异常退出时,写协程并没有感知到,结果就是导致读协程已经退出但是写协程还在运行,直到触发异常之后才退出。这样虽然从表面上看不影响业务逻辑,但是浪费后端资源。在编码时应该注意要在读协程退出后主动通知写协程,这样一个小的优化可以这在高并发下能节省很多资源。</p>

<h5><strong>(2) 心跳设计</strong></h5>

<p>举个例子,之前我们在闲时心跳功能的开发中走了一些弯路。最初在服务器端的心跳发送是定时心跳,但后来在实际业务场景中使用时发现,设计成服务器读空闲时心跳更好。因为用户都在聊天呢,发一个心跳帧,浪费感情也浪费带宽资源。</p>

<p>这时候,建议大家在业务开发过程中如果代码写不下去就暂时不要写了,先结合业务需求用文字梳理下逻辑,可能会发现之后再进行会更顺利。</p>

<h5><strong>(3) 每天分割日志</strong></h5>

<p><img src="/img/bVbBwvL" alt="日志.png" title="日志.png"></p>

<p>日志模块在起初调研的时候基于性能考虑,确定使用 Uber 开源的 ZAP 库,而且满足业务日志记录的要求。日志库选型很重要,选不好也是影响系统性能和稳定性的。ZAP 的优点包括:</p>

<ul>

<li>显示代码行号这个需求,ZAP 支持而 Logrus 不支持,这个属于提效的。行号展示对于定位问题很重要。</li>

<li>ZAP 相对于 Logrus 更为高效,体现在写 JSON 格式日志时,没有使用反射,而是用内建的 json encoder,通过明确的类型调用,直接拼接字符串,最小化性能开销。</li>

</ul>

<p><strong>小坑:</strong></p>

<p>每天写一个日志文件的功能,目前 ZAP 不支持,需要自己写代码支持,或者请求系统部支持。</p>

<h2>Part.3 性能表现</h2>

<h5><strong>压测 1:</strong></h5>

<p>上线生产环境并和业务方对接以及压测,目前定制业务已接通整个流程,写了一个 Client。模拟定期发心跳帧,然后利用 Docker 环境。开启了 50 个容器,每个容器模拟并发起 2 万个连接。这样就是百万连接打到单机的 Server 上。单机内存占用 30G 左右。</p>

<h5><strong>压测 2:</strong></h5>

<p>同时并发 3000、4000、5000 连接,以及调整发送频率,分别对应上行:60万、80 万、100 万、200 万, 一个 6k 左右的日志结构体。</p>

<p>其中有一半是心跳包 另一半是日志结构体。在不同的压力下的下行延迟数据如下:</p>

<p><img src="/img/bVbBwvW" alt="WX20191216-105353.png" title="WX20191216-105353.png"></p>

<p><strong>结论:</strong>随着上行的并发变大,延迟控制在 24-66 毫秒之间。所以对于下行业务属于轻微延迟。另外针对 60 万 5k 上行的同时,用另一个脚本模拟开启 50 个协程并发下行 1k 的数据体,延迟是比没有并发下行的时候是有所提高的,延迟提高了 40ms 左右。</p>

<h2>Part.4 总结</h2>

<p>基于 Go 重构的 IM 服务在 WebSocket 的基础上,将业务层设计为配有消息分发模块和消息处理模块的双层架构模式,使业务逻辑的处理前置,保证了即时通讯服务的纯粹性和稳定性;同时消息分发模块的 HTTP 服务方便多种编程语言快速对接,使各业务线能迅速接入即时通讯服务。</p>

<p>最后,我还想为 Go 摇旗呐喊一下。很多人都知道马蜂窝技术体系主要是基于 PHP,有一些核心业务也在向 Java 迁移。与此同时,Go 也在越来越多的项目中发挥作用。现在,云原生理念已经逐渐成为主流趋势之一,我们可以看到在很多构建云原生应用所需要的核心项目中,Go 都是主要的开发语言,比如 Kubernetes,Docker,Istio,ETCD,Prometheus 等,包括第三代开源分布式数据库 TiDB。</p>

<p>所以我们可以把 Go 称为云原生时代的母语。「云原生时代,是开发者最好的时代」,在这股浪潮下,我们越早走进 Go,就可能越早在这个新时代抢占关键赛道。希望更多小伙伴和我们一起,加入到 Go 的开发和学习阵营中来,拓宽自己的技能图谱,拥抱云原生。</p>

<p><strong>本文作者:Anti Walker,马蜂窝旅游网电商交易基础平台研发工程师。</strong></p>

<p><img src="/img/bVbpQy1" alt="WechatIMG171.png" title="WechatIMG171.png"></p>

马蜂窝推荐排序算法模型是如何实现快速迭代的

https://segmentfault.com/a/1190000020966725

2019-11-11T14:39:47+08:00

2019-11-11T14:39:47+08:00

马蜂窝技术

https://segmentfault.com/u/mafengwojishu

3

<p>(马蜂窝技术原创文章,微信ID:mfwtech)</p>

<h3>Part.1马蜂窝推荐系统架构</h3>

<p>马蜂窝推荐系统主要由召回(Match)、排序(Rank)、重排序(Rerank)几个部分组成,整体架构图如下:</p>

<p><img src="/img/remote/1460000020966728" alt="" title=""></p>

<p>在召回阶段,系统会从海量的内容库筛选出符合用户偏好的候选集(百级、千级);排序阶段在此基础上,基于特定的优化目标(如点击率)对候选集内容进行更加精准的计算和选择,为每一条内容进行精确打分,进而从候选集的成百上千条内容中选出用户最感兴趣的少量高质量内容。</p>

<p>本文我们将重点介绍马蜂窝推荐系统中的核心之一——排序算法平台,它的整体架构如何;为了给用户呈现更加精准的推荐结果,在支撑模型快速、高效迭代的过程中,排序算法平台发挥了哪些作用及经历的实践。</p>

<h2>Part.2 排序算法平台的演进</h2>

<h3>2.1 整体架构</h3>

<p>目前,马蜂窝排序算法线上模型排序平台主要由<strong>通用数据处理模块、可替换模型生产模块、监控与分析模块</strong>三部分组成,各模块结构及平台整体工作流程如下图所示:<img src="/img/remote/1460000020966729" alt="" title=""></p>

<h4><strong>2.1.1 模块<strong><em><em>功能</em></em></strong></strong></h4>

<p><strong>(1) 通用数据处理模块</strong></p>

<p>核心功能是特征建设以及训练样本的构建,也是整个排序算法最为基础和关键的部分。数据源涉及点击曝光日志、用户画像、内容画像等等,底层的数据处理依赖 Spark 离线批处理和 Flink 实时流处理。</p>

<p><strong>(2) 可替换模型生产模块</strong></p>

<p>主要负责训练集的构建、模型的训练以及生成线上配置,实现模型的无缝同步上线。</p>

<p><strong>(3) 监控与分析模块</strong></p>

<p>主要包括上游依赖数据的监控、推荐池的监控,特征的监控与分析,模型的可视化分析等功能。</p>

<p>各个模块的功能以及他们之间的交互使用 JSON 配置文件进行集成,使模型的训练和上线仅仅需要修改配置就能完成,极大提升了开发效率,为排序算法的快速迭代打下了坚实的基础。</p>

<h4><strong>2.1.2 主要配置文件类型</strong></h4>

<p>配置文件主要分为 TrainConfig、MergeConfig、OnlineConfig、CtrConfig 四类,其作用分别为:</p>

<p><strong>(1)TrainConfig</strong></p>

<p>指训练配置,主要包括训练集配置和模型配置:</p>

<ul>

<li>训练集配置包括指定使用哪些特征进行训练;指定使用哪些时间段内的训练数据;指定场景、页面、和频道等</li>

<li>模型配置包括模型参数、训练集路径、测试集路径、模型保存路径等</li>

</ul>

<p><strong>(2)MergeConfig</strong></p>

<p>指特征配置,包括上下文特征、用户特征、物品特征、交叉特征的选择。</p>

<p>这里,我们将交叉特征的计算方式也实现了配置化。例如用户特征中有一些向量特征,内容特征也有一些向量特征。当我们希望使用某两个向量的余弦相似度或者欧式距离作为一个交叉特征给模型使用时,这种交叉特征的选择和计算方式可以直接通过配置实现,并且同步的线上配置中供线上使用。</p>

<p><strong>(3)OnlineConfig</strong></p>

<p>指线上配置,训练数据构建的过程中自动生成供线上使用,包括特征的配置(上下文特征、用户特征、内容特征、交叉特征)、模型的路径、特征的版本。</p>

<p><strong>(4)CtrConfig</strong></p>

<p>指默认 CTR 配置,作用为针对用户和内容的 CTR 特征进行平滑处理。</p>

<p><strong>2.1.3 特征工程</strong></p>

<p>从应用的视角来看,特征主要包括三类,用户特征(User Feature)、内容特征(Article Feature)、上下文特征(Context Feature)。</p>

<p>如果按获取的方式又可以分为:</p>

<ul>

<li>统计特征(Statistics Feature):包括用户、内容、特定时间段内的点击量/曝光量/CTR 等</li>

<li>向量特征(Embedding Feature):以标签、目的地等信息为基础,利用用户点击行为历史,使用 Word2Vec 训练的向量特征等;</li>

<li>交叉特征(Cross Feature):基于标签或目的地向量,构建用户向量或物品向量,从而得到用户与物品的相似度特征等</li>

</ul>

<h3>2.2 排序算法平台 V1</h3>

<p>在排序算法平台 V1 阶段,通过简单的 JSON 文件配置,平台就能够实现特征的选择、训练集的选择、分场景 XGBoost 模型的训练、XGBoost 模型离线 AUC 的评估、生成线上配置文件自动同步上线等功能。</p>

<p><img src="/img/remote/1460000020966730" alt="" title=""></p>

<h3>2.3 排序算法平台 V2</h3>

<p>针对上面存在的这些问题,我们在排序算法平台的监控分析模块增加了<strong>数据验证、模型解释</strong>的功能,帮助我们对模型的持续迭代优化提供更加科学、精准的依据。</p>

<p><img src="/img/remote/1460000020966731" alt="" title=""></p>

<h4><strong>2.3.1 数据验证(DataVerification)</strong></h4>

<p>在算法平台 V1 阶段,当模型离线效果(AUC)表现很好,而线上效果不符合预期时,我们很难排查定位问题,影响模型迭代。</p>

<p>通过对问题的调查和分析我们发现,造成线上效果不符合预期的一个很重要的原因,可能是目前模型的训练集是基于数仓每天汇总的一张点击曝光表得到。由于数据上报延迟等原因,这张离线的点击曝光表中的一些上下文特征与实时的点击曝光行为可能存在误差,带来一些离线和线上特征不一致的问题。</p>

<p>针对这种情况,我们增加了数据验证的功能,将离线构建的训练集与线上打印的实时特征日志进行各个维度的对比分析。</p>

<p>具体做法就是以线上的实时点击曝光日志(包含所使用的模型、特征以及模型预测分等信息)为基础,为每条实时点击曝光记录都增加一个唯一 ID,在离线汇总的点击曝光表中也会保留这个唯一 ID。这样,针对一条点击曝光记录,我们就可以将离线构建的训练集中的特征,与线上实际使用的特征关联起来,对线上和离线模型的 AUC、线上和离线模型的预测分以及特征的情况进行对比,从而发现一些问题。</p>

<p>举例来说,在之前的模型迭代过程中,模型离线 AUC 很高,但是线上效果却并不理想。通过数据验证,我们首先对比了线上和离线模型 AUC 的情况,发现存在效果不一致的现象,接着对比线上和离线模型的预测分,并找到线上和离线预测分相差最大的 TopK 个样本,对它们的离线特征和线上特征进行对比分析。最后发现是由于数据上报延迟造成了一些线上和离线上下文特征的不一致,以及线上XGBoost、DMatrix 构建时选的 missingValue 参数有问题,从而导致了线上和离线模型预测分存在偏差。上述问题修复后,线上 UV 点击率提升了 16.79%,PV 点击率提升了 19.10%。</p>

<p>通过数据验证的功能和解决策略,我们快速定位到了问题的原因,加速算法模型迭代开发的过程,提升了线上的应用效果。</p>

<h4><strong>2.3.2 模型解释(ModelExplain)</strong></h4>

<p>模型解释可以打开机器学习模型的黑盒,增加我们对模型决策的信任,帮助理解模型决策,为改进模型提供启发。关于模型解释的一些概念,推荐给大家两篇文章来帮助理解:《Why Should I Trust You Explaining the Predictions of Any Classifier》、《A Unified Approach to Interpreting Model Predictions》。</p>

<p>在实际开发中,我们总是在模型的准确性与模型的可解释性之间权衡。简单的模型拥有很好的解释性,但是准确性不高;而复杂的模型提高模型准确性的同时又牺牲了模型的可解释性。使用简单的模型解释复杂的模型是当前模型解释的核心方法之一。</p>

<p>目前,我们线上模型排序使用的是 XGBoost 模型。但在 XGBoost 模型中,传统的基于特征重要性的模型解释方法,只能从整体上对每个特征给出一个重要性的衡量,不支持对模型的局部输出解释,或者说单样本模型输出解释。在这样的背景下,我们的模型解释模块使用了新的模型解释方法 Shap 和 Lime,不仅支持特征的重要性,也支持模型的局部解释,使我们可以了解到在单个样本中,某个特征的某个取值对模型的输出可以起到何种程度的正向或负向作用。</p>

<p>下面通过一个从实际场景中简化的示例来介绍模型解释的核心功能。首先介绍一下几个特征的含义:</p>

<p><img src="/img/remote/1460000020966732" alt="" title=""></p>

<p><img src="/img/remote/1460000020966733" alt="" title=""></p>

<p>我们的模型解释会对单个样本给出以下的分析:</p>

<ul><li><em>U0_-_I1</em></li></ul>

<p><img src="/img/remote/1460000020966734" alt="" title=""></p>

<ul><li><em>U0_-_I2</em></li></ul>

<p><img src="/img/remote/1460000020966735" alt="" title=""></p>

<ul><li><em>U0_-_I3</em></li></ul>

<p><img src="/img/remote/1460000020966736" alt="" title=""></p>

<p>如图所示,模型对单个样本 <em>U0_-_I2_,_U0_-_I3_的预测值为 0.094930, 0.073473, 0.066176。针对单个样本的预测,各个特征值起到多大的正负向作用可以从图中的特征条形带的长度看出,红色代表正向作用,蓝色代表负向作用。这个值是由下表中的 shap_value 值决定的:</em></p>

<p><img src="/img/remote/1460000020966738" alt="" title=""></p>

<p><img src="/img/remote/1460000020966739" alt="" title=""></p>

<p>其中,<code>logit_output_value = 1.0 / (1 + np.exp(-margin_output_value)),logit_base_value = 1.0 / (1 + np.exp(-margin_base_value))</code>,output_value 是 XGBoost 模型输出值;base_value 是模型期望输出;近似等于整个训练集中模型预测值的均值;shap_value 是对该特征对预测结果起到的正负向作用的一个衡量。</p>

<p>模型预测值logit_output_value,0.094930>0.073473>0.066176,所以排序结果为 <em>I1</em>> <em>I2_>_I3_,_U0_-_I1</em> 的预测值为0.094930,特征 doubleFlow_article_ctr_7_v1=_I1_ctr起到了 0.062029 的正向作用,使得预测值相较于基值,有增加的趋势。同理,ui_cosine_70=0.894006,起到了 0.188769 的正向作用。</p>

<p>直观上我们可以看出,内容 7 天点击率以及用户-内容相似度越高,模型预测值越高,这也是符合预期的。实际场景中,我们会有更多的特征。</p>

<p>Shap 模型解释最核心的功能是支持局部单样本分析,当然它也支持全局的分析,如特征重要性,特征正负向作用,特征交互等。下图是对特征 doubleFlow_article_ctr_7_v1 的分析,可以看出,内容 7 天点击率小于阈值对模型的预测起负向作用,大于阈值对模型的预测起正向作用。</p>

<p><img src="/img/remote/1460000020966740" alt="" title=""></p>

<h2>Part.3 近期规划</h2>

<p>近期,排序算法平台将继续提升训练模型的线上应用效果,并把特征的实时作为工作重点,快速反映线上的变化。</p>

<p>当前排序算法平台使用的 XGBoost 模型优点是不需要太多的特征工程,包括特征缺失值处理、连续特征离散化、交叉特征构建等。但也存在许多不足,包括:</p>

<ol>

<li>很难处理高纬稀疏特征</li>

<li>需要加载完整的数据集到内存进行模型的训练,不支持在线学习算法,很难实现模型的实时更新。</li>

</ol>

<p>针对这些问题,后期我们将进行 Wide&Deep,DeepFM 等深度模型的建设,如下图所示:</p>

<p><img src="/img/remote/1460000020966741" alt="" title=""></p>

<p>另外,当前的模型每次都是预测单个 Item 的分数,然后进行排序取一刷的结果,(Learning to rank,pointwise)。后期我们希望可以实现一次给用户推荐一刷的结果(Learning to rank,listwise),给用户带来更加实时、准确的推荐结果。</p>

<p><strong>本文作者:夏鼎新、王磊,马蜂窝推荐算法平台研发工程师。</strong></p>

<p><img src="/img/remote/1460000020966742" alt="" title=""></p>

马蜂窝 IM 移动端架构的从 0 到 1

https://segmentfault.com/a/1190000020761250

2019-10-22T10:44:23+08:00

2019-10-22T10:44:23+08:00

马蜂窝技术

https://segmentfault.com/u/mafengwojishu

31

<p><em>(马蜂窝技术原创内容,公众号 ID:mfwtech)</em></p>

<p>移动互联网技术改变了旅游的世界,这个领域过去沉重的信息分销成本被大大降低。用户与服务供应商之间、用户与用户之间的沟通路径逐渐打通,沟通的场景也在不断扩展。这促使所有的移动应用开发者都要从用户视角出发,更好地满足用户需求。</p>

<p>论坛时代的马蜂窝,用户之间的沟通形式比较单一,主要为单纯的回帖回复等。为了以较小的成本快速满足用户需求,当时采用的是非实时性消息的方案来实现用户之间的消息传递。</p>

<p>随着行业和公司的发展,马蜂窝确立了「内容+交易」的独特商业模式。在用户规模不断增长及业务形态发生变化的背景下,为用户和商家提供稳定可靠的售前和售后技术支持,成为电商移动业务线的当务之急。</p>

<h2>一、设计思路与整体架构</h2>

<p>我们结合 B2C,C2B,C2C 不同的业务场景设计实现了马蜂窝旅游移动端中的私信、用户咨询、用户反馈等即时通讯业务;同时为了更好地为合作商家赋能,在马蜂窝商家移动端中加入与会话相关的咨询用户管理、客服管理、运营资源统计等功能。</p>

<p>目前 IM 涉及到的业务如下:</p>

<p><img src="/img/remote/1460000020761253" alt="" title=""></p>

<p>为了实现马蜂窝旅游 App 及商家 IM 业务逻辑、公共资源的整合复用及 UI 个性化定制,将问题拆解为以下部分来解决:</p>

<ol>

<li>IM 数据通道与异常重连机制,解决不同业务实时消息下发以及稳定性保障;</li>

<li>IM 实时消息订阅分发机制,解决消息定向发送、业务订阅消费,避免不必要的请求资源浪费;</li>

<li>IM 会话列表 UI 绘制通用解决方案,解决不同消息类型的快速迭代开发和管理复杂问题;</li>

</ol>

<p>整体实现结构分为 4 个部分进行封装,分别为下图中的数据管理、消息注册分发管理、通用 UI 封装及业务管理。</p>

<p><img src="/img/remote/1460000020761254" alt="" title=""></p>

<h2>二、技术原理和实现过程</h2>

<h3>2.1 通用数据通道</h3>

<p>对于常规业务展示数据的获取,客户端需要主动发起请求,请求和响应的过程是单向的,且对实时性要求不高。但对于 IM 消息来说,需要同时支持接收和发送操作,且对实时性要求高。为支撑这种要求,客户端和服务器之间需要创建一条稳定连接的数据通道,提供客户端和服务端之间的双向数据通信。</p>

<h4><strong>2.1.1 数据通道基础交互原理</strong></h4>

<p>为了更好地提高数据通道对业务支撑的扩展性,我们将所有通信数据封装为外层结构相同的数据包,使多业务类型数据使用共同的数据通道下发通信,统一分发处理,从而减少通道的创建数量,降低数据通道的维护成本。</p>

<p><img src="/img/remote/1460000020761255" alt="" title=""></p>

<p>常见的客户端与服务端数据交互依赖于 HTTP 请求响应过程,只有客户端主动发起请求才可以得到响应结果。结合马蜂窝的具体业务场景,我们希望建立一种可靠的消息通道来保障服务端主动通知客户端,实现业务数据的传递。目前采用的是 HTTP 长链接轮询的形式实现,各业务数据消息类型只需遵循约定的通用数据结构,即可实现通过数据通道下发给客户端。数据通道不必关心数据的具体内容,只需要关注接收与发送。</p>

<h4><strong>2.1.2 客户端数据通道实现原理</strong></h4>

<p>客户端数据通道管理的核心是维护一个业务场景请求栈,在不同业务场景切换过程中入栈不同的业务场景参数数据。每次 HTTP 长链接请求使用栈顶请求数据,可以模拟在特定业务场景 (如与不同的用户私信) 的不同处理。数据相关处理都集中封装在数据通道管理中,业务层只需在数据通道管理中注册对应的接收处理即可得到需要的业务消息数据。</p>

<p><img src="/img/remote/1460000020761257" alt="" title=""></p>

<h3>2.2 消息订阅与分发</h3>

<p>在软件系统中,订阅分发本质上是一种消息模式。非直接传递消息的一方被称为「发布者」,接受消息处理称为「订阅者」。发布者将不同的消息进行分类后分发给对应类型的订阅者,完成消息的传递。应用订阅分发机制的优势为便于统一管理,可以添加不同的拦截器来处理消息解析、消息过滤、异常处理机制及数据采集工作。</p>

<h4><strong>2.2.1 消息订阅</strong></h4>

<p>业务层只专注于消息处理,并不关心消息接收分发的过程。订阅的意义在于更好地将业务处理和数据通道处理解耦,业务层只需要订阅关注的消息类型,被动等待接收消息即可。</p>

<p><img src="/img/remote/1460000020761258" alt="" title=""></p>

<p>业务层订阅需要处理的业务消息类型,在注册后会自动监控当前页面的生命周期,并在页面销毁后删除对应的消息订阅,从而避免手动编写成对的订阅和取消订阅,降低业务层的耦合,简化调用逻辑。订阅分发管理会根据各业务类型维护订阅者队列用于消息接收的分发操作。</p>

<h4><strong>2.2.2 消息分发</strong></h4>

<p>数据通道的核心在于维护多消息类型各自对应的订阅者集合,并将解析的消息分发到业务层。</p>

<p><img src="/img/remote/1460000020761259" alt="" title=""></p>

<p>数据通道由多业务消息共用,在每次请求收到新消息列表后,根据各自业务类型重新拆分成多个消息列表,分发给各业务类型对应的订阅处理器,最终传递至业务层交予对应页面处理展示。</p>

<h3>2.3 会话消息列表绘制</h3>

<p>基于不同的场景,如社交为主的私信、用户服务为主的咨询反馈等,都需要会话列表的展示形式;但各场景又不完全相同,需要分析当前会话列表的共通性及可封装复用的部分,以更好地支撑后续业务的扩展。</p>

<h4><strong>2.3.1 消息在列表展示的组成结构</strong></h4>

<p>IM 消息列表的特点在于消息类型多、UI 展示多样化,因此需要建立各类型消息和布局的对应关系,在收到消息后根据消息类型匹配到对应的布局添加至对应消息列表。</p>

<p><img src="/img/remote/1460000020761260" alt="" title=""></p>

<h4><strong>2.3.2 消息类型与展示布局管理原理</strong></h4>

<p>对于不同消息类型及展示,问题的核心在于建立<strong>消息类型、消息数据结构、消息展示布局管理</strong>的映射关系。以上三者在实现过程中通过建立映射管理表来维护,各自建立列表存储消息类型/消息体封装结构/消息展示布局管理,设置对应关系关联 3 个列表来完成查找。 </p>

<p><img src="/img/remote/1460000020761261" alt="" title=""></p>

<h4><strong>2.3.3 一次收发消息 UI 绘制过程</strong></h4>

<p>各类型消息在内容展示上各有不同,但整体会话消息展示样式可以分为 3 种,分别是<strong>接收消息、发送消息和处于页面中间的消息样式,</strong>区别只在于内部的消息样式。所以消息 UI 的绘制可以拆分成 2 个步骤,首先是创建通用的展示容器,然后再填充各消息具体的展示样式。</p>

<p><img src="/img/remote/1460000020761262" alt="" title=""></p>

<p>拆分的目的在于使各类型消息 UI 处理只需要关注特有数据。而如通用消息如头像、名称、消息时间、是否可举报、已读未读状态、发送失败/重试状态等都可以统一处理,降低修改维护的成本,同时使各消息 UI 处理逻辑更少、更清晰,更利于新类型的扩展管理。</p>

<p>收发到消息后,根据消息类型判断是「发送接收类型」还是「居中展示类型」,找到外层的布局样式,再根据具体消息类型找到特有的 UI 样式,拼接在外层布局中,得到完整的消息卡片,然后设置对应的数据渲染到列表中,完成整个消息的绘制。</p>

<h2>三、细节优化 & 踩坑经验</h2>

<p>在实现上述 IM 系统的过程中,我们遇到了很多问题,也做了很多细节优化。在这里总结实现时需要考虑的几点,以供大家借鉴。</p>

<h3>3.1 消息去重</h3>

<p>在前面的架构中,我们使用 msg_id 来标记消息列表中的每一条消息,msg_id 是根据客户端上传的数据,进行存储后生成的。</p>

<p><img src="/img/remote/1460000020761263" alt="" title=""><img src="/img/remote/1460000020761264" alt="" title=""></p>

<p>客户端 A 请求 IM 服务器之后生成 msg_id,再通过请求返回和 Polling 分发到客户端 A 和客户端 B。当流程成立的时候,客户端 A 和客户端 B 通过服务端分发的 msg_id 来进行本地去重。但这种方案存在以下问题:</p>

<p><img src="/img/remote/1460000020761265" alt="" title=""></p>

<p>当客户端 A 因为网络出现问题,无法接受对应发送消息的请求返回的时候,会触发重发机制。此时虽然 IM 服务器已经接受过一次客户端 A 的消息发送请求,但是因为无法确定两个请求是否来自同一条原始消息,只能再次接受,这就导致了重复消息的产生。解决的方法是引入客户端消息标识 id。因为我们已经依附旧有的 msg_id 做了很多工作,不打算让客户端的消息 id 代替 msg_id 的职能,因此重新定义一个 random_id。</p>

<p><img src="/img/remote/1460000020761266" alt="" title=""></p>

<p>random_id = random + time_stamp。random_id 标识了唯一的消息体,由一个随机数和生成消息体的时间戳生成。当触发重试的时候,两次请求的 random_id 会是相同的,服务端可以根据该字段进行消息去重。</p>

<h3>3.2 本地化 Push</h3>

<p>当我们在会话页或列表页的环境下,可以通过界面的变化很直观地观察到收取了新消息并更新未读数。但从会话页或者列表页退出之后,就无法单纯地从界面上获取这些信息,这时需要有其他的机制,让用户获知当前消息的状态。</p>

<p>系统推送与第三方推送是一个可行的选择,但本质上推送也是基于长链接提供的服务。为弥补推送不稳定性与风险,我们采用数据通道+本地通知的形式来完善消息通知机制。通过数据通道下发的消息如需达到推送的提示效果,则携带对应的 Push 展示数据。同时会对当前所处的页面进行判断,避免对当前页面的消息内容进行重复提醒。</p>

<p><img src="/img/remote/1460000020761267" alt="" title=""></p>

<p>通过这种<strong>数据通道+本地通知</strong>展示的机制,可以在应用处于运行状态的时间内提高消息抵达率,减少对于远程推送的依赖,降低推送系统的压力,并提升用户体验。</p>

<h3>3.3 数据通道异常重连机制</h3>

<p>当前数据通道通过 HTTP 长链接轮询 (Polling) 实现。不同业务场景下对 Polling 的影响如下图所示:</p>

<p><img src="/img/remote/1460000020761268" alt="" title=""></p>

<p>由于用户手机所处网络请求状态不一,有时候会遇到网络中断或者服务端异常的情况,从而终止 Polling 的请求。为能够让用户在网络恢复后继续会话业务,需要引入重连机制。</p>

<p>在重试机制 1.0 版本中,对于可能出现较多重试请求的情况,采取的是添加 60s 内连续 5 次报错延迟重试的限制。具体流程如下:</p>

<p><img src="/img/remote/1460000020761269" alt="" title=""></p>

<p>在实践中发现以下问题:</p>

<ul>

<li>当服务端突然异常并持续超过 1 分钟后,客户端启动执行重试机制,并每隔 1 分钟重发一次重连请求。这对服务器而言就相当于遭受一次短暂集中的「攻击」,甚至有可能拖垮服务器。</li>

<li>当客户端断网后立刻进行重试也并不合理,因为用户恢复网络也需要一定时间,这期间的重连请求是无意义的。</li>

</ul>

<p>基于以上问题分析改进,我们设计了第二版重试机制。此次将 5 次以下请求错误的延迟时间修改为 5 - 20 秒随机重试,将客户端重试请求分散在多个时间点避免同时请求形成对服务器对瞬时压力。同时在客户端断网情况下也进行延迟重试。</p>

<p><img src="/img/remote/1460000020761270" alt="" title=""></p>

<p>Polling 机制修改后请求量划分,相对之前请求分布比较均匀,不再出现集中请求的问题。</p>

<p><img src="/img/remote/1460000020761271" alt="" title=""></p>

<h3>3.4 唯一会话标识</h3>

<h4><strong>3.4.1 为何引入消息线 ID</strong></h4>

<p>消息线就是用来表示会话的聊天关系,不同消息线代表不同对象的会话,从 DB 层面来看需要一个张表来存储这种关系 uid + object_id + busi_type = 消息线 ID。</p>

<p><img src="/img/remote/1460000020761272" alt="" title=""></p>

<p>在 IM 初期实现中,我们使用会话配置参数(包含业务来源和会话参数)来标识会话 id,有三个作用:</p>

<ul>

<li>查找商家 id,获取咨询来源,进行管家分配</li>

<li>查找已存在的消息线</li>

<li>判断客户端页面状态,决定要不要下发推送,进行消息提醒</li>

</ul>

<p>这种方式存在两个问题:</p>

<ul>

<li>通过业务来源和会话参数来解析对应的商家 id,两个参数缺失一个都会导致商家 id 解析错误,还要各种查询数据库才能得到商家 id,影响效率;</li>

<li>通过会话类型切换接口标识当前会话类型,切换页面会频繁触发网络请求;如果请求接口发生意外容易引发消息内容错误问题,严重依赖客户端的健壮性</li>

</ul>

<p>用业务来源和会话参数帮助我们进行管家分配是不可避免的,但我们可以通过引入消息线 ID 来绑定消息线的方式,替代业务来源和会话参数查找消息线的作用。另外针对下发推送的问题已通过上方讲述的本地推送通知机制解决。</p>

<h4><strong>3.4.2 何时创建消息线</strong></h4>

<ul>

<li>当进入会话页发消息时,检查 DB 中是否存在对应消息线,不存在则将这条消息 id 当作消息线 id 使用,存在即复用。</li>

<li>当进入会话时,根据用户 id 、业务类型 id 等检查在 DB 中是否已存在对应消息线,不存在则创建消息线,存在即复用。</li>

</ul>

<h4><strong>3.4.3 引入消息线目的</strong></h4>

<ul>

<li>减少服务端查询消息线的成本。</li>

<li>移除旧版状态改变相关的接口请求,间接提高了推送触达率。</li>

<li>降低移动端对于用户消息匹配的复杂度。</li>

</ul>

<h2>四、展望及近期优化</h2>

<h3>4.1 数据通道实现方式升级为 Websocket</h3>

<p>WebSocket 是一种在单个 TCP 连接上进行全双工通信的协议。WebSocket 使得客户端和服务器之间的数据交换变得更加简单,允许服务端主动向客户端推送数据。在 WebSocket API 中,浏览器和服务器只需要完成一次握手,两者之间就直接可以创建持久性的连接,并进行双向数据传输。</p>

<p>与目前的 HTTP 轮询实现机制相比, Websocket 有以下优点:</p>

<ul>

<li>

<strong>较少的控制开销</strong>。在连接创建后,服务器和客户端之间交换数据时,用于协议控制的数据包头部相对较小。在不包含扩展的情况下,对于服务器到客户端的内容,此头部大小只有 2 至 10 字节(和数据包长度有关);对于客户端到服务器的内容,此头部还需要加上额外的 4 字节的掩码。相对于 HTTP 请求每次都要携带完整的头部,开销显著减少。</li>

<li>

<strong>更强的实时性</strong>。由于协议是全双工的,服务器可以随时主动给客户端下发数据。相对于 HTTP 需要等待客户端发起请求服务端才能响应,延迟明显更少;即使是和 Comet 等类似的长轮询比较,其也能在短时间内更多次地传递数据。</li>

<li>

<strong>保持连接状态</strong>。与 HTTP 不同的是,Websocket 需要先创建连接,这就使其成为一种有状态的协议,在之后通信时可以省略部分状态信息。而 HTTP 请求可能需要在每个请求都携带状态信息(如身份认证等)。</li>

<li>

<strong>更好的二进制支持</strong>。Websocket 定义了二进制帧,相对 HTTP,可以更轻松地处理二进制内容。</li>

<li>

<strong>支持扩展</strong>。Websocket 定义了扩展,用户可以扩展协议、实现部分自定义的子协议,如部分浏览器支持压缩等。</li>

<li>

<strong>更好的压缩效果</strong>。相对于 HTTP 压缩,Websocket 在适当的扩展支持下,可以沿用之前内容的上下文,在传递类似的数据时,可以显著地提高压缩率。</li>

</ul>

<p>为了进一步优化我们的数据通道设计,我们探索验证了 Websocket 的可行性,并进行了调研和设计:</p>

<p><img src="/img/remote/1460000020761273" alt="" title=""></p>

<p>近期将对 HTTP 轮询实现方案进行替换,进一步优化数据通道的效率。</p>

<h3>4.2 业务功能的扩展</h3>

<p>计划将 IM 移动端功能模块打造成通用的即时通讯组件,能够更容易地赋予各业务 IM 能力,使各业务快速在自有产品线上添加聊天功能,降低研发 IM 的成本和难度。目前的 IM 功能实现主要有两个组成,分别是公用的数据通道与 UI 组件。</p>

<p>随着马蜂窝业务发展,在现有 IM 系统上还有很多可以建设和升级的方向。比如消息类型的支撑上,扩展对短视频、语音消息、快捷消息回复等支撑,提高社交的便捷性和趣味性;对于多人场景希望增加群组,兴趣频道,多人音视频通信等场景的支撑等。</p>

<p>相信未来通过对更多业务功能的扩展及应用场景的探索,马蜂窝移动端 IM 将更好地提升用户体验,并持续为商家赋能。</p>

<p><strong>本文作者:马蜂窝电商业务 IM 移动端研发团队。</strong></p>

<p>(马蜂窝技术原创内容)</p>

<p><img src="/img/remote/1460000020761274" alt="" title=""></p>

马蜂窝数据仓库的架构、模型与应用实践

https://segmentfault.com/a/1190000020613071

2019-10-08T14:48:57+08:00

2019-10-08T14:48:57+08:00

马蜂窝技术

https://segmentfault.com/u/mafengwojishu

3

<p><em>(马蜂窝技术原创内容,公众号ID:mfwtech)</em></p>

<h2>一、马蜂窝数据仓库与数据中台</h2>

<p>最近几年,数据中台概念的热度一直不减。2018 年起,马蜂窝也开始了自己的数据中台探索之路。</p>

<p>数据中台到底是什么?要不要建?和数据仓库有什么本质的区别?相信很多企业都在关注这些问题。</p>

<p>我认为数据中台的概念非常接近传统数据仓库+大数据平台的结合体。它是在企业的数据建设经历了数据中心、数据仓库等积累之后,借助平台化的思路,将数据更好地进行整合与统一,以组件化的方式实现灵活的数据加工与应用,以更清晰的数据职能组织应对业务的快速变化,以服务的方式更好地释放数据价值的一种方式。</p>

<p>所以,数据中台更多的是体现一种管理思路和架构组织上的变革。在这样的思想下,我们结合自身业务特点建设了马蜂窝的数据中台,核心架构如下:</p>

<p><img src="/img/remote/1460000020613074" alt="" title=""></p>

<p>在中台建设之前,马蜂窝已经建立了自己的大数据平台,并积累了一些通用、组件化的工具,这些可以支撑数据中台的快速搭建。作为中台的另一大核心部分,马蜂窝数据仓库主要承担数据统一化建设的工作,包括统一数据模型,统一指标体系等。下面介绍马蜂窝在数据仓库建设方面的具体实践。</p>

<h2>二、数据仓库核心架构</h2>

<p>马蜂窝数据仓库遵循标准的三层架构,对数据分层的定位主要采取维度模型设计,不会对数据进行抽象打散处理,更多注重业务过程数据整合。现有数仓主要以离线为主,整体架构如下:</p>

<p><img src="/img/remote/1460000020613075" alt="" title=""><img src="/img/remote/1460000020613076" alt="" title=""></p>

<p>如图所示,共分为 3 层:<strong>业务数据层、公共数据层与应用数据层</strong>,每层定位、目标以及建设原则各不相同。</p>

<p><strong>(1)业</strong><strong>务数据层</strong>:包含 STG(数据缓冲层)与 ODS(操作数据层)两层,这两层数据结构与业务数据几乎一致。</p>

<ul>

<li>

<strong>STG</strong>:也叫数据准备区,定位是缓存来自 DB 抽取、消息、日志解析落地的临时数据,结构与业务系统保持一致;负责对垃圾数据、不规范数据进行清洗转换;该层只为 ODS 层服务;</li>

<li>

<strong>ODS</strong>:操作数据层定位于业务明细数据保留区,负责保留数据接入时点后历史变更数据,数据原则上全量保留。模型设计依据业务表数据变更特性采取拉链、流水表两种形式。</li>

</ul>

<p><strong>(2)公共数据层</strong>:细分为 DWD(明细数据层)、DWS(汇总数据层)、DIM(公共维度层) 三层,主要用于加工存放整合后的明细业务过程数据,以及经过轻度或重度汇总粒度公共维度指标数据。公共数据层作为仓库核心层,定位于业务视角,提炼出对数据仓库具有共性的数据访问、统计需求,从而构建面向支持应用、提供共享数据访问服务的公共数据。</p>

<ul>

<li>

<strong>DWD</strong>:这一层是整合后的业务过程明细数据,负责各业务场景垂直与水平数据整合、常用公共维度冗余加工,以及明细业务标签信息加工;</li>

<li>

<strong>DWS</strong>:汇总数据层按照主题对共性维度指标数据进行轻度、高度聚合;</li>

<li>

<strong>DIM</strong>:对维度进行统一标准化定义,实现维度信息共享。</li>

</ul>

<p><strong>(3)应用数据层</strong>:DWA 层,主要用于各产品或各业务条线个性化的数据加工,例如商业化产品数据、搜索推荐,风控等。</p>

<h2>三、数据模型设计</h2>

<h3>3.1 方法选择</h3>

<p>数据模型是对现实世界数据特征的抽象,数据模型的设计方法就是对数据进行归纳和概括的方法。目前业界主要的模型设计方法论有两种,一是数据仓库之父 Bill Inmon 提出的<strong>范式建模</strong>方法,又叫 ER 建模,主张站在企业角度自上而下进行数据模型构建;二是 Ralph Kimball 大师倡导的<strong>维度建模</strong>方法,主张从业务需求出发自下而上构建数据模型。</p>

<p>大数据环境下,业务系统数据体系庞杂,数据结构多样、变更频繁,并且需要快速响应各种复杂的业务需求,以上两种传统的理论都已无法满足互联网数仓需求。在此背景下,马蜂窝数据仓库采取了「以需求驱动为主、数据驱动为辅」的混合模型设计方式,来根据不同的数据层次选择模型。主要从以下四个方面综合考虑:</p>

<p><strong>1. 面向主题</strong>:采用范式模型理论中的主题划分方法对业务数据进行分类。</p>

<p><strong>2. 一致性保证:</strong>采用维度模型理论中的总线结构思想,建立统一的一致性维度表和一致性事实表来保证一致性。</p>

<p><strong>3. 数据质量保证</strong>:无论范式建模还是维度建模都非常重视数据质量问题,综合使用两个理论中的方法保证数据质量。</p>

<p><strong>4. 效率保证</strong>:合理采取维度退化、变化维、增加冗余等方法,保证数据的计算和查询效率。</p>

<p><img src="/img/remote/1460000020613077" alt="" title=""><img src="/img/remote/1460000020613078" alt="" title=""></p>

<p>其中,ODS 选择保持贴源的范式模型,不做进一步模型抽象,只是从节省存储角度考虑,对该层采取拉链处理。DWD 与 DWS 基于对构建成本、性能,易用性角度的考虑,主要采取维度模型和一些宽表模型。宽表模型的本质是基于维度模型的扩展,对整个业务以及全节点信息进行垂直与水平方式整合;同时采用退化维度的方式,将不同维度的度量放入数据表的不同列中,实现业务全流程视图的构建,来提升宽表模型的易用性、查询效率,且易于模型的扩展。</p>

<ul>

<li>

<strong>水平整合</strong>:水平整合就是将同一业务多数据源的数据整合到一个模型中,如果多数据源业务数据存在交集,则需要按照预设的业务规则选取一份保留,避免整合后的业务数据交叉。例如商品数据如果未进行主数据管理,不同业务线的商品信息就会散落在各业务系统表中,无法满足企业级的数据分析需求,这时就需要将这些商品数据按照业务主题进行水平整合。</li>

<li>

<strong>垂直整合</strong>:一次完整的业务流转通常要经历多个环节,各节点信息产生的时点不同、储存的数据表不同。垂直整合就是将同一业务中各关键节点信息整合至业务全流程宽表模型中。马蜂窝订单交易模型的构建就采用了这种方式,下文将进行详细介绍。</li>

</ul>

<h3>3.2 设计目标</h3>

<p>马蜂窝数据仓库在模型设计上以准确性、易用性、及时性为设计目标,以满足业务人员对数据的多样需求。</p>

<ul>

<li>

<strong>准确性</strong>:数据质量管控要在建模过程中落地,为数据准确性保驾护航。</li>

<li>

<strong>易用性</strong>:兼顾模型的可扩展性和可理解性。</li>

<li>

<strong>及时性</strong>:充分考虑模型的使用效率,提供方便快捷的数据查询和数据计算服务。</li>

</ul>

<h3>3.3 设计流程</h3>

<p>马蜂窝数仓模型设计的整体流程涉及需求调研、模型设计、开发测试、模型上线四个主要环节,且规范设计了每个阶段的输出与输入文档。</p>

<p><img src="/img/remote/1460000020613079" alt="" title=""></p>

<ol>

<li>

<strong>需求调研</strong>:收集和理解业务方需求,就特定需求的口径达成统一,在对需求中涉及到的业务系统或系统模块所承担的功能进行梳理后进行表字段级分析,并对数据进行验证,确保现有数据能够支持业务需求。</li>

<li>

<strong>模型设计</strong>:根据需求和业务调研结果对模型进行初步归类,选择合适的主题域进行模型存放;确定主题后进入数据模型的设计阶段,逻辑模型设计过程要考虑总线结构构建、模型规范定义等关键问题;物理模型设计以逻辑模型为基础,兼顾存储性能等因素对逻辑模型做的物理化的过程,是逻辑模型的最终物理实现.物理模型在一般情况下与逻辑模型保持一致,模型设计完成后需要进入评审与 Mapping 设计。</li>

<li>

<strong>模型开发</strong>:就是对模型计算脚本的代码实现过程,其中包含了数据映射、脚本实现、测试验证等开发过程。单元测试完成后需要通知业务方一起对模型数据进行业务验证,对验证问题做收集,返回验证模型设计的合理性。</li>

<li>

<strong>模型上线</strong>:完成验证后的模型就可以在线上生产环境进行部署。上线后需要为模型配置监控,及时掌握为业务提供数据服务的状况。我们还将模型的实体和属性说明文档发布给仓库数据的使用者,使模型得到更好地应用。</li>

</ol>

<h3>3.4 主题分类</h3>

<p>基于对目前各个部门和业务系统的梳理,马蜂窝数据仓库共设计了 4 个大数据域(交易、流量、内容、参与人),细分为 11 个主题:</p>

<p><img src="/img/remote/1460000020613080" alt="" title=""><img src="/img/remote/1460000020613081" alt="" title=""></p>

<p>以马蜂窝订单交易模型的建设为例,基于业务生产总线的设计是常见的模式,即首先调研订单交易的完整过程,定位过程中的关键节点,确认各节点上发生的核心事实信息。模型是数据的载体,我们要做的就是通过模型(或者说模型体系)归纳生产总线中各个节点发生的事实信息。</p>

<p>订单生产总线:</p>

<p><img src="/img/remote/1460000020613082" alt="" title=""></p>

<p>如上图所示,我们需要提炼各节点的核心信息,为了避免遗漏关键信息,一般情况下抽象认为节点的参与人、发生时间、发生事件、发生协议属于节点的核心信息,需要重点获取。以下单节点为例,参与人包括下单用户、服务商家、平台运营人员等;发生时间包括用户的下单时间、商家的确认时间等;发生的事件即用户购买了商品,需要记录围绕这一事件产生的相关信息;发生协议即产生的订单,订单金额、约定内容等都是我们需要记录的协议信息。</p>

<p>在这样的思路下,总线架构可以在模型中不断添加各个节点的核心信息,使模型支撑的应用范围逐步扩展、趋于完善。因此,对业务流程的理解程度将直接影响产出模型的质量。</p>

<p>涉及的业务节点越多,业务流程也就越复杂。从数据的角度看,这些业务过程会产生两种基本的场景形态,即数据的拆分和汇聚。随着流程的推进,前一节点的原子业务单位在新节点中可能需要拆分出更多信息,或者参与到新节点的多向流程。同样,也可能发生数据的汇聚。以某个订单为例,下单节点数据是订单粒度的,而到支付节点就发生了数据拆分。数据的拆分、汇聚伴随着总线的各节点,可能会一直发散下去。</p>

<p><img src="/img/remote/1460000020613083" alt="" title=""></p>

<p>鉴于上述情况,在模型实现过程中,我们不能把各节点不同粒度的数据信息都堆砌在一起,那样会产生大量的冗余信息,也会使模型本身的定位不清晰,影响使用。因此,需要输出不同粒度的模型来满足各类应用需求。例如既会存在订单粒度的数据模型,也会存在分析各个订单在不同时间节点状态信息的数据模型。</p>

<p><img src="/img/remote/1460000020613084" alt="" title=""></p>

<p><img src="/img/remote/1460000020613085" alt="" title=""></p>

<p>基于维度建模的思路,在模型整合生产总线各节点核心信息之后,会根据这些节点信息进一步扩展常用的分析维度,以减少应用层面频繁关联相关分析维度带来的资源消耗,模型会反范式冗余相关维度信息,以获取应用层的使用便捷。最终建立一个整合旅游、交通、酒店等各业务线与各业务节点信息的马蜂窝全流程订单模型。</p>

<h2>四、数据仓库工具链建设</h2>

<p>为提升数据生产力,马蜂窝数据仓库建立了一套工具链,来实现采集、研发、管理流程的自动化。现阶段比较重要的有以下三大工具:</p>

<h3>1. 数据同步工具</h3>

<p>同步工具主要解决两个问题:</p>

<ul>

<li>从源系统同步数据到数据仓库 </li>

<li>将数据仓库的数据同步至其他环境</li>

</ul>

<p>下面重点介绍从源系统同步数据到数据仓库。</p>

<p>马蜂窝的数据同步设计支撑灵活的数据接入方式,可以选择抽取方式以及加工方式。抽取方式主要包括增量抽取或者全量抽取,加工方式面向数据的存储方式,是需要对数据进行拉链式保存,或者以流水日志的方式进行存储。</p>

<p>接入时,只需要填写数据表信息配置以及具体的字段配置信息,数据就可以自动接入到数据仓库,形成数仓的 ODS 层数据模型,如下:</p>

<p><img src="/img/remote/1460000020613086" alt="" title=""></p>

<p><img src="/img/remote/1460000020613087" alt="" title=""></p>

<p><img src="/img/remote/1460000020613088" alt="" title=""></p>

<h3>2. 任务调度平台</h3>

<p>我们使用 Airflow 配合自研的任务调度系统,不仅能支持常规的任务调度,还可以支持任务调度系统各类数据重跑,历史补数等需求。</p>

<p>别小看数据重跑、历史补数,这两项功能是在选择调度工具中重要的参考项。做数据的人都清楚,在实际数据处理过程中会面临诸多的数据口径变化、数据异常等,需要进行数据重跑、刷新、补数等操作。</p>

<p>我们设计的「一键重跑」功能,可以将相关任务依赖的后置任务全部带出,并支持选择性地删除或虚拟执行任意节点的任务:</p>

<ul>

<li>如果选择删除,这该任务之后所依赖的任务均不执行</li>

<li>如果选择虚拟执行,则会忽略(空跑)掉该任务,后置的所有依赖任务还是会正常执行。</li>

</ul>

<p>如下是基于某一个任务重跑下游所有任务所列出的关系图,选中具体的执行节点,就可以执行忽略或者删除。</p>

<p><img src="/img/remote/1460000020613089" alt="" title=""></p>

<h3>3. 元数据管理工具</h3>

<p>元数据范畴包括技术元数据、业务元数据、管理元数据,在概念上不做过多阐述了。元数据管理在数据建设起着举足轻重的作用,这部分在数仓应用中主要有 2 个点:</p>

<p><strong>(1)血缘管理</strong></p>

<p>血缘管理可以追溯数据加工整体链路,解析表的来龙去脉,用于支撑各类场景,如:</p>

<ul>

<li>支持上游变更对下游影响的分析与调整</li>

<li>监控各节点、各链路任务运行成本,效率</li>

<li>监控数据模型的依赖数量,确认哪些是重点模型</li>

</ul>

<p>如下是某一个数据模型中的血缘图,上下游以不同颜色进行呈现:</p>

<p><img src="/img/remote/1460000020613091" alt="" title=""></p>

<p><img src="/img/remote/1460000020613092" alt="" title=""></p>

<p><strong>(2)数据知识管理</strong></p>

<p>通过对技术、业务元数据进行清晰、详尽地描述,形成数据知识,给数据人员提供更好的使用向导。我们的数据知识主要包括实体说明与属性说明,具体如下:</p>

<p><img src="/img/remote/1460000020613093" alt="" title=""></p>

<p><img src="/img/remote/1460000020613094" alt="" title=""><img src="/img/remote/1460000020613095" alt="" title=""></p>

<p><img src="/img/remote/1460000020613096" alt="" title=""></p>

<p>当然,数仓工具链条中还有非常多工具,例如自动化建模工具,数据质量管理工具,数据开发工具等,都已经得到了很好地实现。</p>

<h2>五、数仓应用——指标平台</h2>

<p>有了合理的数仓架构、工具链条支撑数据研发,接下来,就要考虑如何把产出的数据对外赋能。下面以马蜂窝数据应用利器-指标平台,进行简单介绍。</p>

<p>几乎所有的企业都会构建自己的指标平台,每个企业建立的标准都不一样。在这个过程中会遇到指标繁多、定义不清楚、查询缓慢等问题。为尽量避免这些问题,指标平台在设计时需要遵循几大原则:</p>

<ol>

<li>指标定义标准,清晰,容易理解,且不存在二义性,分类明确</li>

<li>指标生产过程简单、透明、可配置化</li>

<li>指标查询效率需要满足快速响应</li>

<li>指标权限管理灵活可控</li>

</ol>

<p>基于以上原则,马蜂窝的指标平台按照精细化的设计进行打造,指标平台组成架构如下图:</p>

<p><img src="/img/remote/1460000020613097" alt="" title=""></p>

<p>其中:</p>

<ol>

<li>数据仓库是指标数据的来源,所有指标目前都是通过数据仓库统一加工的</li>

<li>指标管理包括指标创建与指标元数据管理:数仓负责生产并创建最核心、最基础的指标;其他人员可以基于这些指标,按照规则进行指标的派生;元数据管理记录指标的具体来源路径,说明指标的数据来源是数仓表,或者是 Kylin,MySQL 或 ES</li>

<li>指标字典对外呈现指标的定义、口径、说明等,保证指标的透明化及可解释性</li>

<li>数据服务接受指标的查询请求,针对不同场景判断查询的成本,选择最优链路进行指标查询,并返回指标查询的结果</li>

<li>多维查询将可以提供查询服务的指标与维度通过界面呈现,用户可以基于维度选择指标或基于指标选择维度,查询具体需要的数据</li>

<li>权限管理贯彻始终,可以支持表级、指标级、维值级别的权限管理</li>

</ol>

<h2>六、总结</h2>

<p>企业的数据建设需要经历几个大的步骤:</p>

<ul>

<li>第一步,业务数据化:顾名思义,一切业务都能通过数据反映,主要指的是将传统线下流程线上化;</li>

<li>第二步,数据智能化:光有数据还不行,还需要足够的智能,如何通过智能化的数据支撑运营、营销及各类业务,这是数据中台当前解决的主要问题;</li>

<li>第三步,数据业务化:也就是我们常说的数据驱动业务,数据不能只是数据,数据价值最大化在于可以驱动新的业务创新,带动企业增长。</li>

</ul>

<p>目前大部企业目前都停留在第二个阶段,因为这一步需要足够夯实,才能为第三步打好基础,这也是为什么各大企业要投入很大成本到大数据平台、数据仓库乃至数据中台的建设中。</p>

<p>马蜂窝数据中台的建设才刚刚起步。我们认为,理想的数据中台需要具备<strong>数据标准化、工具组件化、组织清晰化</strong>这三个核心前提。为了向这一目标迈进,我们将建立统一、标准化的数据仓库作为当下数据中台的重点工作之一。</p>

<p>数据来源于业务,最终也将应用于业务。只有对数据足够重视,与业务充分衔接,才能实现数据价值的最大化。在马蜂窝,从管理层,到公司研发、产品、运营、销售等各角色,对数据非常重视,数据产品的使用人数占公司员工比例高达 75%。</p>

<p>大量用户的使用,驱动着我们在数据中台建设的路上不断前进。如何将新兴技术能力应用到数据仓库的建设,如何以有限的成本高效解决企业在数据建设中面临的问题,将是马蜂窝数仓建设一直的思考。</p>

<p><strong>本文作者:颜博,马蜂窝数据仓库研发负责人。</strong></p>

<p><img src="/img/remote/1460000020613098" alt="" title=""></p>

一种对开发更友好的前端骨架屏自动生成方案

https://segmentfault.com/a/1190000020309764

2019-09-06T14:33:35+08:00

2019-09-06T14:33:35+08:00

马蜂窝技术

https://segmentfault.com/u/mafengwojishu

67

<p><strong><em>(马蜂窝技术原创内容,公众号 ID:mfwtech)</em></strong></p>

<p>一份来自 Akamai 的研究报告显示,在对 1048 名网购户进行采访后发现:</p>

<ul>

<li>约 47% 的用户期望他们的页面在两秒之内加载完成。</li>

<li>如果页面加载时间超过 3s,约 40% 的用户会选择离开或关闭页面。</li>

</ul>

<p><img src="/img/bVbxnDd?w=743&h=418" alt="" title=""></p>

<p>一直以来,为了提升用户在页面加载时的体验,无论是 Web 还是 iOS、Android 的应用中,前端开发工程师都做了许多工作。除了解决如何让网页展现速度更快的问题,还有很重要的一点就是提升用户对加载等待时间的感知。「菊花图」以及由其衍生出的各种加载动画就是一类常见的解决方案,相信无论是开发者还是用户对下面这个图标都不会陌生:</p>

<p><img src="/img/bVbxnDe?w=900&h=383" alt="" title=""></p>

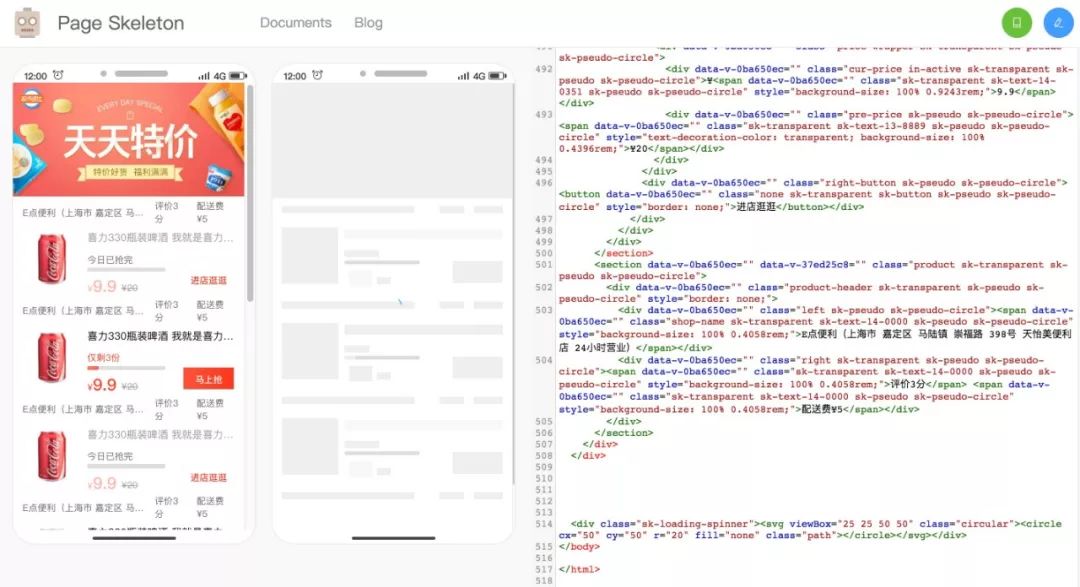

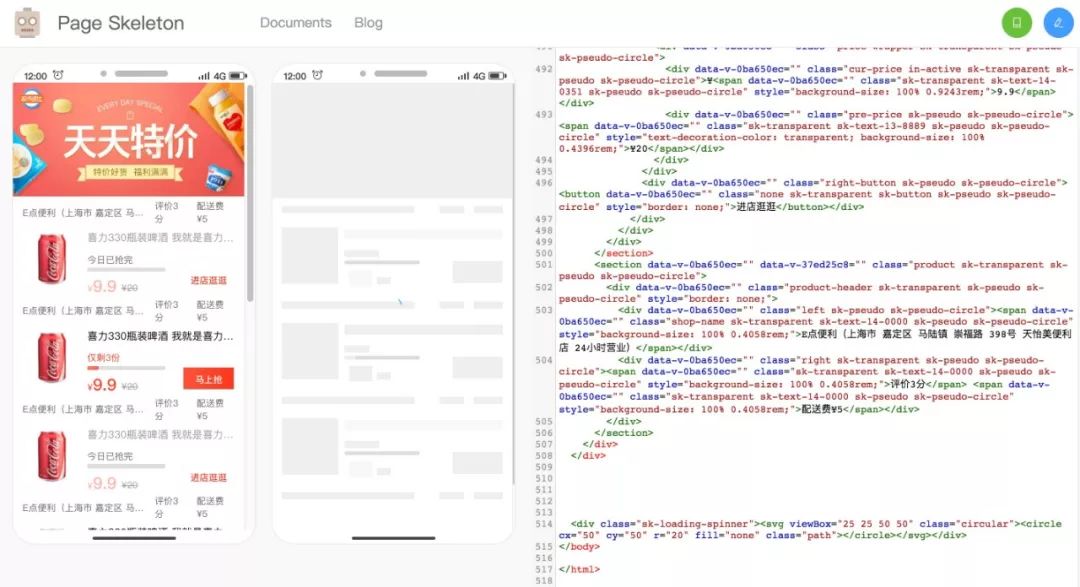

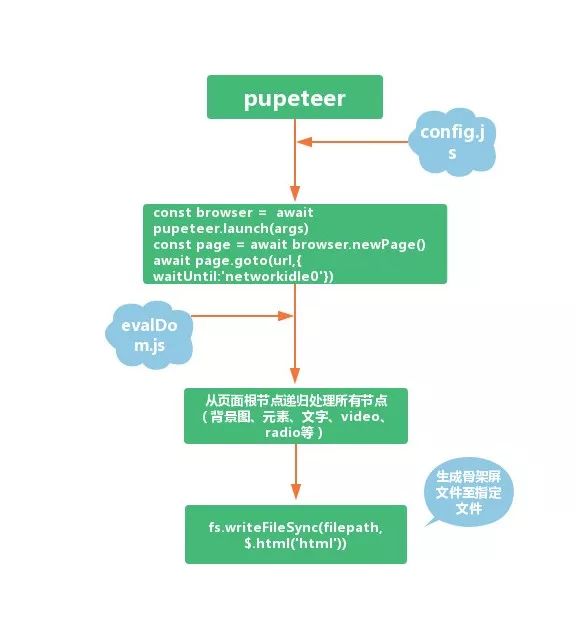

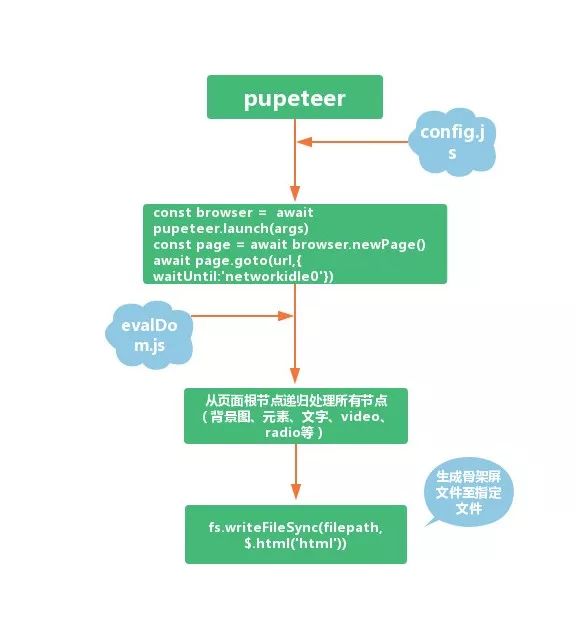

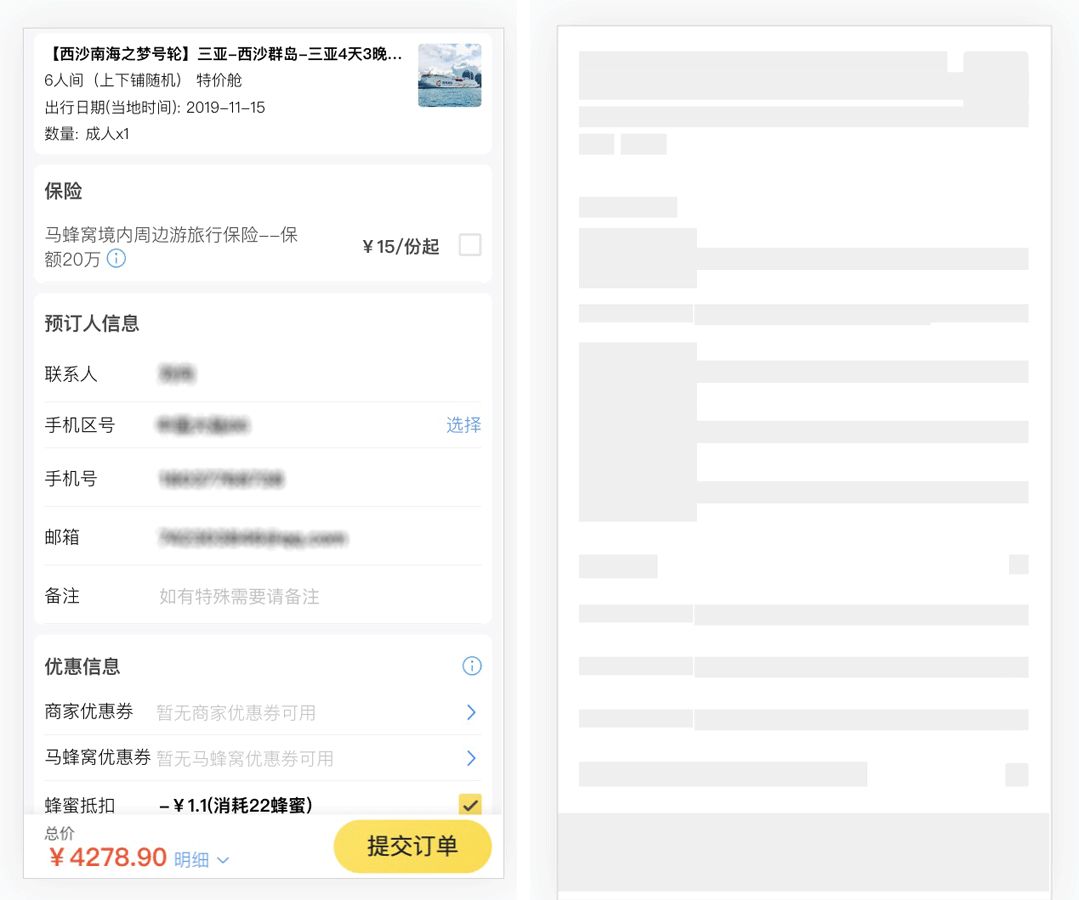

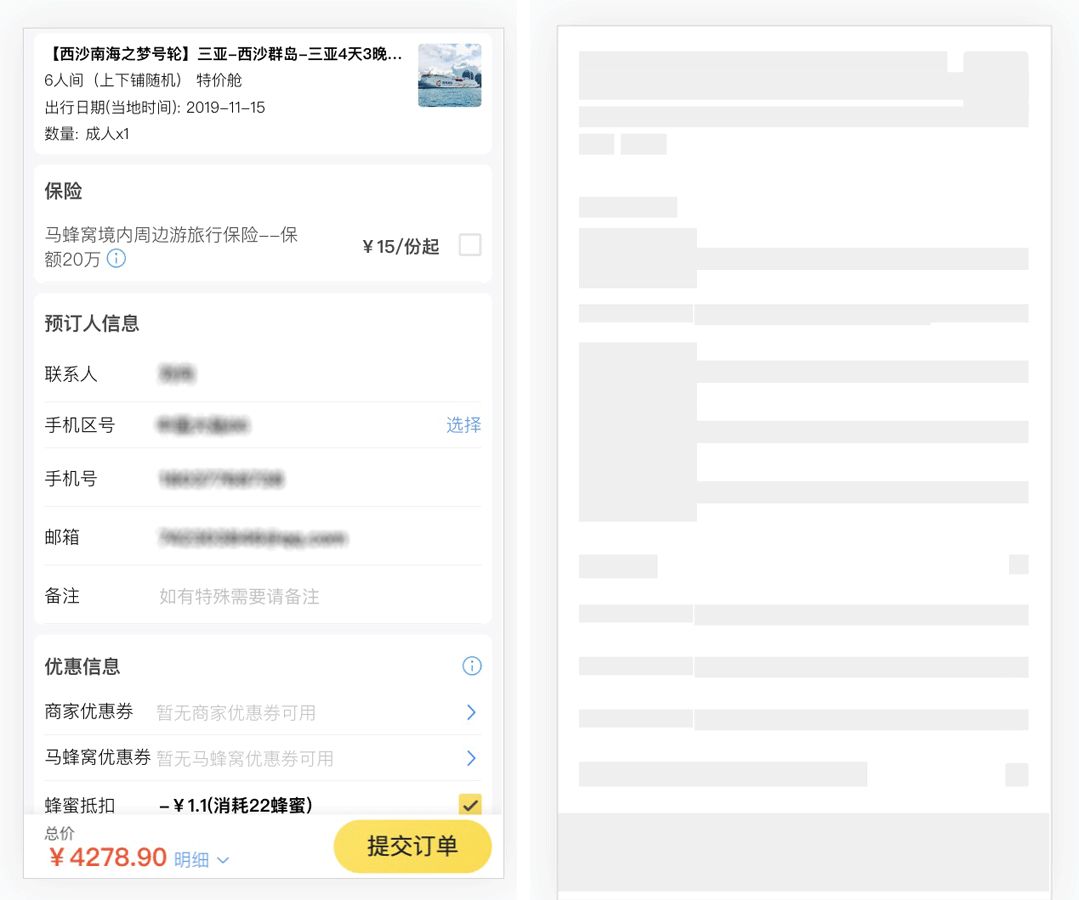

<p>本文要介绍的「骨架屏」则被视为菊花图升级版的方案。受现有骨架屏方案的启发,马蜂窝电商前端研发团队实现了一种自动化生成骨架屏的方法,并在马蜂窝商城的多个页面中实现应用,取得了不错的效果。</p>

<h2>一、什么是骨架屏</h2>