@Author : Jasperyang

@School : BUPT

这篇文章同时在知乎里放着~

写在前面

Kaggle的数据挖掘比赛近年来很火,以至于中国兴起了很多很多类似的比赛,做了两个这种类型的比赛了,Jdata用户商品购买预测和用户位置精准预测,积累了相当多的比赛经验了,虽然两次成绩都不是特别好,59/4590 和 179/2844 。这些比赛的套路从根本上都是一毛一样的,我下面可以和大家探讨一个大致的做题套路以及怎么往高分走的方向,但是总结来说这就是个拼体力的任务,和智力无关。(虽然锻炼了动手能力,极大强化了我在sklearn和pandas上的技能熟练度...)

PART 1 : 怎么开始

首先是看题目,是个什么样类型的预测?回归?二分类?多分类?

每种类型的预测会有一点点不同,个人觉得西瓜书还是需要快速看一遍的,不一定说每个公式都要仔仔细细去推导(推导公式对你做比赛基本没有什么帮助),你要知道什么是监督,半监督,非监督等等。

关于多分类我有个入门blog,可以快速浏览一遍

然后就是繁复的特征工程了

一般这种比赛都有个这么样的流程:

最重要的是在特征工程上,基本你会花上60%的时间在这里,因为在这里你需要做的是数据清洗,异常处理,变换,构造新特征等等,这一套有很详细的教程,给大家贴两个传送门(先别急着看)

看完这两篇后,基本你就能做到得心应手地处理数据。

但是,其实在做特征工程之前,你应该先去了解数据,怎么去了解数据呢?这就需要你熟练掌握pandas这个工具了,提到怎么熟悉这个工具,我想offer你下面这个学习流程。

安装anaconda,这个很简单,网上一搜就有(这个科学研究工具包含了基本所有你需要的,jupyter,pandas,numpy等等)当然你要做深度学习就需要tensorflow,pytorch之类的还得另外装。

由于后面我们需要用到xgboost这款神器当模型,所以最好你的系统是ubuntu,因为在ubuntu中安装xgboost只需要pip install就行,在别的系统装起来可能你会想打人。

ok,有了环境,就用anaconda/bin/jupyter 来运行一个jupyter工作环境吧,在这个环境里你可以随心所欲为所欲为所欲为...(主要就是因为jupyter可以保存你之前执行的结果,很方便做实验,详细的你可以google)

学习pandas很简单,因为它就是像数据库对表操作一样。初学直接就看看官网的教程:10 min to learn,之后你要merge,concat,join等等复杂的操作再去一点点查,一点点啃。慢慢熟练了你就能对你的数据做任何你想要的变换,比如找出某些年份的大于某些数值的数据。

为什么需要去了解数据呢?因为数据有分布,有不同的业务意义,你通过整理做图可以更加深入理解某些属性的意义,然后构造或是提取出有用的特征。

构造特征

在我看来,这算是特征工程的一部分,也是最最重要的一部分,你将会在这里花大量的时间!!(所谓特征就是feature,也就是你的训练数据集中除去label以外的所有列)

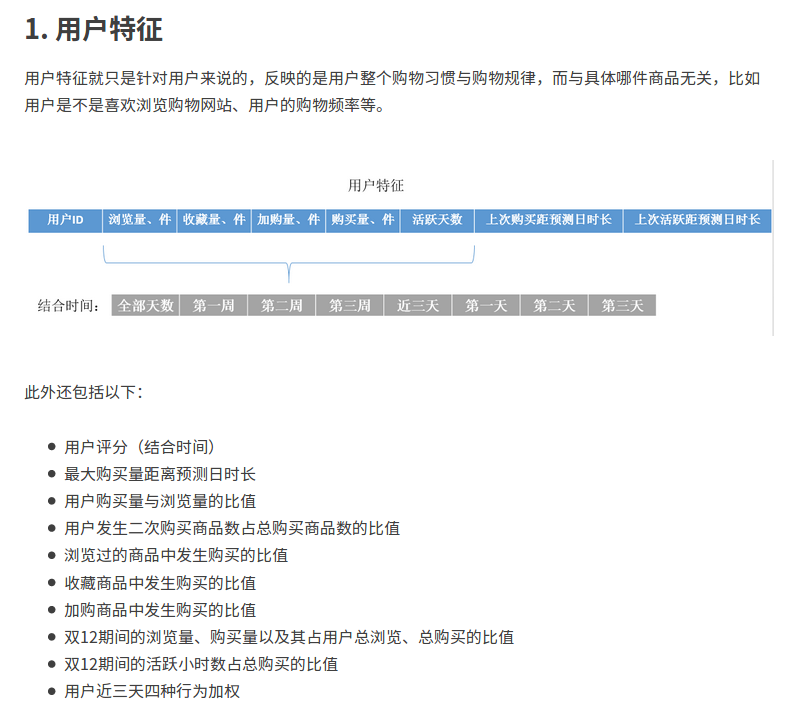

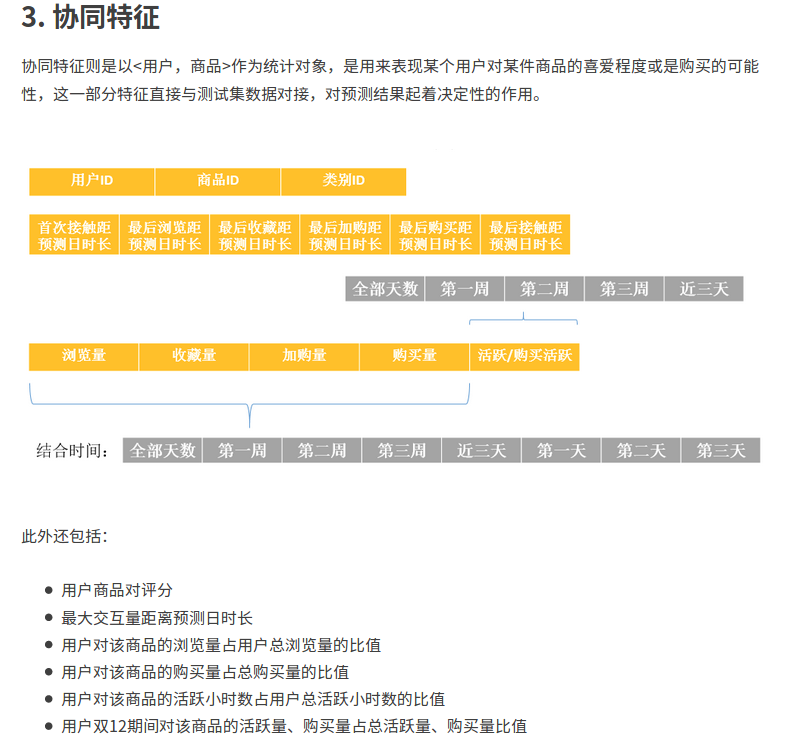

打个比方,比如一个商品预测的比赛,你可以将特征分成三类,从三种角度去整理分析。(感谢阿里移动推荐算法大赛总结的图片数据)

这种特征构造提取的过程对于每一种比赛都不一样,我这里就不详细讲了,如果你需要更多的启发的思维,建议你去搜索大量别人怎么从各种角度思考的资料。

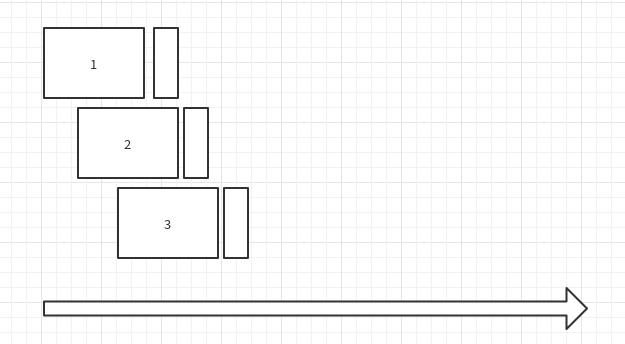

在这里提及一句,一般来讲,涉及时间的都会需要设计时间窗口这么一个东西,这个东西说复杂不复杂,但是实践起来很费精力。简单来讲就是你需要对你的数据按照一定的时间划分。比如我之前的比赛用前五天的数据预测后一天的,但是总的数据集是两个月的,这时候你需要划分你的数据集分好训练集和验证集。

上面的1,2,3是三个训练集,后面带的小框是验证集,等于你需要训练好几个模型。

同时你可以想啊,更早之前的数据肯定对现在的预测影响会更小,所以会有个权重的问题,也就是你得到了十个模型,最接近预测日的算model_0,最远的算model_9,那么给model_0权重0.7,给model_9的权重0.05。

你需要知道什么是训练集,验证集,测试集!!

有时候训练集的类别很不均衡

这个时候需要欠采样或是过采样。

欠采样 某个数据比较多的类别随机减少掉一些训练数据

过采样 找那些数据少的类别使用smote方法插值添加数据 smote算法

其实数据不平衡的处理也是特征工程的一部分,我这里只是提出来强调了一下,类别不平衡的处理其实还有很多,但是都不常用,大家可以去大概了解了解。

每个特征你都应该取好名字,以防乱了。

另外,由于做模型融合时需要有特征多样性这么一说,所以也许你需要不同的特征簇输入到不同的模型中,所以做好你的文件管理十分重要!!!

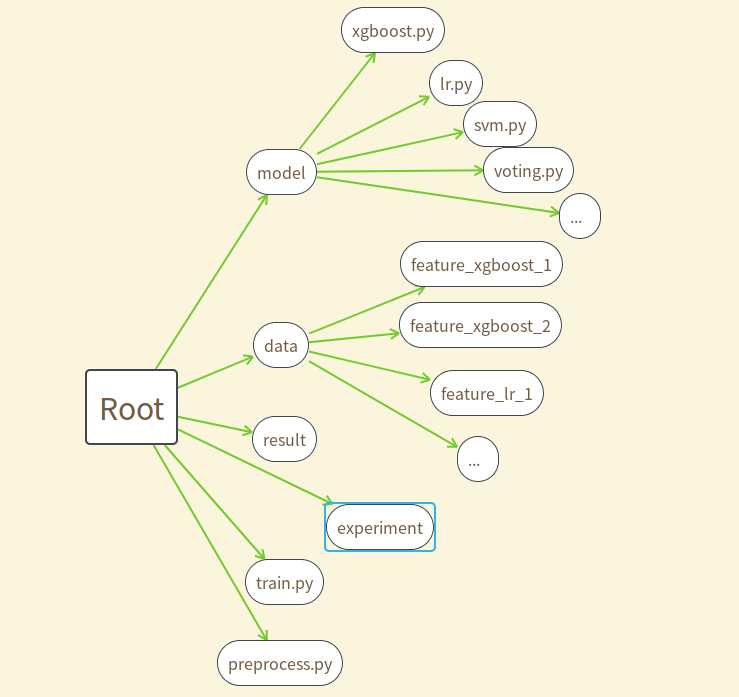

我建议你的比赛工程文件如下。

result里面你需也要分好文件夹放不同的结果,这样方便后面模型融合时我们用投票器的方式。

experiment里面是你的jupyter实验文件,因为这类文件你会创建很多,所以最好有一个专门的文件夹来管理。

是不是很简单并且清晰明了,当你学会了sklearn中的pipeline之后,你就可以搭建一个可以轻易修改并给别人看讨论思考过程的工程代码。但是不能完成的是做成一个可以轻易复用到各种比赛的框架。因为每个比赛的数据大不相同。不再多言。

OK!! 走过上面的流程,我们现在进入到part 2的训练阶段吧,这个阶段是最激动人心的,因为你将在这里遇见你特征工程以及模型的不足,然后调优,看着成绩慢慢提高~!

PART 2

模型阶段,在这里,你需要对各种模型都有很清晰的了解,最好是你能够推导公式,不能也算了。

Logistic Regression

SVM

GDBT

Naive Bayes

Xgboost (这个可以说是最有用的)

Adaboost 等等

熟读西瓜书吧,里面从基础开始会让你懂很多,最好是李航的统计学习方法看一遍,这本书比较薄,涵盖的内容却很全,推导也好理解。

然后这些模型很高兴的是,一个都不用你去写~都有现成的库,而且基本集中在sklearn中。除了 lightGBM。

先看一下这篇简单调用: python sklearn常用分类算法模型的调用,你会发现模型用起来好容易好方便~是的,但是这只是开始,别忘记要保存模型哦,另外保存结果也要严格按照规定的文件路径,不然后面你就乱了。

sklearn的编程方式博大精深,但是api使用还是很简单,你只需要花点时间好好学学,就能很熟练了,推荐 python之sklearn学习笔记,这个比官网的教程好看懂,毕竟是中文的嘛...流汗~

再来你还需要去对这些算法调参,这些我就不再谈了,我想着重提一下xgboost,这是一个可以并行运算的回归树,在现在的比赛中用的十分频繁而且有效。

我翻译的官网的原理解释 : (XGBoost)提升树入门介绍(Inrtoduction to Boosted Trees)

看懂了后你就会知道为什么这个东西这么牛逼了,当然前提是你需要知道决策树,随机森林的原理。

再说一句,安装xgboost在ubuntu系统上很方便,但别的系统真的很难受,自己体会吧,不想浪费时间最好都弄成ubuntu

xgboost运行后的效果一般就很好了,但是这不是最终的,因为xgboost有很多的参数,怎么去调参使得结果更优很重要。

调参也是个体力活,望各位保重身体!~

好了,part 2 也就讲到这里了,其实把这前两个部分好好做,就能取得好的成绩了,第三个部分是后期往上窜一窜的手段,当然不可不用。

PART 3

模型融合

模型融合得看你是做什么样的预测,不同的预测结果有不同的融合方式。

bagging,voting,stacking都是ensembling的一种。

一般都是讲回归的,voting具体的方法没有讲,我这里有一段代码,你看看就懂怎么做voting。

# 投票器

def file_name(file_dir):

filename = []

for root, dirs, files in os.walk(file_dir):

filename.append(files)

return filename\n",

filename = file_name('./result/all_result/')[0]

'''

* 文件名 * 票数

['result_0.002_no_0.03_8steps_0.8964.csv', 9

'result_TL_ten_0.002_no_0.03_0.9062.csv', 10

'result_0.001_0.8917 .csv', 9

'result_LT_ten__0.001_no_0.03_0.9092.csv', 10

'result_LT_ten_0.0015_no_0.03_0.9051.csv', 10

'result_0.0015_0.9061.csv', 10

'result_AdaB_0.31.csv', 3

'result_feature_delexcep_0.002_tree.csv', 9

'result_rf_0.001_0.03_0.86.csv', 8

'result_lr_0.60.csv', 4

'result_rf_0.87.csv', 8

'result_0.002_no_0.03_6steps_0.8951.csv', 9

'result_0.002_no_0.03_0.9058.csv', 10

'result_gdbt_0.79.csv', 6

'result_xgb_91.csv', 11

'result_0.002__0.9046.csv', 10

]

'''

dic = {}

index = list(re.iloc[:,0])

result = []

voting = [9,10,9,10,10,10,3,9,8,4,8,9,10,6,11,10,9]

for t in list(re.iloc[:,0]):

dic[t] = {}

for i,shop in enumerate(list(re[re.row_id == t].iloc[0,1:])):

# 建立字典

if shop not in dic[t].keys():

dic[t] = {re[re.row_id == t].iloc[0,1] : voting[i]}

else:

dic[t][shop] += voting[i]

# 选出最高票者 , 得票相同的选后者

top = 0

score = 0

for x,y in dic[t].items():

if y > score:

top = x

score = y

result.append(x)

re = pd.DataFrame({'row_id':index,'shop_id':result})"

关于模型融合这一块就看你想怎么弄了,多标签分类这种比较局限,就是投票器,回归的话花样就多了,还能分层搞,所以不怕你想不到,就怕你不尝试。

为了加深你对模型融合的理解和使用,另外推荐三篇:

PART 4

最后我讲两个trick吧。(没什么道理性的,有时候行,有时不行)

找比赛leak,这个就是钻空子吧。通过分析测试集的一些特性找出golden feature(就是一下子能把成绩提高老多的feature)我听大牛的分享里有讲到但是我做比赛时没有想到,很惭愧。

-

利用GDBT或是XGBoost的叶子节点的信息创建出新的特征,一般来讲能提高成绩,但是训练起来贼慢,像我借了好几台电脑,把训练集分散到不同电脑上跑。累死了...

总结

有人说跟一遍kaggle上的kernel一套就都会了,我觉得挺好的,但是看了我的这篇呕心沥血的文章后,我想你的知识才是系统的!~

好了,终于到收官了,说实在的,这类型的比赛我暂时是不想参加了,我们学校的大牛硬是打了10场,然后拿了两次冠军,我这参加了两次,成绩不好,但是已经身心俱疲了,没信心拿到奖了。况且,我认为深度学习才是现在的王道,我已经在图像识别和image caption中遨游了好些日子。有意思多了。

到此,祝大家好运。

**粗体** _斜体_ [链接](http://example.com) `代码` - 列表 > 引用。你还可以使用@来通知其他用户。