目录

事件回顾

近日,央视报道了香港2亿港元的“AI换脸”视频会议诈骗案。这起诈骗案的特点是利用了人工智能的深度伪造技术,诈骗分子事先搜集了目标公司高层管理人员的面部和声音数据,通过AI技术将这些数据“换脸”到骗子的身上,制作出看似真实的视频会议,导致参加视频会议的公司职员将2亿港元转入骗子的账户。

2月5日,香港警方公司披露了该案件,提醒广大市民注意安全。2月7日,顶象防御云业务安全情报中心率先分析了该起,“AI换脸”视频会议诈骗案的详细结果,并列举了几类有效的安全检测和防御方法。

其实,这起骗局始于2024年1月份,受骗员工收到一封自称是公司总部CFO(首席财务官)发来的电子邮件。随后,冒充公司CFO的诈骗分子组织了一次视频通话,邀请该受骗员工,以及其他几个异地办公的“同事”一起参加一个视频会议。视频中,受骗员工发现公司CFO及几个同事,外表和声音、谈话的语气等与此前相仿,于是打消了早期的疑虑。

会议结束后,该受骗员工在欺诈分子冒充的CFO指示下,一周内进行了15笔交易,金额达2亿港元(超过2500万美元)。在此过程中,诈骗分子还使用WhatsApp、电子邮件和一对一视频通话与该员工保持联系。事后,受骗员工向公司负责人汇报整个交易过程,才意识到自己被骗了。

香港警方分析发现,这是一起精心策划的骗局。诈骗分子通过社交媒体和视频平台上,寻找并下载了该公司CFO以及其他几个人的照片、视频,然后使用深度伪造技术伪造出不同人员声音,再合成到伪造的欺诈视频片段中。受骗员工参与的视频会议中,除了他自己是真人外,其他全部为伪造的虚假视频。而被诈骗的资金被发送到五个当地银行账户,然后迅速被人分散转走。

如何发现视频中“换脸”的坏人

这起诈骗案对企业和个人都敲响了警钟。深度伪造已经达到了无法用肉眼检测到的复杂程度,除非接受过专门培训,否则AI生成的虚假身份可能很难被人识别出来。深度伪造质量的提高,检测是一大难题。不仅肉眼无法有效识别,一些常规的检测工具也不能及时发现,企业和个人在遇到类似“视频”场景时,应保持警惕,需要采用多重策略来识别与防御深度伪造欺诈。

在视频对话的时候,可以要求对方摁鼻子、摁脸观察其面部变化,如果是真人的鼻子,按下去是会变形的。也可以要求对方吃食物、喝水,观察脸部变化。或者,要求做一些奇怪的动作或表情,比如,要求对方挥手、做某个难做的手势等,以辨别真假。在挥手的过程中,会造成面部的数据的干扰,会产生一定的抖动或者是一些闪烁,或者是一些异常的情况。在一对一的沟通中可以问一些只有对方知道的问题,验证对方的真实性。同时,当有人在视频或录音中提出汇款要求时,必须致电或从其他渠道一再核实。

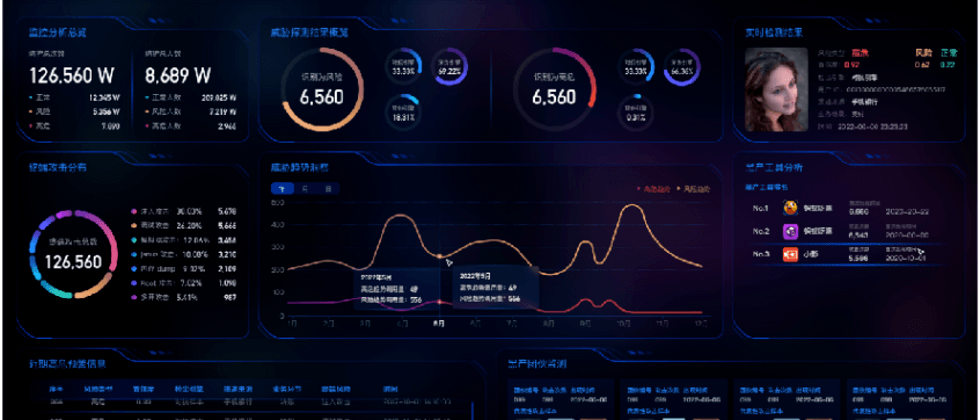

此外,基于人工审查与AI技术相结合的人脸反欺诈系统,能助力企业提升反欺诈能力。顶象全链路全景式人脸安全威胁感知方案,能够有效检测发现虚假视频。它通过人脸环境监测信息、活体识别、图像鉴伪、智能核实等多维度信息对用户人脸图像进行智能风险评估、风险评级,迅速识别虚假认证风险。

顶象全链路全景式人脸安全威胁感知方案,针对人脸识别场景及关键操作的实时风险监测,针对性地监测如摄像头遭劫持、设备伪造、屏幕共享等行为,并触发主动防御机制进行处置。在发现伪造视频或异常人脸信息后,该方案系统支持自动执行防御策略,设备执行命中防御策略之后对应的防御处置,可以有效阻断风险操作。

另外,减少或者杜绝在社交媒体上分享账户服务、家庭家人、交通出行、工作岗位等敏感信息,防范欺诈分子盗用下载后,进行图片和声音的深度伪造,而后进行身份伪造。并持续对公众进行深度伪造技术及其相关风险的教育,随时了解AI和深度伪造技术的最新发展,以相应地调整保障措施。

业务安全产品:免费试用

业务安全交流群:加入畅聊

**粗体** _斜体_ [链接](http://example.com) `代码` - 列表 > 引用。你还可以使用@来通知其他用户。