内容一览:北京时间 3 月 21 日 23:00,英伟达创始人兼 CEO 黄仁勋在 GTC 2023 上发表主题演讲,介绍了生成式 AI、元宇宙、大语言模型、云计算等领域最新进展。

关键词:英伟达 黄仁勋 GTC 2023

「Don’t Miss This Defining Moment in AI」,中文意为「切勿错过 AI 的决定性时刻」。北京时间 2023 年 3 月 21 日 23:00,「皮衣刀客」黄教主在 GTC 2023 发表主题如上的 Keynote 演讲,并称「这将是我们迄今为止最重要的一次 GTC」,英伟达官方 Twitter 也放出了本届 GTC 的 AI Wave Top 5,事实如何?一起来看看今年 Keynote 都有哪些重磅发布吧~

关键词之一:生成式 AI

生成式 AI 技术,提供学习数据的基础模式和结构,生成新的内容,例如图像、音频、代码、文本、3D 模型等。专业的生成式人工智能工具可以提高创作者的生产力,让对技术不太熟悉的用户也能受益。GTC 2023 上宣布了 NVIDIA AI Foundations 云服务及 NVIDIA Piccasso。

AI 技术正在革命性地改变 3D 内容创作,GTC 2023 上,黄仁勋宣布生成式 AI 领域新版本 Omniverse Audio2Face 应用程序的到来。

Omniverse Audio2Face 应用人工智能,让 3D 艺术家通过音频文件快速制作出逼真的面部动画,避免了通常费时费力的手动过程。Audio2Face 现在可以预览普通话中文语言支持,同时改进了唇形同步质量、更强大的多语言支持新的预训练模型。

第一代医药行业生成式 AI 超算系统问世

日本 Mitsui & Co. 宣布打造基于 NVIDIA DGX 的超算系统 Tokyo-1。Tokyo-1 是全球首款针对医药行业的生成式 AI 超算系统,将用于探索分子动力学模拟与生成式 AI 模型。该项目预计于 2023 年下半年上线,由 Mitsui & Co. 子公司 Xeureka 负责运营,Xeureka 希望借助 Tokyo-1 改变日本制药行业领域长期以来面临的药物开发滞后等问题。

Tokyo-1 基于 NVIDIA DGX H100,第一期包括 16 个 NVIDIA DGX H100 系统,每个系统配备 8 个 NVIDIA H100 Tensor Core GPU。后续 Xeureka 还将持续扩充系统规模,并提供日本相关产业客户的节点连接能力,提供分子动力学模拟、大型语言模型训练、量子化学、潜在药物创新分子结构的 AI 生成等,同时 Tokyo-1 用户还能透过 NVIDIA BioNeMo 提供药物探索与服务。

关键词之二:数字生物学

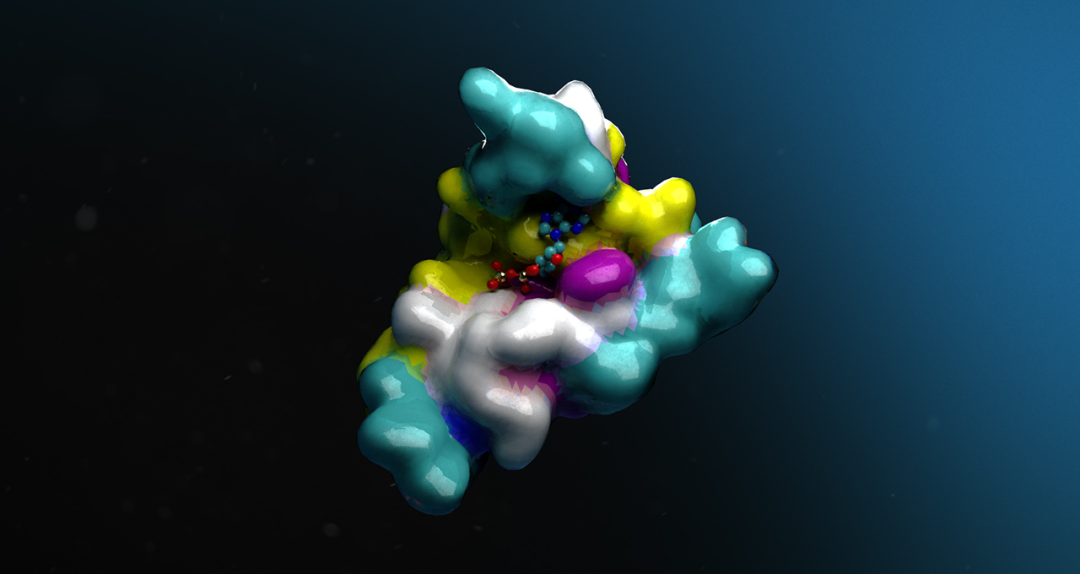

英伟达发布一套生成式 AI 云服务,用于定制 AI 基础模型,以加速蛋白质及疗法、基因组学、化学、生物学和分子动力学等领域的研究。

生成式 AI 模型可以快速识别潜在的药物分子,在某些情况下还可以从零设计化合物或基于蛋白质的治疗方法。通过对小分子、蛋白质、DNA 和 RNA 序列的大规模数据集进行训练,这些模型可以预测蛋白质的三维结构以及分子与目标蛋白质对接的程度。

全新的 BioNeMo™ 云服务针对 AI 模型训练和推理,加速药物研发。它使得科研人员能够在自有数据上对生成式 AI 应用进行微调,并直接在浏览器中运行 AI 模型推理,或通过新的云端 API 轻松集成到现有应用中。

BioNeMo 云服务包括预训练 AI 模型,有助于帮科研人员创建药物研发的 AI Pipeline,目前已被 Evozyne 和 Insilico Medicine 等生物制药公司用于药物设计。

接入 BioNeMo 服务的新型生成式 AI 模型包括:

- MegaMolBART 生成式化学模型

- ESM1nv 蛋白质语言模型

- OpenFold 蛋白质结构预测模型

- AlphaFold2 蛋白质结构预测模型

- DiffDock 用于分子对接的扩散生成模型

- ESMFold 蛋白质结构预测模型

- ESM2 蛋白质语言模型

- MoFlow 生成式化学模型

- ProtGPT-2 生成新蛋白质序列的语言模型

关键词之三:CV

CV-CUDA 是一个用于云端计算机视觉的开源 GPU 加速库,旨在帮助企业在 GPU 上建立和扩展端到端、基于 AI 的计算机视觉和图像处理 Pipeline。

CV-CUDA 将预处理和后处理步骤从 CPU 转移到 GPU,从而在单个 GPU 上处理 4 倍的 stream,处理相同的工作负载,它的成本只有云计算的四分之一。

CV-CUDA 库为开发人员提供了 30 多种高性能的计算机视觉算法,包括本地 Python API、以及与 PyTorch、 TensorFlow2、 ONNX 和 TensorRT 等机器学习框架的 zero-copy 集成,从而提供更高的吞吐量、更低的计算成本以及与云端 AI 业务相比更少的碳足迹。

自 CV-CUDA alpha 版本发布以来,已有超过 500 家公司创建了超过 100 个用例。

关键词之四:自主机器

2021 年,英伟达提出了 cuOpt,一个实时路线优化软件,为企业提供了适应实时数据的能力。cuOpt 通过每秒分析数十亿个可行移动,优化交付路线。

cuOpt 现在是一个蓬勃发展的合作伙伴生态系统的中心,该生态系统包括系统集成商和服务提供商、物流和运输软件供应商、优化软件专家和位置服务提供商。cuOpt 在 Li & Lim pickup and delivery benchmark (Li 和 Lim 提出的接货和交付问题基准测试集合中设定的基准测试,用于衡量路线的效率)中创造了三项记录。

针对 Li & Lim 基准测试,研究人员已经在二十年前规划出了最佳路线,发明了设置并重新设置世界上最著名的解决方案的算法,以前的获奖者则专注于对先前路线进行小的调整。cuOpt 创建的路线与以前的获奖者创建的路线不同。cuOpt 提供的改进比基准测试上先前记录的改进高出 7.2 倍,比之前创纪录的成果获得的改进高出 26.6 倍。

## 关键词之五:对话式 AI

各行各业的公司都希望利用交互式 avatar 来增强数字体验。但创建它们是一个复杂耗时的过程,需要应用能看、听、理解及与用户交流先进的人工智能模型。

为了简化这个过程,英伟达通过 Omniverse Avatar Cloud Engine(ACE)为开发者提供实时的人工智能解决方案,这是一个云原生的微服务套件,用于交互式 avatar 的端到端开发。NVIDIA 正在不断改进,为用户提供所需的工具,轻松设计和部署从交互式聊天机器人到智能数字人类的各种 avatar。

AT&T 公司正计划使用 Omniverse ACE 和 Tokkio AI avatar 工作流程来构建、定制和部署用于客户服务和员工服务台的虚拟助理。AT&T 与英伟达的服务交付合作伙伴之一 Quantiphi 合作,正在开发互动 avatar,可以用当地语言提供跨地区的全天候支持。这有助于该公司降低成本,同时为其全球员工提供更好的体验。除了客户服务外,AT&T 还计划为公司的各种用例构建和开发数字人。

本届 GTC 2023 上,除了以上五大关键词贯穿 Keynote ,值得关注的还有黄仁勋「在线带货」的 Grace Superchip 超级芯片。

Grace CPU:为节能铺平道路

实际测试中,在主要数据中心 CPU 应用程序的包络相同的情况下,Grace CPU Superchip 比 x86 处理器性能高 2 倍,这表明数据中心可以处理 2 倍的高峰流量或削减一半的电费。

三大 CPU 创新:

- 在单一裸晶 (Die) 中,Grace CPU 用 ultra-fast fabric 连接 72 Arm Neoverse V2 core ,在 fabric 带宽中 sport 3.2TB/s,一个标准的吞吐。

- 用 NVIDIA NVLink-C2C 互连将其中两个芯片连接到一个超级芯片 (superchip) 封装中,提供 900GB/s 的带宽。

- Grace CPU 是第一个使用服务器级 LPDDR5X 内存的数据中心 CPU。这提供了高达 50% 的内存带宽,成本类似但功率是典型服务器内存的 1/8,尺寸紧凑,密度是典型的基于卡的内存设计的 2 倍。

测试发现,与数据中心中使用相同功耗的领先 x86 CPU 相比,Grace CPU:

- 微服务的速度提高了 2.3 倍;

- 内存密集型数据处理速度提高 2 倍;

- 计算流体力学速度提高了 1.9 倍。

英伟达:AI 世界的引擎

从去年年底开始,ChatGPT 一经推出就将生成式 AI、大语言模型推到了风口浪尖,在黄仁勋看来,ChatGPT 开启了 AI 的「iPhone Moment」,但在今天的 keynote 直播中,他也坦言「 生成式 AI 令人印象深刻的能力让公司产生了一种紧迫感,需要重新构想他们的产品和商业模式」,可以看到英伟达已经从 AI 训练到部署,从半导体到软件库,从系统到云服务等方面开始进行多维度突破。

目前,全球英伟达生态系统涵盖 NVIDIA Inception 中的 400 万开发人员、40,000 家公司和 14,000 家初创公司,或许正如 GTC 2023 前夕,黄仁勋在 CNBS 访谈中所说的,英伟达要成为这样一家公司:

Because of what we do, we could make what is barely possible possible, or we could make something that is very energy consuming, very energy efficient, or we could turn something that cause a lot of money, and make it more affordable.

**粗体** _斜体_ [链接](http://example.com) `代码` - 列表 > 引用。你还可以使用@来通知其他用户。