ICASSP 2026 论文预讲会由CCF语音对话与听觉专委会、语音之家主办,旨在为学者们提供更多的交流机会,更方便、快捷地了解领域前沿。活动将邀请 ICASSP 2026 录用论文的作者进行报告交流。

ICASSP 2026 论文预讲会第一期邀请到昆山杜克大学语音及多模态智能信息处理实验室做本次会议的专场分享,欢迎大家观看。

第一期-昆山杜克大学语音及多模态智能信息处理实验室【专场】

时间:2月6日(周五)19:00 ~ 21:30

形式:线上

议程:每位嘉宾分享30分钟(含5分钟QA)

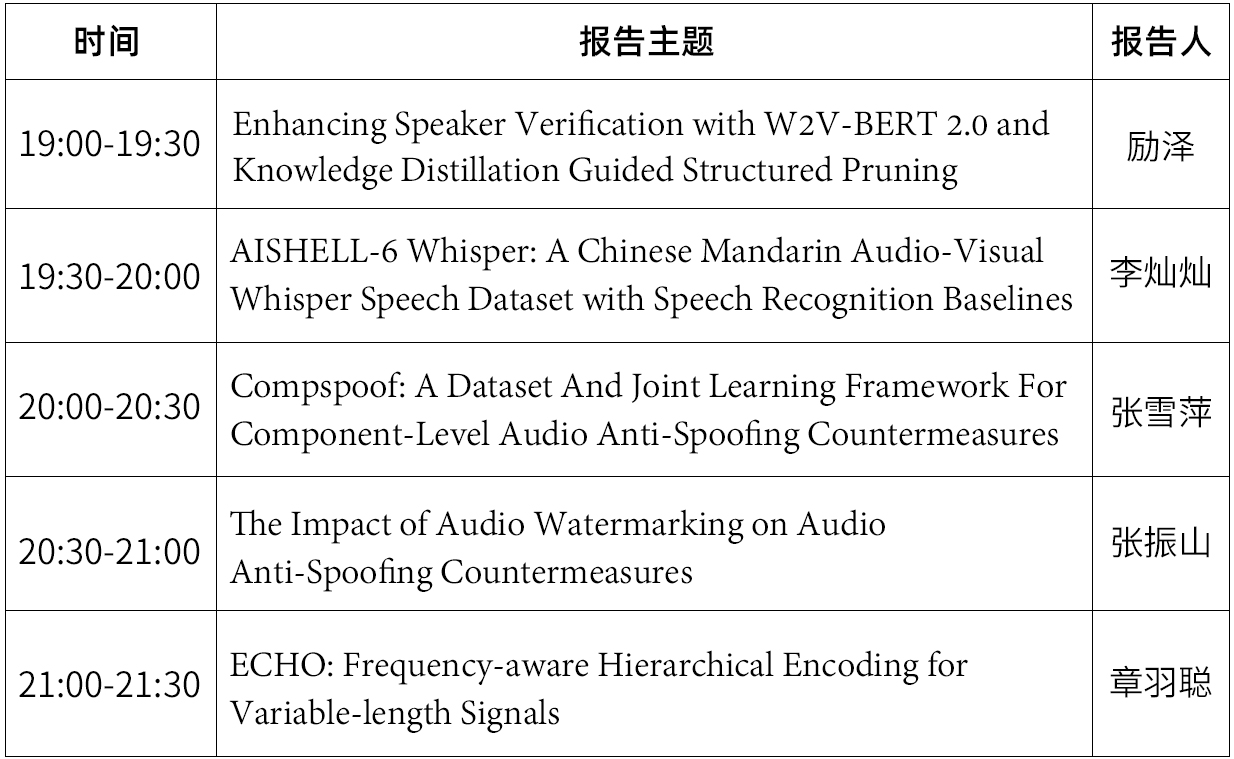

嘉宾&主题

嘉宾简介:励泽,武汉大学计算机科学与技术专业三年级硕士生,昆山杜克大学语音及多模态智能信息处理实验室研究实习生, 研究方向为声纹识别、说话人日志。

分享主题:Enhancing Speaker Verification with W2V-BERT 2.0 and Knowledge Distillation Guided Structured Pruning

(基于 W2V-BERT 2.0 与知识蒸馏引导结构化剪枝的声纹识别方法)

摘要:大规模自监督预训练模型通过提供丰富的特征表示,在说话人验证任务中展现出显著优势。本文研究并评估了 w2v-BERT 2.0 自监督预训练模型在说话人验证任务中的应用,该预训练模型包含约 6 亿参数,并在涵盖 143 种语言的 450 万小时无标注语音数据上进行训练。为有效利用预训练大模型的多层特征输出,本文引入带有层适配器的多层特征聚合结构对多层特征进行处理,以提取说话人嵌入。同时,结合低秩适配技术实现高效微调。在 Vox1-O 与 Vox1-H 测试集上,所提出的方法分别取得 0.12% 和 0.55% 的等错率,取得了当前最优性能。此外,本文进一步采用知识蒸馏引导的结构化剪枝方法,在模型参数规模约减少 80% 的情况下,仅造成 0.04% 的等错率性能下降。

论文链接:https://sites.duke.edu/dkusmiip/files/2026/01/li.pdf

开源地址:https://github.com/ZXHY-82/w2v-BERT-2.0_SV

嘉宾简介:李灿灿,武汉大学计算机科学与技术专业二年级硕士生, 昆山杜克大学语音及多模态智能信息处理实验室研究实习生, 研究方向为多模态语音识别等。

分享主题 :AISHELL-6 Whisper: A Chinese Mandarin Audio-Visual Whisper Speech Dataset with Speech Recognition Baselines

(AISHELL-6 Whisper:中文普通话音视频耳语语音数据集及语音识别基线)

摘要:耳语语音识别技术不仅能保障敏感通讯的隐私,也能为发声受限患者提供重要的沟通支持,还能在需要避免噪声干扰的场合实现隐蔽的信息交互。中文普通话音视频耳语语音识别的发展长期受限于大规模数据集的缺失。我们推出AISHELL6-Whisper——一个大规模开源的音视频耳语语音数据集,包含30小时耳语语音及等量平行正常语音,并配有同步的正面面部视频。此外,我们基于Whisper-Flamingo框架提出音视频语音识别基线模型,该模型采用并行训练策略以对齐正常语音和耳语语音的嵌入表征,并通过投影层适配耳语语音的频谱特性。该模型在我们数据集的测试集上实现了耳语语音4.13%与正常语音1.11%的字错误率,同时在wTIMIT英文基准数据集中实现最先进的结果。数据集及音视频语音识别基线代码已开源。

论文链接:https://sites.duke.edu/dkusmiip/files/2026/01/AISHELL6_whisper.pdf

数据库及代码开源地址:https://zutm.github.io/AISHELL6-Whisper

嘉宾简介:张雪萍,昆山杜克大学语音及多模态智能信息处理实验室研究助理, 研究方向为伪造音检测,声音事件检测与定位等。已在领域内重要会议发表论文4篇,其中ICASSP论文2篇。

分享主题:Compspoof: A Dataset And Joint Learning Framework For Component-Level Audio Anti-Spoofing Countermeasures

(Compspoof:用于组件级音频反欺骗对策的数据集和联合学习框架)

摘要:组件级音频欺骗(CompSpoof)是一种新型的音频篡改形式,其中音频信号的特定组件(如前景说话人的语音或环境音)被伪造或替换,而其余组件仍保持真实。现有的反欺骗数据集和方法通常将整段语音或音频片段视为完全真实或完全伪造,因而难以有效识别组件级欺骗行为。为解决这一问题,我们构建了CompSpoof数据集,包括真实/伪造语音与真实/伪造环境音的不同组合。我们还提出了一种分离增强型联合学习框架,通过对音频中的不同组件进行分离,并分别对每个组件进行反欺骗检测,从而实现组件级的欺骗检测。该联合学习策略在保留与检测任务相关关键信息的同时,有效提升了模型对复杂欺骗场景的判别能力。大量实验结果表明,所提出的方法显著优于现有基线方法,验证了组件分离的必要性以及对各组件分别进行欺骗检测的重要性。在此基础上,我们将 CompSpoof 数据集进一步扩展为 CompSpoofV2数据集,显著增加了攻击源、环境音以及混音策略的多样性。同时,我们在测试集中增加了新生成没有在训练集中见过的的音频样本,用于在未知条件下评估模型的泛化检测能力。基于 CompSpoofV2 数据集和分离增强型联合学习框架,我们发起了 ICME 2026 环境感知语音和声音深度伪造检测挑战赛(ESDD2):https://sites.google.com/view/esdd-challenge/esdd-challenges/...

论文链接:https://sites.duke.edu/dkusmiip/files/2026/01/Xueping-Zhang-_icassp_compspoof.pdf

数据集链接:https://xuepingzhang.github.io/CompSpoof-dataset/

嘉宾简介:张振山,昆山杜克大学计算机科学与技术专业四年级本科生,研究方向为音频鉴伪。

分享主题:The Impact of Audio Watermarking on Audio Anti-Spoofing Countermeasures

(音频水印对音频反音频鉴伪系统的影响)

摘要:本文首次系统研究了音频水印对音频鉴伪(anti-spoofing)系统的潜在影响。音频鉴伪技术对保障语音应用的安全至关重要,而音频水印也已被广泛用于版权保护与AI内容溯源等场景,但这两类关键技术之间的相互作用及其潜在影响尚缺乏充分研究。从直观机制上看,水印所引入的额外扰动可能干扰模型对伪造音频(spoof)判别线索的捕捉与理解:一方面,水印可能对正常语音产生显著的信号扰动,导致其在反伪造模型中被误判为伪造音频;另一方面,水印也可能部分掩盖或削弱原本用于识别伪造语音的关键特征,使得某些伪造音频被误判为真实语音(bonafide)。为验证这一假设,我们在现有反伪造数据集基础上,通过引入多种传统(基于手工设计)与基于神经网络的水印方法,构建了带有水印的训练与评测数据集,并将其命名Watermark-Spoofing 数据集。实验结果表明,水印的加入会持续削弱反伪造系统的性能,且随着水印密度升高,系统的等错误率(EER)也相应上升。为应对该问题,本文进一步提出了知识保持水印学习框架(Knowledge-Preserving Watermark Learning, KPWL),旨在使模型能够适应水印引入的分布变化,同时尽可能保留其在原始无水印领域中的伪造检测能力。本研究揭示了音频水印作为一种先前被忽视的重要领域偏移(domain shift),并建立了首个用于研究抗水印反伪造系统的基准数据集与方法框架。

论文链接:https://sites.duke.edu/dkusmiip/files/2026/01/zhenshan.pdf

开源地址:https://github.com/Alphawarheads/Watermark_Spoofing

嘉宾简介:章羽聪,昆山杜克大学语音及多模态智能信息处理实验室研究实习生,武汉大学计算机科学与技术专业三年级博士生,研究方向为异音检测等。

分享主题:ECHO: Frequency-aware Hierarchical Encoding for Variable-length Signals

(ECHO:面向可变长度与任意采样率机器信号的频率感知分层编码基础模型)

摘要:近年来,大规模音频基础模型在语音与通用音频任务中取得了显著进展,但其在任意采样率、可变长度机器信号(如工业声学与振动信号)建模中的潜力仍有待充分挖掘。本文提出了一种新型机器信号基础模型 ECHO(frEquenCy-aware Hierarchical encOding),通过引入频率感知的分带结构与相对频率位置编码,实现了对不同采样率下频谱位置信息的显式建模。同时,ECHO 在每个频带内采用时间滑动补丁机制并通过分层编码结构生成紧凑而判别力强的信号嵌入表示。在涵盖多种工业场景的 SIREN 评测基准上,ECHO 在 DCASE 2020–2025 异常声音检测任务以及多种振动/声学故障诊断数据集上均取得一致的最优或领先性能,展现出优异的跨模态、跨采样率泛化能力。实验结果充分验证了所提出频率感知分层编码框架在通用机器信号表征学习中的有效性与鲁棒性。

论文链接:https://sites.duke.edu/dkusmiip/files/2026/01/zhang.pdf

开源地址:https://github.com/yucongzh/ECHO

参与方式

直播将通过语音之家微信视频号进行直播手机端、PC端可同步观看👇👇👇

预讲会征集

ICASSP 2026 论文预讲会面向全球线上招募,结合定向邀请与征集报名的方式,来选择预讲会的嘉宾。

**粗体** _斜体_ [链接](http://example.com) `代码` - 列表 > 引用。你还可以使用@来通知其他用户。