ICASSP 2026 论文预讲会由CCF语音对话与听觉专委会、语音之家主办,旨在为学者们提供更多的交流机会,更方便、快捷地了解领域前沿。活动将邀请 ICASSP 2026 录用论文的作者进行报告交流。

ICASSP 2026 论文预讲会第九期邀请到 哈尔滨工程大学智能信号处理组 做本次会议的专场分享,欢迎大家观看。

实验室概况

哈尔滨工程大学智能信号处理组(Group of Intelligent Signal Processing, GISP@HEU)由计算机学院关键副教授成立于2020年,专注于人工智能驱动的信号处理研究,涵盖机器听觉、遥感图像解译、心电/脑电等生物信号处理以及多源信号融合。实验室多次在 IEEE AASP DCASE Challenge(声学场景与事件检测及分类挑战)和IEEE SP Grand Challenge(信号处理大挑战)等国际竞赛中取得优异成绩,通过让机器“听懂”环境声音,实现对现实世界场景与事件的智能感知与理解,并在国际顶级期刊和会议发表50余篇论文,部分成果已获得实际应用。

第九期-哈尔滨工程大学智能信号处理组【专场】

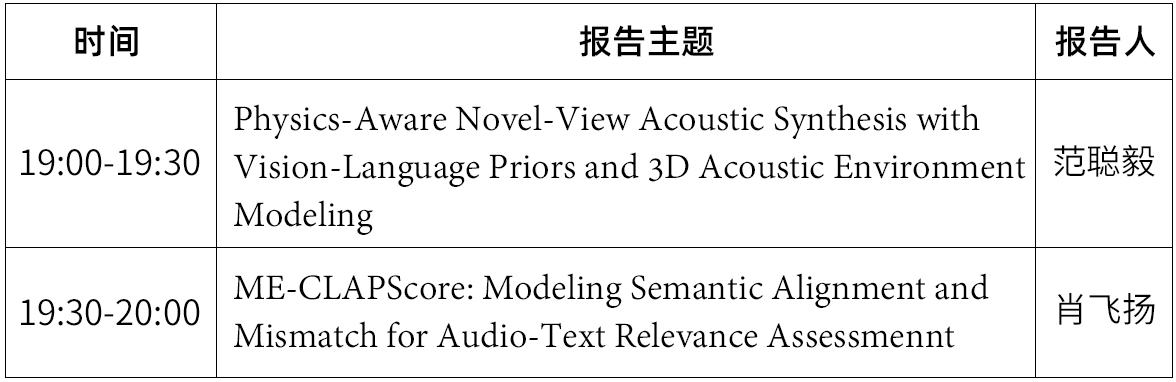

时间:4月18日(周六)19:00 ~ 20:00

形式:线上

议程:每位嘉宾分享30分钟(含5分钟QA)

嘉宾&主题

嘉宾简介:范聪毅,哈尔滨工程大学计算机学院2022级本科生,研究方向为多模态3D生成与理解。在ICCV、NeurIPS、ICASSP等会议发表论文4篇。在ICASSP SPGC获得2026年度任务7 Track1和Track2国际第二名。哈尔滨工程大学首位通过依托高水平创新成果替代本科毕业设计的本科生,哈尔滨工程大学五四创新标兵,哈尔滨工程大学年度创新标兵,黑龙江省三好学生。

分享主题:Physics-Aware Novel-View Acoustic Synthesis with Vision-Language Priors and 3D Acoustic Environment Modeling

摘要:空间音频生成中新视角声音合成(Novel-View Acoustic Synthesis, NVAS)任务旨在根据场景图像和听者位置,为任意视角合成具有空间感的双耳音频。然而,现有方法普遍忽略了材料属性、物体布局等对声音传播有显著影响的物理语义信息,导致声音空间感和物理一致性不足。为此,作者提出了Phys-NVAS框架,首次将三维空间建模与视觉语言先验结合,实现对房间几何结构和材料吸声反射特性的联合建模。该方法利用多视角图像与深度估计还原全局三维声场结构,并通过视觉-语言模型提取描述物体种类、布局与材料的语义文本,生成与声音传播相关的物理感知描述。最后,将几何特征与语义特征在声学融合模块中统一表示,驱动双耳音频生成器生成空间真实感更强、物理一致性更高的听觉信号。实验证明,该方法在多个真实场景中(如办公室、公寓、户外)均优于主流模型,在多项指标上取得更低误差,生成的声音在空间感、材料一致性与临场感上均更贴近人类真实听感。

论文链接:https://arxiv.org/html/2601.19712v1

项目及Demo链接:https://physnvas.github.io/

嘉宾简介:肖飞扬,哈尔滨工程大学计算机学院2023级博士研究生,研究方向为跨模态音频内容理解,研究内容为音频-文本语义关联、自动音频字幕与检索、异常声音检测。在IEEE SPL,ICASSP, INTERSPEECH等期刊会议发表学术论文16篇。在DCASE 2022任务6A获得国际第6名,DCASE 2023任务6A获得国际第6名、任务6B获得国际第4名,DCASE 2024 Task9获得国际第2名、Task 10获得国际第1名并荣获评委会奖。在IEEE ICASSP SPGC挑战赛获得2025年度赛道8加速度计检测任务冠军、赛道8说话人匿名化系统国际前5名,2026年度赛道12音频语义对齐自动评估挑战国际第5名。相关研究受黑龙江省自然科学基金首届在读博士生项目资助,并在2025年第二十届人机语音通讯学术会议学生论坛荣获最佳学生亮点报告奖。

分享主题 :ME-CLAPScore: Modeling Semantic Alignment and Mismatch for Audio-Text Relevance Assessmennt

摘要:ICASSP 2026 SPGC中的首届通用音频语义对齐自动评估挑战(x-to-audio alignment challenge,XACLE)旨在评估音频与文本的语义匹配程度,目标是开发出能够贴近人类主观判断的自动打分模型。然而,现有的评估指标往往只考虑了语义对齐,忽视了感知上明显但不匹配的细节,导致其与人类主观判断一致性不高。为此,本文提出了一种与人类主观判断高度相关的自动音频-文本相关性评估方法ME-CLAPScore,通过通过多个预训练CLAP模型构建多专家特征提取架构提升语义表征能力,利用语义错配分支深入挖掘音频-文本特征之间的语义不匹配情况,并结合共享空间中的音频-文本语义相似度进行综合打分。值得注意的是,该方法创新性地引入语义错配分支,通过特征差异和注意机制,显式地捕捉感知上的细粒度语义冲突。最终结果融合了对齐分数和错配分数,能够得出更贴近人类判断的相关性评估结果。该方法在挑战赛中表现突出,在多个评价指标上均优于官方基线,并最终排名国际第5位,验证了其在主观相关性预测方面的有效性。参与方式直播将通过语音之家微信视频号进行直播手机端、PC端可同步观看👇👇👇

**粗体** _斜体_ [链接](http://example.com) `代码` - 列表 > 引用。你还可以使用@来通知其他用户。